30. November 2023

Deepfakes und andere synthetische Medien - größtenteils durch generative KI-Technologien erstellt - werden immer bekannter, und es ist inzwischen allgemein anerkannt, dass synthetische Medien ein Problem für Einzelpersonen, Organisationen und die Gesellschaft gleichermaßen darstellen.

Deepfakes gibt es in vielen Formen, z. B. als Reenactment, Gesichtstausch und Generative Adversarial Networks (GANs). Es ist wichtig, die verschiedenen Formen von Deepfake-Angriffen zu verstehen, um sich vor ihnen zu schützen.

Das Problem der generativen KI ist besonders dringlich, da die Häufigkeit dieser Angriffe zunimmt, da es immer einfacher wird, überzeugende synthetische Bilder zu erstellen. Da die generative KI immer ausgefeilter, zugänglicher und skalierbarer wird, wird es immer schwieriger, dem zu vertrauen, was wir sehen und mit wem wir online interagieren.

In diesem Artikel entmystifizieren wir die oft komplexe Welt des generativen KI-basierten Betrugs und erklären die Methoden, die hinter jeder Art von Betrug stehen.

Was ist generative KI?

Generative künstliche Intelligenz (KI) bezieht sich auf Algorithmen, die als Reaktion auf eine bestimmte Eingabe oder Aufforderung neue Inhalte - einschließlich Text, Bilder, Videos oder andere Medien - erzeugen können. Die generative KI nutzt häufig Technologien wie neuronale Netze und Computer Vision und lernt aus Mustern und Strukturen aus vorhandenen "Trainingsdaten", um Inhalte zu erstellen. Die "analytische KI" dient beispielsweise der Analyse vorhandener Daten und automatisiert den Prozess der Erkennung von Mustern oder der Extrapolation von Trends, was in Bereichen wie Medizin und Gesundheitsdaten nützlich sein kann.

Generative KI hat den technologischen Zeitgeist erobert, wobei Tools wie Chat-GPT gleichermaßen von Ehrfurcht und Kontroversen begleitet werden. Diese Tools können die Erstellung von Inhalten erheblich beschleunigen, aber es gibt auch echte Bedenken, wie sie von Kriminellen im Wettrüsten der Cybersicherheit als Waffe eingesetzt werden können, um Betrug und Social Engineering, Desinformation und Cyberkriminalität durch manipulative synthetische Inhalte zu fördern.

Darüber hinaus bedeutet die zunehmende Zugänglichkeit von generativen KI-Tools auf dem Markt für Crime-as-a-Service , dass technisch weniger versierte Angreifer nun einfachen und erschwinglichen Zugang zu hochentwickelten Tools zur Erstellung synthetischer Medien haben. Die Hightech-Softwareoptionen von gestern sind heute alltäglich, da die technologische Barriere verschwindet.

Ein aktueller Beweis für die Qualität dieser KI-generierten Spoofs wurde in einer Studie des Center for Strategic and International Studies erbracht, aus der hervorgeht, dass wir "den Wendepunkt erreicht haben, an dem Menschen nicht mehr in der Lage sind, sinnvoll zwischen KI-generierten und von Menschen erstellten digitalen Inhalten zu unterscheiden".

In diesem Artikel konzentrieren wir uns insbesondere auf generative KI, die zur Erstellung synthetischer Bilder, einschließlich Deepfakes , eingesetzt wird .

Verschiedene Arten von Deepfake-Angriffen verstehen

Nehmen wir uns einen Moment Zeit, um einige der Formen von generativen KI-Angriffen zu verstehen.

Face Swaps: Eine Form der synthetischen Medien, die mit zwei Eingaben erstellt wird. Sie kombinieren vorhandene Videos oder Livestreams und überlagern den ursprünglichen Feed in Echtzeit mit einer anderen Identität. Das Endergebnis ist ein gefälschtes 3D-Video, das aus mehreren Gesichtern zusammengesetzt ist, wobei jedoch die biometrische Vorlage der echten Person erhalten bleibt, auch wenn die Ähnlichkeit mit dem Angreifer optisch größer ist. Ein Gesichtsabgleicher ohne angemessene Schutzmaßnahmen könnte die Ausgabe als die echte Person identifizieren.

Neuinszenierungen: Auch bekannt als "Puppenspieler"-Deefakes. Bei dieser Technik werden der Gesichtsausdruck und die Bewegungen der Person im Zielvideo oder -bild von der Person im Ausgangsvideo gesteuert. Ein Darsteller, der vor einer Kamera sitzt, steuert die Bewegung und Verformung eines Gesichts, das in einem Video oder Bild erscheint. Während beim Face Swap die Quellidentität durch die Zielidentität ersetzt wird (Identitätsmanipulation), geht es beim Reenactment um die Manipulation der Gesichtsausdrücke einer einzelnen Eingabe.

Generative adversarische Netzwerke (GANs): Ein GAN funktioniert, indem zwei KI-Modelle miteinander konkurrieren, um eine möglichst "genaue" oder authentische Deepfake-Ausgabe zu erzeugen. Die beiden Modelle - ein generatives und ein diskriminierendes Modell - erzeugen und zerstören gleichzeitig. Das generative Modell erstellt Inhalte auf der Grundlage der verfügbaren Trainingsdaten, um die Beispiele in den Trainingsdaten zu imitieren. Währenddessen testet ein diskriminierendes Modell die Ergebnisse des generativen Modells, indem es die Wahrscheinlichkeit bewertet, dass das getestete Beispiel aus dem Datensatz und nicht aus dem generativen Modell stammt. Die Modelle werden so lange verbessert, bis die Wahrscheinlichkeit, dass der generierte Inhalt aus dem generativen Modell stammt, genauso groß ist wie die der Trainingsdaten. Diese Methode ist deshalb so effektiv, weil sie das Ergebnis ihrer eigenen Authentizität verbessert, indem sie ständig die Tools überprüft, die sie überlisten sollen.

Wie werden generative KI-Angriffe typischerweise von Betrügern eingesetzt?

Die Erstellung und Verwendung generativer, von KI erzeugter synthetischer Bilder ist nicht per se kriminell. Synthetische Bilder sind jedoch leider ein Geschenk für Cyberkriminelle - sie unterstützen Straftaten wie Erpressung und Belästigung, die gezielte Verbreitung politischer Desinformationen oder erleichtern Identitäts- und Dokumentenbetrug (z. B. den Versuch, Identitätsüberprüfungen zu umgehen, die durch die "Know Your Customer"-Verordnungen vorgeschrieben sind).

Zu den häufigen Formen des Betrugs, die durch synthetische Bilder unterstützt werden, gehören:

Was ist der Unterschied zwischen digital veränderten und digital erzeugten synthetischen Medien?

Synthetische Medien sind das Ergebnis generativer KI, aber nicht alle synthetischen Medien werden von generativer KI erstellt.

Generative KI erzeugt völlig neue Daten, die einzigartig und originell sind, im Gegensatz zur einfachen Verarbeitung, Analyse und Veränderung vorhandener Daten. Diese Unterscheidung könnte man als digital erzeugte und digital veränderte Bilderzusammenfassen.

Warum redet jeder über generative KI?

Während KI eine Reihe positiver Anwendungsfälle bieten kann - darunter Aufgabenautomatisierung, kreative Inspiration und die Analyse komplexer Datensätze - stehen derzeit die Gefahren der generativen KI im Mittelpunkt.

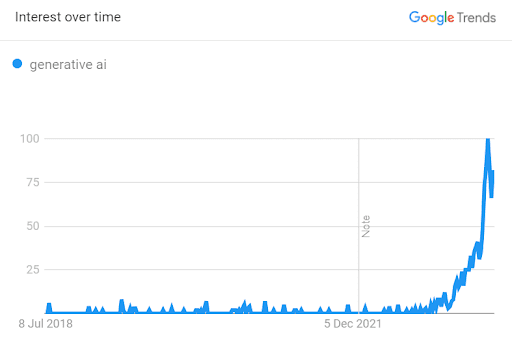

Hinweis: Google Trends stellt die Anzahl der organischen Suchanfragen für einen bestimmten Begriff im Laufe der Zeit dar; die Daten des Diagramms sind auf einen Bereich von 0 bis 100 normiert und werden als "Interesse im Laufe der Zeit" bezeichnet.

Hinweis: Google Trends stellt die Anzahl der organischen Suchanfragen für einen bestimmten Begriff im Laufe der Zeit dar; die Daten des Diagramms sind auf einen Bereich von 0 bis 100 normiert und werden als "Interesse im Laufe der Zeit" bezeichnet.

Eines ist sicher: Die generative KI macht rasante Fortschritte und verspricht tiefgreifende und transformative Auswirkungen in einer Vielzahl von Branchen.

Generative KI hat das Interesse der Öffentlichkeit, der politischen Entscheidungsträger und der Regierungen gleichermaßen geweckt. In diesem Artikel erfahren Sie mehr über generative KI und den öffentlichen Sektor. Er enthält eine Liste von Reaktionen von Regierungen und politischen Entscheidungsträgern auf der ganzen Welt und beschreibt, wie iProov sich gegen die Bedrohung absichert.

In der heutigen digitalen Welt gibt es eine größere digitale Angriffsfläche mit einer größeren Anzahl und Vielfalt von risikoreichen Transaktionen, die online stattfinden - was oft größere Gewinne für Betrüger bedeutet. Letztlich geht es darum, wie bösartige Akteure KI-generierte synthetische Medien für betrügerische Zwecke nutzen und die Verbreitung falscher Informationen im Internet erleichtern können.

Abschließende Gedanken zu generativer KI und biometrischer Gesichtsverifikation

Ein echtes menschliches Gesicht ist einzigartig und kann nicht wirklich nachgeahmt werden. Deshalb hat sich die biometrische Gesichtsverifizierung als die sicherste und bequemste Methode zur Überprüfung der Benutzeridentität im Internet erwiesen.

Eines ist klar: Die biometrische Technologie wird als Rettungsanker für die Überprüfung der echten Anwesenheit aus der Ferne dienen, zumal Nachbildungen vom menschlichen Auge nicht mehr unterschieden werden können. In Wahrheit sind nur die fortschrittlichsten Systeme, die an diesem rasanten Wettrüsten teilgenommen haben, in der Lage, generative KI zu erkennen.

Wie iProov helfen kann

Um ein Deepfake zu verifizieren, nutzt iProov eine patentierte biometrische Einmaltechnologie mit Deep Learning und Computer Vision-Technologien, um bestimmte Eigenschaften zu analysieren, die generative KI-erstellte Medien nicht nachbilden können - da sich auf der anderen Seite der Kamera keine echte Person befindet. Aus diesem Grund ist eine in die Liveness-Technologie integrierte Echtzeit-Biometrie für Unternehmen von entscheidender Bedeutung, um zwischen synthetischen Medien und echten Menschen zu unterscheiden.

Um mehr darüber zu erfahren, wie Betrüger generative KI nutzen, um die Identitätsüberprüfung zu untergraben und den Betrug mit synthetischen Identitäten zu fördern, lesen Sie unseren neuen Bericht "Stolen to Synthetic" hier.