18. Mai 2023

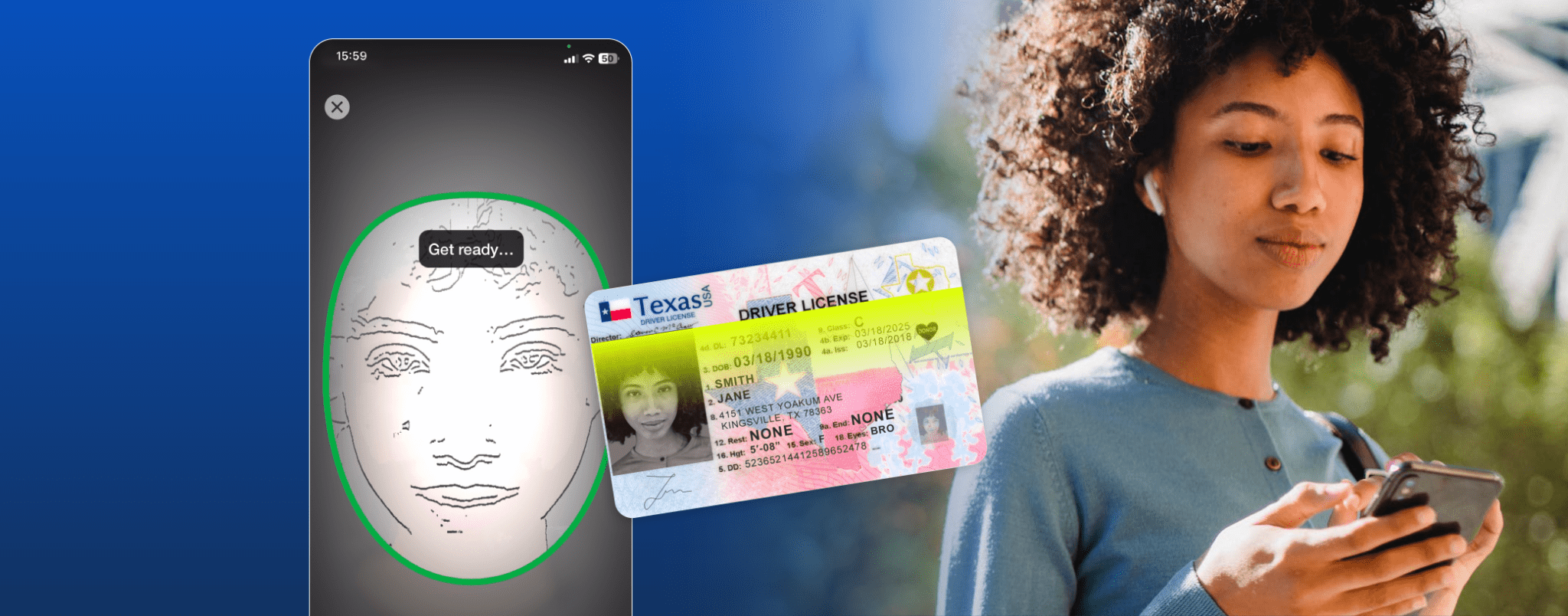

Die digitale Transformation hat die Art und Weise, wie Menschen mit Banken und Finanzdienstleistern interagieren, erheblich erweitert. Dank der Technologie ist das Onboarding von der heimischen Couch aus genauso möglich wie in der Filiale vor Ort.

Einerseits hat die Entwicklung von Fernüberprüfungs- und -authentifizierungstechnologien die Tür für Online-Banking und andere digitale Erfahrungen geöffnet, die für den Einzelnen einfacher und bequemer sind. Andererseits hat sie auch die Betrugsanfälligkeit erhöht.

Darüber hinaus hat eine ausgefeilte Technologie, mit der synthetische Online-Identitäten erstellt werden können, neue Herausforderungen geschaffen. Deepfakes, synthetische Identitätsdokumente (IDs) und digitale Injektionsangriffe haben böswilligen Akteuren die Mittel an die Hand gegeben, um in großem Umfang Schaden anzurichten.

Um mit Betrügern mithalten zu können, müssen Finanzdienstleister ihre Onboarding- und Authentifizierungs-Workflows mit effektiver, präziser Verifizierungstechnologie stärken.

Neue unregulierte Technologien führen zu synthetischen Identitätskompromittierungen

Der herkömmliche Identitätsdiebstahl nimmt zu, verursacht 52 Milliarden Dollar Schaden und betrifft 42 Millionen Erwachsene allein in den USA im Jahr 2021 betroffen sein werden, sind die Banken auch mit einer neuen und komplizierteren Bedrohung konfrontiert: dem synthetischen Identitätsbetrug (SIF).

Während herkömmlicher Identitätsbetrug in der Regel auf der Verwendung gestohlener Informationen beruht, wird bei synthetischem Identitätsbetrug eine "Person" - eine völlig neue Identität - geschaffen, die nicht existiert, indem gestohlene, fiktive oder manipulierte personenbezogene Daten (PII) gemischt werden.

Wie synthetische Identitäten geschaffen werden:

- Die Betrüger erstellen ein detailliertes gefälschtes Identitätsdokument. Diese Informationen können eine Mischung aus echten, gestohlenen und gefälschten Informationen sein - zum Beispiel eine gestohlene Sozialversicherungsnummer in Kombination mit einem völlig gefälschten Namen oder einer leicht veränderten Adresse.

- Anschließend erstellen sie synthetische Bilder, die mit dem Foto auf dem illegalen Ausweisdokument übereinstimmen. Mit dieser Kombination versuchen sie, den Identitätsüberprüfungsprozess einer Organisation zu umgehen.

Die Betrüger bauen in der Regel eine Art von Kredit- oder Bankgeschichte als Teil des Prozesses auf. Das kann zum Beispiel bedeuten, dass sie ihre Kreditlinien ausschöpfen, so dass es für Banken oder Finanzinstitute fast unmöglich ist, zu erkennen, ob diese Personen einfach nur finanzielle Probleme haben (z. B. Arbeitsplatzverlust) oder ob es sich um einen Betrüger handelt, der illegale Aktivitäten begeht - bis es zu spät ist.

Diese aufkommende Betrugsvariante zielt speziell darauf ab, Identitätsdokumente und biometrische Verifizierungstechnologien - den derzeitigen Standard für die digitale Identitätsüberprüfung - zu umgehen, und ist mit Datenüberprüfungen (z. B. Identitätsüberprüfung bei einer Kreditauskunftei) allein fast unmöglich zu fangen. Die Bekämpfung dieser Art von Betrug erfordert einen "Doppelschlag" - einen Ansatz, bei dem die Überprüfung von Identitätsdokumenten und biometrische Technologien zusammenarbeiten, um diese hochentwickelten Bedrohungen zu verhindern.

Was ist synthetische Bildgebung? Warum sind synthetische Bedrohungen, wie generative KI und Deepfakes, ein wachsendes Problem?

Wie bereits erwähnt, ist eine gängige Methode, synthetische Identitäten echt aussehen zu lassen, die Verwendung synthetischer Bilder. Kriminelle können Technologien einsetzen, um realistische Fotos oder Videos zu erstellen, die digital manipuliert wurden, um das Abbild einer Person durch eine andere zu ersetzen oder um sogar Personen zu "erschaffen", die nicht existieren. Generative KI und Deep Fakes sind äußerst wirksame Instrumente, um den Erfolg von synthetischem Identitätsbetrug zu steigern.

Ein Deepfake ist eine Videoaufnahme, die mit Hilfe von Deep-Learning-Techniken verzerrt, manipuliert oder synthetisch erstellt wurde, um eine KI-generierte Darstellung einer Person zu präsentieren - wie eine digitale Maske. Einige der raffiniertesten Varianten von Deepfakes sind von einem echten Gesicht kaum zu unterscheiden, einschließlich natürlicher Augen- und Mundbewegungen. Der Einsatz von Deepfake-Technologie bei synthetischem Identitätsbetrug reicht von Präsentationsangriffen bis hin zu digitalen Injektionsangriffen - beides Versuche, die Gesichtsverifikation zu umgehen.

Banken auf der ganzen Welt haben die Gesichtsverifizierung schnell eingeführt, da sie sich als die sicherste Methode zur Sicherung einer Online-Identität erwiesen hat - im Gegensatz zu den üblichen, schwächeren und unbequemen Methoden wie Passwörtern und OTPs. Die Gesichtsverifizierung ist mittlerweile ein fester Bestandteil des digitalen Bankgeschäfts, und laut einer einer iProov-Umfrageverwenden 64 % der weltweiten Verbraucher, die mobiles Banking nutzen, entweder bereits die Gesichtsverifizierung für den Zugriff auf ihre Konten oder würden dies tun, wenn sie könnten.

Deshalb ist es wichtig, dass jede digitale Onboarding-Lösung digitale Identitäten zuverlässig mit realen Personen verknüpfen kann. Die Microblink-iProov-Lösung bestätigt, dass ein echter Mensch in Echtzeit gegen sein vertrauenswürdiges Identitätsdokument prüft und dass das Dokument nicht manipuliert wurde. Dadurch werden synthetische Identitäten während des Onboardings vereitelt, bevor sie in das System gelangen.

Präsentationsangriffe vs. digitale Injektionsangriffe

Es gibt eine Reihe von Präsentationsangriffen, mit denen Kriminelle versuchen können, sich unrechtmäßig Zugang zum Konto oder zu den Privilegien eines Benutzers zu verschaffen. Neben dem physischen Versuch, sich als echter Benutzer auszugeben, können Präsentationsangriffe auch darin bestehen, dass ein Artefakt vor eine dem Benutzer zugewandte Kamera gehalten wird. Ein böswilliger Akteur könnte auch ein Deepfake erstellen und dieses Video dann über einen anderen Bildschirm dem Gerät zeigen, das die Gesichtsverifizierung durchführt.

Bei digitalen Injektionsangriffen wird dieselbe Deepfake-Technologie eingesetzt, wobei der Betrüger jedoch entweder den Feed des Verifizierungsvideos auf eine softwarebasierte Kamera umleitet, ein Deepfake in den Datenstrom der Anwendung einfügt oder sogar einen Emulator verwendet, um ein Benutzergerät zu imitieren.

Der jüngste Bericht von iProov über Bedrohungsdaten ergab, dass Injektionsangriffe im Jahr 2022 fünfmal häufiger vorkamen als anhaltende Präsentationsangriffe im Internet. Hinzu kommt, dass die Liveness Detection (d. h. Techniken, mit denen festgestellt werden kann, ob es sich bei der Quelle einer biometrischen Probe um einen lebenden Menschen oder eine gefälschte Darstellung handelt) relativ zuverlässig herkömmliche Präsentationsangriffe erkennt, so dass digitale Injektionsangriffe in den Fokus der geschicktesten Betrüger geraten.

Deepfakes werden noch gefährlicher, wenn sie in digital injizierten Angriffen eingesetzt werden, da sie sehr schnell skaliert und automatisiert werden können, um erheblichen Schaden anzurichten.

Wie man synthetische Bilder und digitale Injektionsangriffe bekämpft

Während die meisten biometrischen Technologien ein gewisses Maß an Aktivitätserkennung beinhalten, um die Identität einer Person zu überprüfen, kann die Aktivitätserkennung allein einen digitalen Injektionsangriff nicht erkennen. Um die Kombination aus Deepfakes und Digital-Injection-Angriffen zu bekämpfen, benötigen Finanzdienstleister einen robusten, vielschichtigen Ansatz, der die Erstellung eines biometrischen Einmaldatensatzes nutzt.

Die digitale Onboarding-Lösung von Microblink und iProov nutzt eine einmalige biometrische Technologie, um sicherzustellen, dass jeder, der versucht, seine Identität zu verifizieren, dies in Echtzeit und nicht mit synthetischen Bildern tut.

Und wie? Indem das Gesicht der Person mit einer einzigartigen Farbsequenz beleuchtet wird, die nicht wiedergegeben oder synthetisch manipuliert werden kann. Dadurch wird sichergestellt, dass sich der Benutzer in diesem Moment authentifiziert - es handelt sich nicht um einen Präsentationsangriff mit einem Foto oder einer Maske und auch nicht um einen digital eingebrachten Angriff mit einer Wiederholung einer früheren Authentifizierung oder einem synthetischen Video wie einem Deepfake. Außerdem werden mehrdimensionale Informationen analysiert, die sich aus dem Verhalten des Gesichts und der Reflexion des Lichts auf dem Gesicht ergeben, wodurch synthetisches Bildmaterial aufgedeckt werden kann.

Synthetische IDs bringen mehr Komplexität und Risiko

Vor der explosionsartigen Verbreitung des Online-Bankings war der herkömmliche Identitätsbetrug auf eine Person beschränkt, die jeweils eine gestohlene Identität vorlegte. Der Prozess war langsam und die Wachsamkeit der internen Mitarbeiter war der Schlüssel zur Betrugsbekämpfung und Risikominderung.

Mit synthetischen IDs und dem Aufkommen von Deepfakes können Betrüger den Umfang ihrer Versuche vergrößern, und zwar schneller als je zuvor.

Synthetische IDs sind besonders gefährlich, da sie die Herstellung unzähliger "Personen" ermöglichen, für die sich ein Betrüger ausgeben kann. In einem Beispiel aus dem Bericht von iProovwurden innerhalb von 24 Stunden weltweit etwa 200-300 Angriffe vom selben Standort aus gestartet, um die Sicherheitssysteme eines Unternehmens zu umgehen.

Die Angriffe von Bedrohungsakteuren werden immer skalierbarer und automatisierter, und die synthetischen Bilder, die zur Untermauerung betrügerischer Überprüfungen verwendet werden, sind für das menschliche Auge immer weniger von der Realität zu unterscheiden. Aus diesem Grund benötigen Unternehmen die modernsten Technologien zur Überprüfung von biometrischen Daten und Identitätsdokumenten, um Bedrohungen zu bekämpfen.

Kampf gegen synthetische IDs mit besserem ID-Scanning

Da bösartige Akteure eine Kombination aus echten und gefälschten Informationen nutzen, um synthetische Identitätsdokumente zu erstellen, reicht ein einfacher Scan nicht mehr aus.

Hier kann eine KI-gesteuerte ID-Erfassung, -Extraktion und -Verifizierung ihre Stärken ausspielen. Ein KI-basierter Ansatz kann den gesamten Kontext des gescannten Identitätsdokuments verstehen, Datenkonsistenz- und Validierungsprüfungen für die extrahierten Informationen durchführen und systematisch nach visuellen Mängeln oder Anomalien suchen, um ein höheres Maß an Sicherheit zu bieten.

Durch einen datengesteuerten Ansatz der die nichtforensische und forensische Prüfung verschiedener Identitätsdokumente sowie die Aktivitätserkennung zur Erstellung eines einmaligen biometrischen Merkmals kombiniert, kann Ihr Unternehmen sicher sein, dass die Identitätsdokumente der Benutzer echt sind.

Schließlich sorgen die Flexibilität und das kontinuierliche Lernen einer KI-basierten Lösung dafür, dass sie eine große Mehrheit von ID-Typen und geografischen Varianten extrahieren und verifizieren kann - so stellen Sie sicher, dass Sie Flexibilität und Benutzerfreundlichkeit nicht zugunsten von Sicherheit und Vertrauen opfern.

Risikominderung erfordert die richtigen technischen Partner

Die Kombination aus synthetischen Identitäten und den dazugehörigen IDs sowie Deepfakes erhöhen das Risiko bei digitalen Onboarding-Prozessen für Unternehmen aller Größen und Branchen.

Ohne ein technisches System, das gegen die Raffinesse dieser neuen und verbesserten Betrugsmethoden schützt, drohen Finanzdienstleistern Umsatzeinbußen, der Verlust des Kundenwillens und behördliche Strafen.

Der Einsatz von KI-basierten Technologien zur ID-Erfassung, -Extraktion und -Verifizierung, wie sie von Microblink - neben einmaligen biometrischen Scan-Lösungen wie iProov - ermöglicht ein sichereres digitales Onboarding-Erlebnis. Die Kombination der Sicherheit und Flexibilität dieser bewährten Technologien kann helfen, die wachsende Gefahr von Finanzbetrug zu bekämpfen.