20. August 2024

In einer Zeit, in der die Einstellung von Mitarbeitern aus der Ferne weit verbreitet ist, hat ein kürzlich bekannt gewordener Vorfall die wachsende Bedrohung durch raffinierten Identitätsbetrug in der Arbeitswelt deutlich gemacht. Ein großes Cybersicherheitsunternehmen, KnowBe4wurde Opfer eines ausgeklügelten Plans, bei dem eine Person gestohlene Identitätsdaten und KI-gestützte Bilder nutzte, um sich eine IT-Stelle im Ausland zu sichern.

Dieser Fall unterstreicht den dringenden Bedarf an fortschrittlichen Identitätsüberprüfungsmaßnahmen für das Onboarding von Außendienstmitarbeitern - eine Herausforderung, für die die innovative biometrische Technologie von iProov eine einzigartige Lösung darstellt.

Der Vorfall: Wenn traditionelle Einstellungsprotokolle versagen

KnowBe4, ein auf Sicherheitsschulungen spezialisiertes Unternehmen, entdeckte, dass ein Software-Ingenieur, den es kürzlich eingestellt hatte, in Wirklichkeit ein Bedrohungsakteur aus Nordkorea war, der eine gestohlene US-Identität und ein KI-verbessertes Foto benutzte. Trotz der Einführung gründlicher Einstellungsprotokolle, einschließlich Videointerviews, Hintergrundüberprüfungen und Referenzüberprüfungen, wurde die Täuschung erst aufgedeckt, als der neue Mitarbeiter begann, Malware auf die Geräte des Unternehmens zu laden.

Dieser Angriff war äußerst raffiniert. Der Hacker benutzte eine gültige, aber gestohlene US-Identität und ein KI-verbessertes Foto, das aus Archivbildern stammt, um die Einstellungsprotokolle des Unternehmens zu umgehen. Sie ließen sich den Arbeitsplatzrechner sogar an eine Adresse schicken, die als "IT-Maultier-Laptop-Farm" genutzt wird, und griffen über VPN darauf zu, um Arbeitszeiten in den USA zu simulieren.

Dieser Vorfall zeigt das Potenzial für katastrophale Sicherheitsverletzungen und verdeutlicht die Grenzen traditioneller Einstellungs- und Überprüfungsprozesse im digitalen Zeitalter - Gefahren, vor denen iProov bereits seit unserer "Work From Clone"-Kampagne vor über zwei Jahren (lesen Sie hier mehr über Deepfake-Working-Betrug).

Die Deepfake-Bedrohung ist mehr als nur ein Trend

Deepfakes sind KI-generierte Videos oder Bilder, auf denen Personen zu sehen sind, die Dinge sagen oder tun, die sie in Wirklichkeit nicht getan haben, und die eine große Herausforderung für herkömmliche Identitätsüberprüfungsmethoden darstellen.

Während wir uns auf Deepfakes oder manipulierte Bilder im beruflichen Umfeld konzentriert haben, sind Identitätsspoofs und Deepfakes auch in anderen Bereichen weit verbreitet. Betrachten Sie diese Beispiele aus der Praxis:

- Politik: Deepfakes werden zu einem mächtigen Werkzeug in politischen Desinformationskampagnen, mit möglichen Auswirkungen auf die globale Demokratie und die Integrität von Wahlen; Die Ära der Deepfakes in der Politik ist bereits angebrochen. Zu den jüngsten prominenten Fällen gehört ein synthetischer Biden, der die Einwohner von New Hampshire dazu auffordert, nicht an einer bevorstehenden Vorwahl teilzunehmen. AAI-generiertes Bild einer Explosion im Pentagon Pentagon sorgte sogar für einen kurzen Einbruch an der Börse.

- Soziale Medien: Instagram und TikTok haben einen Anstieg von "digitale Avatare" - KI-generierte Influencer die keine echten Menschen darstellen, aber mit ihren Followern interagieren, als wären sie Menschen.

- Dating-Apps: Es gibt immer mehr Berichte über "Catfishing" und Romantik-Betrügereien mit KI-generierten Profilbildern und sogar Echtzeit-DeepfakesDadurch wird es für die Nutzer schwieriger, zwischen echten und gefälschten Profilen zu unterscheiden. Aus diesem Grund haben viele Apps wie Tinder Maßnahmen zur Identitätsüberprüfung eingeführt.

- Finanz-/Kryptowährungsbetrug: Deepfake-Videos von bekannten Persönlichkeiten wie Elon Musk wurden verwendet, um für betrügerische Kryptowährungsprogramme zu werben - wie im folgenden Video zu sehen ist:

Diese Beispiele verdeutlichen, wie Deepfakes und Identitätsspoofing-Technologien in verschiedenen Lebensbereichen eingesetzt werden. Wenn wir uns dieser breiteren Trends bewusst sind, können wir uns besser darauf vorbereiten, potenzielle Deepfake-Bedrohungen in der Belegschaft zu erkennen und uns dagegen zu schützen.

Dieses besondere Element des Deepfake-Betrugs am Arbeitsplatz ist Teil eines größeren Trends, den das FBI im Juni 2022 bekannt gabveröffentlichte, bei dem Cyberkriminelle synthetische Identitäten - die in der Regel aus einer Kombination von Fälschungen und gestohlenen persönlichen Daten bestehen, um sich für Stellen im Ausland zu bewerben.

Ajay Amlani - SVP, Head of Americas bei iProov - betonte die Raffinesse dieser Angriffe in einem aktuellen Interview mit IT Brew: "Man kann sein Aussehen während eines Anrufs so verändern, dass man sich als jeder darstellen kann, als der man sich darstellen möchte - als Mann, als Frau, als 12-Jähriger, als 46-Jähriger, als ein anderes Land, eine andere Ethnie."

Diese Bedrohung ist heute dringender denn je und erfordert unternehmenskritische Sicherheit, die sicherstellt, dass eine bestimmte Person die richtige Person ist, eine echte Person, die in Echtzeit interagiert.

Die Beweggründe für diese Angriffe

Während ein monatlicher Gehaltsscheck manchmal die offensichtliche Motivation ist, kann es auch ein weitaus dunkleres Ziel geben. Amlani klärt auf: "Indem er sich eine technische Funktion im Unternehmen sichert, hat der Angreifer dann Zugang zu personenbezogenen Kundeninformationen, Finanzdaten, IT-Datenbanken des Unternehmens und/oder geschützten Informationen."

Cyberkriminelle können diesen Zugang nutzen, um:

- Das Unternehmen als Geisel nehmen

- Weitere Cyberangriffe durchführen

- Geistiges Eigentum stehlen

- Verkauf sensibler Daten im Dark Web

Was diese Vorfälle besonders besorgniserregend macht, ist die Skalierbarkeit: Deepfakes sind schnell reproduzierbar (insbesondere mit Fortschritten in der in der generativen KI), was bedeutet, dass es für den Kriminellen ein Leichtes ist, denselben Angriff immer wieder zu wiederholen. Die Beschäftigung in einer Reihe verschiedener Organisationen könnte dem Kriminellen oder seiner kriminellen Organisation erhebliche finanzielle Vorteile bringen und den Organisationen, die ihn beschäftigen, erheblichen Schaden zufügen.

Die Grenzen der derzeitigen Überprüfungsmethoden (Warum wir uns nicht allein auf unsere Augen verlassen können)

Viele Unternehmen setzen bei der Einstellung von Mitarbeitern auf Videointerviews. Diese Methode ist jedoch zunehmend unzuverlässig bei der Erkennung von Fälschungen. Wie iProovs Forschung zeigt, Mit einem einfachen Plug-in können Angreifer einen so genannten "Echtzeit-Deefake" erstellen; das Video kann dann in Kommunikationskanäle für Videokonferenzen gestreamt werden. Dies war auch die Angriffsmethodik, die in dem $25 M Arup Zoom-basierter Deepfake-Vorfall

Außerdem ist die menschliche Fähigkeit, Deepfakes zu erkennen, bei den raffiniertesten Deepfakes fast nicht vorhanden. Eine iProov Umfrage ergab, dass 57 % der Befragten glaubten, sie könnten ein echtes Video zwischen einem echten Video und einem Deepfake zu unterscheiden. Dieses Vertrauen ist jedoch unangebracht. Studien haben gezeigt, dass Menschen in der Regel nicht in der Lage sind, echte Gesichter von Fälschungen zu unterscheiden, und eine Studie ergab, dass nur 24 % der Probanden gut gemachte Fälschungen erkennen konnten.

Die Alan Turing Institut bestätigtdass es "zunehmend schwieriger, möglicherweise sogar unmöglich wird, zuverlässig zwischen echten und synthetischen Medien zu unterscheiden".

Menschliche Inspektion und Videogespräche sind nicht eine praktikable Lösung - Eine wissenschaftlich fundierte biometrische Erkennung der Lebendigkeit ist unerlässlich.

Die Lösung von iProov: Wissenschaftlich fundierte Biometrie

Das Wesen von Remote Onboarding und Remote Working schafft eine physische Distanz zwischen Arbeitgeber und Arbeitnehmer. Es kann sein, dass sie sich nie persönlich treffen, was es immer schwieriger macht, zu überprüfen, ob jemand derjenige ist, der er vorgibt zu sein, wenn er sich für eine Stelle bewirbt.

Die Herausforderung der Identitätsüberprüfung aus der Ferne umfasst auch eine vielfältige erweiterte Belegschaft. Auftragnehmer, Mitarbeiter in der Lieferkette, Saisonarbeiter, Zeitarbeiter und andere nicht angestellte Arbeitskräfte stellen im digitalen Zeitalter eine besondere Herausforderung für die Überprüfung dar. Diese unterschiedlichen Mitarbeiterkategorien haben oft nur eine begrenzte physische Interaktion mit den Unternehmen, die sie unterstützen, was die Sache noch schwieriger macht. Da Unternehmen zunehmend auf flexible, verteilte Arbeitskräfte angewiesen sind, wird die Notwendigkeit einer robusten Fernauthentifizierung für alle Arten von Arbeitskräften immer dringlicher.

Zur Bekämpfung dieser sich entwickelnden Bedrohung bietet iProov eine Suite biometrischer Lösungen mit Lösungen für Remote Onboarding und Authentifizierung. Diese Lösungen gehen über die traditionellen Methoden der Identitätsüberprüfung hinaus und bieten eine vielseitige Lösung, die in der modernen Arbeitswelt einheitlich angewendet werden kann.

Die Biometric Solutions Suite bietet:

- Schutz vor Präsentationsangriffen: Unterscheidet zwischen einer echten Person und einem Präsentationsangriff und verhindert die Verwendung von Fotos, Videos oder Masken, um das System zu täuschen.

- Schutz vor digitaler Injektion: Er erkennt digital eingeschleuste Angriffe, einschließlich solcher mit Deepfakes, die die Gerätesensoren umgehen.

- Aktives Bedrohungsmanagement: erkennt aufkommende Bedrohungen in Echtzeit und reagiert darauf, wobei kontinuierliche Updates ohne Unterbrechung für den Kunden oder Endbenutzer bereitgestellt werden.

- Branchenführende iProov-Ergebnisse, mit >98% Erfolgsquote

... und vieles mehr. Durch die Implementierung der Biometric Solutions Suite von iProov können Unternehmen die Risiken im Zusammenhang mit Betrug bei der Einstellung von Mitarbeitern aus der Ferne deutlich verringern. Diese Technologie schützt nicht nur vor unmittelbaren Bedrohungen, sondern bildet auch die Grundlage für sichere Remote-Arbeitspraktiken in der Zukunft.

Erfahren Sie mehr über die iProov Biometric Solutions Suite in dieser Infografik

Sie können unser Biometric Adoption Navigator hier um herauszufinden, ob die iProov-Lösungssuite für Sie geeignet ist.

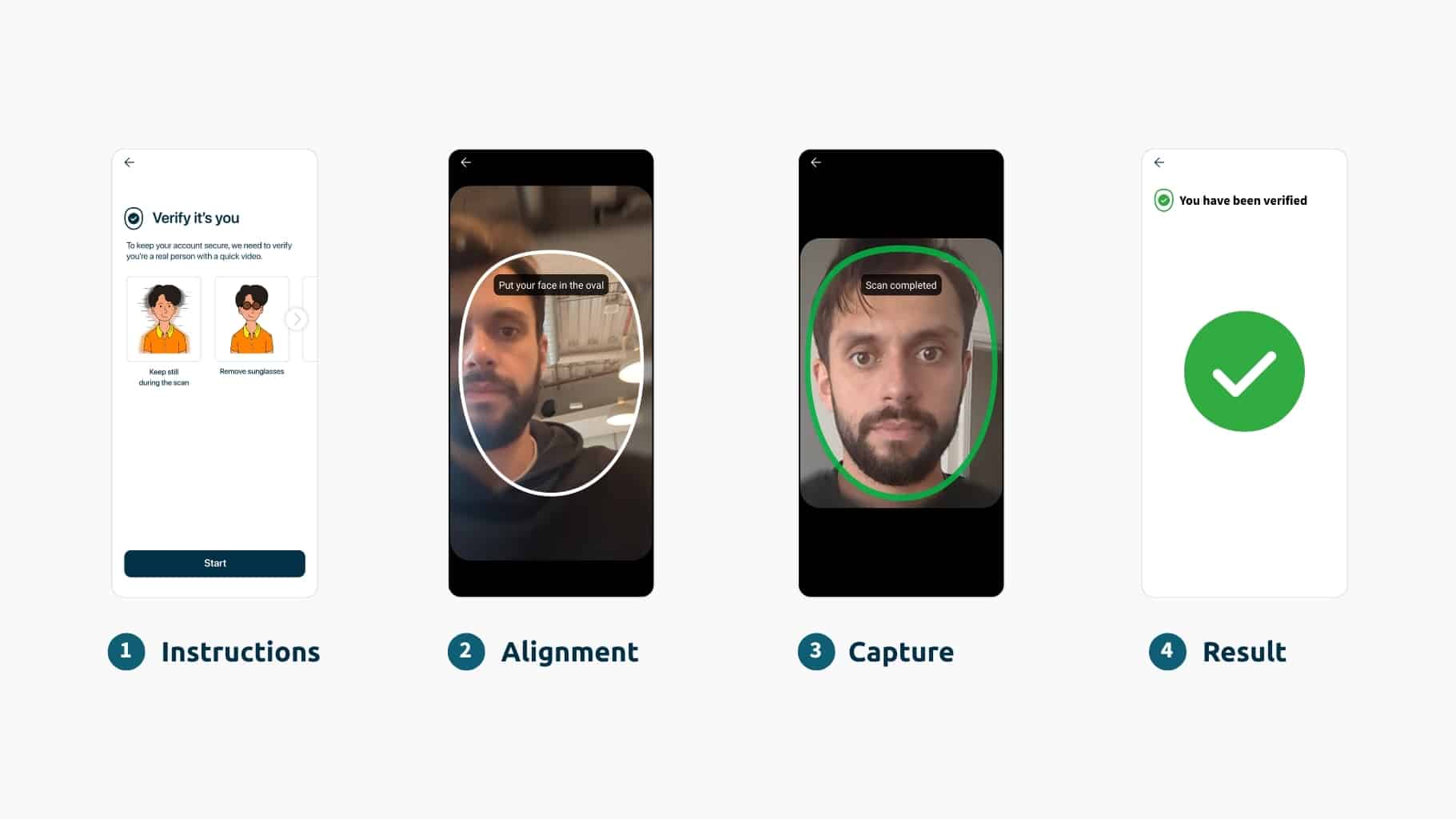

Wie es funktioniert: Implementierung von iProov in Ihren Einstellungsprozess

In einem Ferneinstellungsszenario könnte ein Bewerber sich selbst verifizieren, wenn er seine Bewerbung einreicht. Er würde ein Fotoausweisdokument wie einen Führerschein oder Reisepass scannen und dann sein Gesicht scannen, um zu beweisen, dass er derjenige ist, der er vorgibt zu sein.

Die Technologie von iProov geht über einen einfachen Gesichtsabgleich hinaus. Sie stellt sicher, dass die Person nicht nur diejenige ist, die sie vorgibt zu sein, sondern auch eine echte Person ist und sich gerade authentifiziert. Dieser dreigleisige Ansatz - richtige Person, echte Person, Authentifizierung zum jetzigen Zeitpunkt - ist entscheidend für die Bekämpfung von ausgeklügeltem Identitätsbetrug wie dem Knowbe4-Vorfall.

Die Dringlichkeit der Bedrohung: Schützen Sie Ihr Unternehmen noch heute

Die Bedrohung durch ausgeklügelten Identitätsbetrug bei der Einstellung von Mitarbeitern per Fernzugriff ist kein Problem der Zukunft - sie findet bereits jetzt statt. Amlani warnt: "Es ist ein ziemlich schnell wachsendes Betrugsfeld, sich für eine andere Person auszugeben, insbesondere während des Einstellungsprozesses. Ich höre von zahlreichen Personalverantwortlichen, dass sie diese Art von Angriffen nicht nur von Einzelpersonen sehen, die hoffen, mehrere Gehaltsschecks zu kassieren, sondern tatsächlich von Gegnern, die versuchen, sich Zugang zu ihren Systemen zu verschaffen."

Stu Sjouwerman, der Gründer und CEO von KnowBe4, betonte, wie wichtig es sei, aus diesem Vorfall zu lernen: "Wenn es uns passieren kann, kann es fast jedem passieren. Lassen Sie es nicht zu, dass es Ihnen passiert."

Ein Weckruf für Organisationen weltweit

Angesichts der zunehmenden Fernarbeit und des Einsatzes erweiterter Belegschaften müssen Unternehmen die Bedrohung durch raffinierten Identitätsbetrug ernst nehmen. Die Implementierung robuster Identitätsüberprüfungsprozesse kann das Risiko eines Einstellungsbetrugs erheblich verringern und vor potenziell katastrophalen Sicherheitsverletzungen schützen.

Durch den Einsatz der fortschrittlichen biometrischen Verifikationstechnologie von iProov können Unternehmen in dieser komplexen Landschaft navigieren und die Integrität ihrer Mitarbeiter und die Sicherheit ihrer Systeme in einer zunehmend digitalen Welt gewährleisten. Das Engagement von iProov für kontinuierliche Forschung und Entwicklung stellt sicher, dass die iProov-Technologie den neuen Bedrohungen immer einen Schritt voraus ist und Unternehmen einen robusten Schutzschild gegen die sich ständig verändernde Landschaft des Identitätsbetrugs bietet.