30 novembre 2023

I deepfakes e altri media sintetici - in gran parte creati dalla tecnologia AI generativa - stanno diventando sempre più noti ed è ormai ampiamente accettato che i media sintetici sono un problema per gli individui, le organizzazioni e la società.

I deepfake si presentano in molte forme, come rievocazioni, scambi di volti e reti avversarie generative (GAN). È essenziale comprendere le diverse forme di attacchi deepfake per difendersi da essi.

La questione dell'IA generativa è particolarmente urgente, poiché la frequenza di questi attacchi è in aumento, in quanto diventa sempre più facile creare immagini sintetiche convincenti. Poiché l'IA generativa continua a progredire in termini di sofisticazione, accessibilità e scalabilità, sarà sempre più difficile fidarsi di ciò che vediamo e di chi interagisce online.

In questo articolo demistificheremo il mondo spesso complesso delle frodi basate sull'IA generativa e spiegheremo le metodologie alla base di ciascun tipo.

Che cos'è l'IA generativa?

L'Intelligenza Artificiale Generativa (IA) si riferisce ad algoritmi in grado di generare nuovi contenuti - inclusi testi, immagini, video o altri media - in risposta a un input o a un prompt dato. Spesso sfruttando tecnologie come le reti neurali e la computer vision, l'IA generativa impara dai modelli e dalla struttura dei "dati di addestramento" esistenti per creare contenuti. L'"IA analitica", ad esempio, serve ad analizzare i dati esistenti e ad automatizzare il processo di individuazione di schemi o di estrapolazione di tendenze che possono essere utili in campi come la medicina e i dati sanitari.

L'IA generativa ha conquistato lo zeitgeist tecnologico, con uguale stupore e polemica per strumenti come Chat-GPT. Questi strumenti possono accelerare in modo significativo la creazione di contenuti, ma c'è una reale preoccupazione per il modo in cui possono essere utilizzati dai criminali nella corsa agli armamenti della cybersicurezza, rafforzando le frodi e l'ingegneria sociale, la disinformazione e la criminalità informatica attraverso contenuti sintetici manipolativi.

Inoltre, la crescente accessibilità degli strumenti di IA generativa nei mercati crime-as-a-service significa che gli aggressori meno esperti di tecnologia hanno ora accesso facile e conveniente a strumenti sofisticati per creare media sintetici. Le opzioni software più tecnologiche di ieri sono ormai comuni, poiché la barriera tecnologica si è dissolta.

Una prova recente della qualità di queste parodie generate dall'IA è stata presentata in uno studio condotto dal Center for Strategic and International Studies, che indica che "abbiamo raggiunto il punto di inflessione in cui gli esseri umani non sono in grado di distinguere in modo significativo tra i contenuti digitali generati dall'IA e quelli creati dall'uomo".

In questo articolo ci concentriamo in particolare sull'IA generativa utilizzata per creare immagini sintetiche, compresi i deepfake .

Comprendere i diversi tipi di attacchi Deepfake

Prendiamoci un momento per capire alcune delle forme di attacco dell'IA generativa.

Scambi di volti: Una forma di media sintetici creati utilizzando due input. Combinano video o flussi live esistenti e sovrappongono un'altra identità al feed originale in tempo reale. Il risultato finale è un falso video 3D, che viene unito da più di un volto, ma con il modello biometrico dell'individuo autentico ancora intatto, anche se visivamente la somiglianza è più vicina a quella dell'aggressore. Un face matcher che non disponga di difese adeguate potrebbe identificare l'output come l'individuo autentico.

Rievocazioni: Conosciuti anche come deepfakes "puppet-master". In questa tecnica l'espressione facciale e i movimenti della persona nel video o nell'immagine di destinazione sono controllati dalla persona nel video di origine. Un esecutore seduto davanti a una telecamera guida il movimento e la deformazione di un volto che appare in un video o in un'immagine. Mentre lo scambio di volti sostituisce l'identità di partenza con quella di arrivo (manipolazione dell'identità), le rievocazioni si occupano della manipolazione delle espressioni facciali di un ingresso alla volta.

Reti avversarie generative (GAN): Una GAN funziona grazie a due modelli di intelligenza artificiale che competono tra loro per creare un risultato il più possibile "accurato" o autentico di un deepfake. I due modelli - uno generativo e uno discriminante - creano e distruggono in tandem. Il modello generativo crea contenuti basati sui dati di formazione disponibili per imitare gli esempi presenti nei dati di formazione. Nel frattempo, un modello discriminante verifica i risultati del modello generativo valutando la probabilità che il campione testato provenga dal set di dati piuttosto che dal modello generativo. I modelli continuano a migliorare fino a quando il contenuto generato ha la stessa probabilità di provenire dal modello generativo e dai dati di addestramento. Questo metodo è così efficace perché migliora il risultato della sua stessa autenticità, controllando costantemente gli stessi strumenti progettati per superarlo.

In che modo gli attacchi di intelligenza artificiale generativa sono tipicamente utilizzati dai truffatori?

La creazione e l'utilizzo di immagini sintetiche generate dall'intelligenza artificiale non sono intrinsecamente criminali. Tuttavia, le immagini sintetiche sono purtroppo un dono per i criminali informatici, in quanto favoriscono reati come l'estorsione e le molestie, la diffusione mirata di disinformazione politica o l'agevolazione di frodi di identità e di documenti (come il tentativo di eludere i controlli di verifica dell'identità imposti dalle norme Know Your Customer).

Le forme più comuni di frode supportate da immagini sintetiche includono:

Qual è la differenza tra media sintetici alterati e generati digitalmente?

I media sintetici sono l'output dell'IA generativa, ma non tutti i media sintetici sono creati dall'IA generativa.

L'IA generativa genera dati completamente nuovi, unici e originali, invece di elaborare, analizzare e modificare semplicemente i dati esistenti. Questa distinzione potrebbe essere riassunta come immagini generate digitalmente e immagini alteratedigitalmente.

Perché tutti parlano di IA generativa?

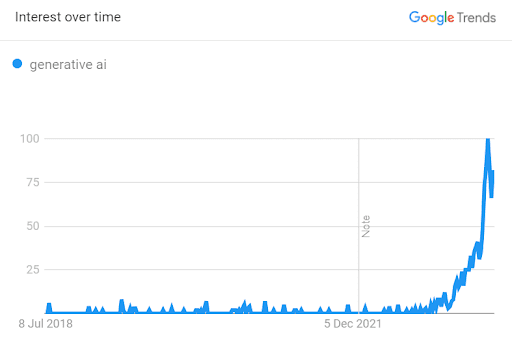

Sebbene l'IA possa offrire una serie di casi d'uso positivi, come l'automazione dei compiti, l'ispirazione creativa e l'analisi di serie di dati complessi, i pericoli dell'IA generativa sono attualmente al centro dell'attenzione.

Nota: Google Trends rappresenta il numero di ricerche organiche per un termine specifico nel corso del tempo; i dati del grafico sono normalizzati da un intervallo di 0 a 100 e sono indicati come "interesse nel tempo".

Nota: Google Trends rappresenta il numero di ricerche organiche per un termine specifico nel corso del tempo; i dati del grafico sono normalizzati da un intervallo di 0 a 100 e sono indicati come "interesse nel tempo".

Una cosa è certa: l'IA generativa sta avanzando rapidamente e promette impatti profondamente dirompenti e trasformativi in diversi settori.

L'IA generativa ha catturato l'interesse del pubblico, dei politici e dei governi. Per saperne di più sull'IA generativa e sul settore pubblico, si veda questo articolo, che fornisce un elenco di risposte da parte di governi e responsabili politici di tutto il mondo e illustra come iProov si stia tutelando contro questa minaccia.

Nell'attuale mondo digitale, la superficie di attacco digitale è più ampia, con un maggior numero e varietà di transazioni ad alto rischio che avvengono online, il che spesso significa maggiori guadagni per i truffatori. In definitiva, la preoccupazione è che i malintenzionati possano utilizzare i media sintetici generati dall'intelligenza artificiale per scopi fraudolenti e per facilitare la diffusione di false informazioni online.

Riflessioni conclusive su IA generativa e verifica biometrica del volto

Un volto umano autentico è unico e non può essere replicato: ecco perché la verifica biometrica del volto si è affermata come il metodo più sicuro e conveniente per verificare l'identità degli utenti online.

Una cosa è chiara: la tecnologia biometrica sarà un'ancora di salvezza per verificare la presenza reale a distanza, soprattutto perché le repliche non possono più essere distinte dall'occhio umano. In realtà, solo i sistemi più avanzati che hanno combattuto questa corsa agli armamenti in rapida espansione sono in grado di riconoscere l'intelligenza artificiale generativa.

Come può aiutare iProov

Per verificare un deepfake, iProov utilizza una tecnologia biometrica brevettata una tantum con tecnologie di deep learning e computer vision per analizzare alcune proprietà che i media generativi creati dall'IA non possono ricreare, poiché non c'è una persona reale dall'altra parte della telecamera. Per questo motivo, la presenza di un biometrico in tempo reale incorporato nella tecnologia Liveness è fondamentale per le organizzazioni, che possono così distinguere tra media sintetici e persone reali.

Per saperne di più su come i truffatori stanno sfruttando l'IA generativa per minare la verifica dell'identità e rafforzare la frode dell'identità sintetica, leggete il nostro nuovo rapporto "Stolen to Synthetic" qui.

Prenotate una demo o richiedete una consulenza personalizzata con un esperto iProov qui oggi stesso.