30 de novembro de 2023

Os deepfakes e outros meios de comunicação sintéticos - em grande parte criados por tecnologia de IA generativa - estão a tornar-se cada vez mais conhecidos, e é agora amplamente aceite que os meios de comunicação sintéticos são um problema para os indivíduos, as organizações e a sociedade.

As deepfakes têm muitas formas, como reencenações, trocas de rosto e Redes Adversárias Generativas (GANs). É essencial compreender as diferentes formas de ataques de deepfake para se defender contra eles.

A questão da IA generativa é particularmente premente, uma vez que a frequência destes ataques está a aumentar, pois torna-se cada vez mais fácil criar imagens sintéticas convincentes. À medida que a IA generativa continua a avançar em termos de sofisticação, acessibilidade e escalabilidade, será cada vez mais difícil confiar no que vemos e nas pessoas com quem interagimos em linha.

Neste artigo, vamos desmistificar o mundo frequentemente complexo da fraude baseada em IA generativa e explicar as metodologias subjacentes a cada tipo.

O que é a IA generativa?

A Inteligência Artificial (IA) generativa refere-se a algoritmos que podem gerar novos conteúdos - incluindo texto, imagens, vídeo ou outros meios de comunicação - em resposta a uma determinada entrada ou pedido. Utilizando frequentemente tecnologias como as redes neuronais e a visão por computador, a IA generativa aprende com padrões e estruturas dos "dados de treino" existentes para criar conteúdos. Por exemplo, a "IA analítica" serve para analisar dados existentes e automatiza o processo de deteção de padrões ou de extrapolação de tendências, o que pode ser útil em domínios como a medicina e os dados de saúde.

A IA generativa conquistou o zeitgeist tecnológico, com igual quantidade de admiração e controvérsia em torno de ferramentas como o Chat-GPT. Estas ferramentas podem acelerar significativamente a criação de conteúdos, mas existe uma preocupação real quanto à forma como podem ser utilizadas como arma pelos criminosos na corrida às armas da cibersegurança - reforçando a fraude e a engenharia social, a desinformação e a cibercriminalidade através de conteúdos sintéticos manipuladores.

Além disso, a crescente acessibilidade das ferramentas de IA generativa nos mercados de crime como serviço significa que os atacantes menos experientes em tecnologia têm agora acesso fácil e económico a ferramentas sofisticadas para criar meios sintéticos. As opções de software de alta tecnologia de ontem são agora comuns, à medida que a barreira tecnológica se evapora.

Uma prova recente da qualidade destas paródias geradas por IA foi apresentada num estudo realizado pelo Centro de Estudos Estratégicos e Internacionais, que indica que "atingimos o ponto de inflexão em que os humanos não conseguem distinguir significativamente entre conteúdos digitais gerados por IA e conteúdos digitais criados por humanos".

Neste artigo, centramo-nos especialmente na IA generativa utilizada para criar imagens sintéticas, incluindo deepfakes.

Compreender os diferentes tipos de ataques Deepfake

Vejamos algumas das formas de ataques de IA generativa.

Troca de faces: Uma forma de media sintético criado com dois inputs. Combinam vídeos existentes ou transmissões em direto e sobrepõem outra identidade ao feed original em tempo real. O resultado final é um vídeo 3D falso, que é fundido a partir de mais do que um rosto, mas com o modelo biométrico do indivíduo genuíno ainda intacto, mesmo que visualmente a semelhança seja mais próxima da do atacante. Um identificador de rostos sem as defesas adequadas pode identificar o resultado como o indivíduo genuíno.

Reencenações: Também conhecidas como deepfakes "puppet-master". Nesta técnica, a expressão facial e os movimentos da pessoa no vídeo ou imagem alvo são controlados pela pessoa no vídeo de origem. Um artista sentado em frente a uma câmara guia o movimento e a deformação de um rosto que aparece num vídeo ou imagem. Enquanto as trocas de rosto substituem a identidade de origem pela identidade de destino (manipulação da identidade), as reconstituições tratam da manipulação das expressões faciais de um input de cada vez.

Redes Adversariais Generativas (GANs): Uma GAN funciona através de dois modelos de IA que competem entre si para criar o resultado mais "exato" ou autêntico possível de um deepfake. Os dois modelos - um generativo e outro discriminatório - criam e destroem em simultâneo. O modelo generativo cria conteúdo com base nos dados de treino disponíveis para imitar os exemplos nos dados de treino. Entretanto, um modelo discriminativo testa os resultados do modelo generativo, avaliando a probabilidade de a amostra testada ser proveniente do conjunto de dados e não do modelo generativo. Os modelos continuam a melhorar até que o conteúdo gerado tenha a mesma probabilidade de provir do modelo generativo do que dos dados de treino. Este método é tão eficaz porque melhora o resultado da sua própria autenticidade, verificando constantemente as ferramentas concebidas para o ultrapassar.

Como é que os ataques de IA generativa são normalmente utilizados pelos autores de fraudes?

Criar e utilizar imagens sintéticas geradas por IA não é inerentemente criminoso. No entanto, as imagens sintéticas são, infelizmente, uma dádiva para os cibercriminosos - ajudando crimes como a extorsão e o assédio, espalhando propositadamente desinformação política ou facilitando a fraude de identidade e de documentos (como a tentativa de contornar os controlos de verificação de identidade exigidos pelos regulamentos "Know Your Customer").

As formas comuns de fraude apoiadas por imagens sintéticas incluem:

Qual é a diferença entre meios de comunicação sintéticos alterados digitalmente e gerados digitalmente?

Os meios sintéticos são o resultado da IA generativa, mas nem todos os meios sintéticos são criados pela IA generativa.

A IA generativa gera dados inteiramente novos que são únicos e originais, por oposição ao simples processamento, análise e modificação de dados existentes. Esta distinção pode ser resumida como imagens geradas digitalmente versus imagens alteradasdigitalmente.

Porque é que toda a gente fala de IA generativa?

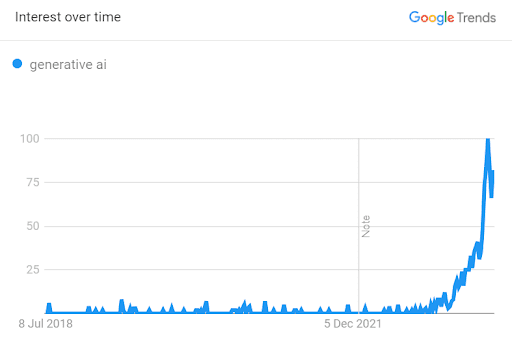

Embora a IA possa proporcionar uma série de casos de utilização positivos - incluindo a automatização de tarefas, a inspiração criativa e a análise de conjuntos de dados complexos - os perigos da IA generativa estão atualmente a assumir um papel central.

Nota: O Google Trends representa o número de pesquisas orgânicas para um termo específico ao longo do tempo; os dados do gráfico são normalizados a partir de um intervalo de 0 a 100 e são referidos como "interesse ao longo do tempo".

Nota: O Google Trends representa o número de pesquisas orgânicas para um termo específico ao longo do tempo; os dados do gráfico são normalizados a partir de um intervalo de 0 a 100 e são referidos como "interesse ao longo do tempo".

Uma coisa é certa: a IA generativa está a avançar rapidamente e promete impactos profundamente disruptivos e transformacionais numa variedade de indústrias.

A IA generativa captou o interesse do público, dos decisores políticos e dos governos. Pode saber mais sobre a IA generativa e o sector público neste artigo - que fornece uma lista de respostas de governos e decisores políticos de todo o mundo e detalha como o iProov está a proteger-se contra a ameaça.

No mundo digital de hoje, existe uma maior superfície de ataque digital com um maior número e variedade de transacções de alto risco que ocorrem em linha - o que muitas vezes significa maiores recompensas para os autores de fraudes. Em última análise, a preocupação é a forma como os maus actores podem utilizar os meios sintéticos gerados pela IA para fins fraudulentos e para facilitar a difusão de informações falsas em linha.

Considerações finais sobre a IA generativa e a verificação biométrica de rostos

Um rosto humano genuíno é único e não pode ser verdadeiramente replicado - é por isso que a verificação biométrica do rosto surgiu como o método mais seguro e conveniente de verificar a identidade do utilizador em linha.

Uma coisa é certa: a tecnologia biométrica servirá de tábua de salvação para verificar a presença genuína à distância, sobretudo porque as réplicas já não podem ser distinguidas pelo olho humano. Na verdade, apenas os sistemas mais avançados que têm estado a combater esta corrida ao armamento em rápida expansão estão equipados para reconhecer a IA generativa.

Como o iProov pode ajudar

Para verificar um deepfake, o iProov utiliza tecnologia biométrica única patenteada com tecnologias de aprendizagem profunda e de visão computacional para analisar determinadas propriedades que os meios geradores criados por IA não conseguem recriar - uma vez que não existe uma pessoa real do outro lado da câmara. É por isso que ter uma biometria em tempo real incorporada na tecnologia de vivacidade é fundamental para que as organizações possam distinguir entre meios sintéticos e pessoas genuínas.

Para saber mais sobre como os fraudadores estão a aproveitar a IA generativa para minar a verificação de identidade e reforçar a fraude de identidade sintética, leia o nosso novo relatório "Stolen to Synthetic" aqui.