26 de novembro de 2024

A Inteligência Artificial (IA) é, simultaneamente, o nosso maior aliado e o nosso adversário mais perigoso. Os riscos nunca foram tão elevados, uma vez que as organizações em todo o mundo se debatem com ameaças impulsionadas pela IA, como deepfakes e conteúdos gerados por IA, ao mesmo tempo que confiam na IA para detetar e mitigar estes potenciais perigos.

Nesta série de duas partes, desvendamos estes tópicos examinando o cenário de ameaças, discutindo o impacto da IA através da lente dos decisores tecnológicos e considerando as recomendações da Gartner para encontrar as melhores soluções e recomendações.

Os resultados do inquérito destacam a IA como "uma espada de dois gumes"

O mais recente inquérito global da iProov - The Good, The Bad, and The Ugly - reuniu as opiniões de 500 decisores tecnológicos do Reino Unido, EUA, Brasil, Austrália, Nova Zelândia e Singapura sobre a ameaça da IA generativa e das deepfakes.

Este inquérito revelou um paradoxo surpreendente: enquanto 68% dos inquiridos acreditam que a IA generativa cria ameaças à cibersegurança, um número ainda maior de 84% consideram-na impactante na proteção contra essas mesmas ameaças.

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 4 Bom Mau Feio Impacto Extractal da Aprendizagem Automática da Geração AI](https://www.iproov.com/wp-content/uploads/2024/11/Good-Bad-Ugly-Extract-Impact-Of-Gen-AI-Machine-Learning.png)

Por um lado, as tecnologias alimentadas por IA, como os deepfakes, dotaram os atacantes de ferramentas sofisticadas para personificar indivíduos e criar identidades falsas convincentes em linha.

Por outro lado, a IA serve como uma linha de defesa crucial. Por exemplo, deteção biométrica da vivacidade utiliza algoritmos de IA para identificar e impedir tentativas de engano digital, detectando imagens e vídeos manipulados (com melhor fiabilidade do que o olho humano).

A Arena dos Algoritmos: IA vs. IA

À medida que os ataques alimentados por IA aumentam a sua sofisticação, o mesmo acontece com as defesas orientadas por IA. Esta corrida ao armamento tecnológico está a remodelar a cibersegurança.

Os cibercriminosos tiram partido da IA para criar e-mails de phishing mais convincentes, desenvolver malware complexo e orquestrar ataques em grande escala. Simultaneamente, as equipas de cibersegurança aproveitam o poder da IA para detetar anomalias, prever potenciais ameaças e responder a incidentes com uma velocidade e precisão sem precedentes.

Sem surpresas, as deepfakes estão agora empatadas em terceiro lugar entre as preocupações mais prevalecentes dos inquiridos, pela seguinte ordem:

- Violação de palavras-passe (64%)

- Ransomware (63%)

- Ataques de phishing/engenharia social (61%)

- Deepfakes (61%)

A inclusão das falsificações profundas entre estas três principais preocupações indica uma consciencialização crescente desta ameaça emergente.

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 5 Estatísticas das opiniões sobre o Deepfake na América Latina](https://www.iproov.com/wp-content/uploads/2024/11/Latam-Deepfake-opinions-statistics.png)

As organizações devem adotar técnicas avançadas que se adaptem ao terreno em rápida aceleração das ciberameaças, utilizando a IA para o bem da cibersegurança.

A crise do Deepfake na segurança das empresas

Não é de admirar que o aumento das falsificações profundas tenha surgido como um dos desenvolvimentos mais alarmantes da IA.

Os deepfakes são uma forma de meios sintéticos altamente realistas que podem fazer-se passar por indivíduos com uma precisão surpreendente, representando riscos significativos para os sistemas de verificação e autenticação de identidades.

O nosso inquérito revelou que 47% das organizações já se depararam com um ataque de deepfake - um número que deverá aumentar à medida que as ferramentas crescem em sofisticação e acessibilidade. Este aumento pode ser impulsionado por melhores tecnologias de deteção que descobrem ataques anteriormente despercebidos ou por técnicas adversárias que avançam rapidamente, tornando as falsificações profundas mais difundidas. As organizações podem nem sequer ter percebido que tinham um problema de falsificação profunda até agora.

O potencial impacto dos deepfakes nas organizações é substancial:

- 70% acreditam que os ataques de deepfake terão um impacto elevado na sua organização

- 64% preocupam-se com a perda de dados sensíveis

- 61% estão preocupados com os danos à reputação

- 60% receiam sanções ou perdas financeiras

Apesar do perigo claro e presente, 62% dos líderes de cibersegurança receiam que a sua organização não esteja a levar as ameaças deepfake suficientemente a sério. Este desfasamento entre a realidade e a preparação organizacional é uma preocupação significativa.

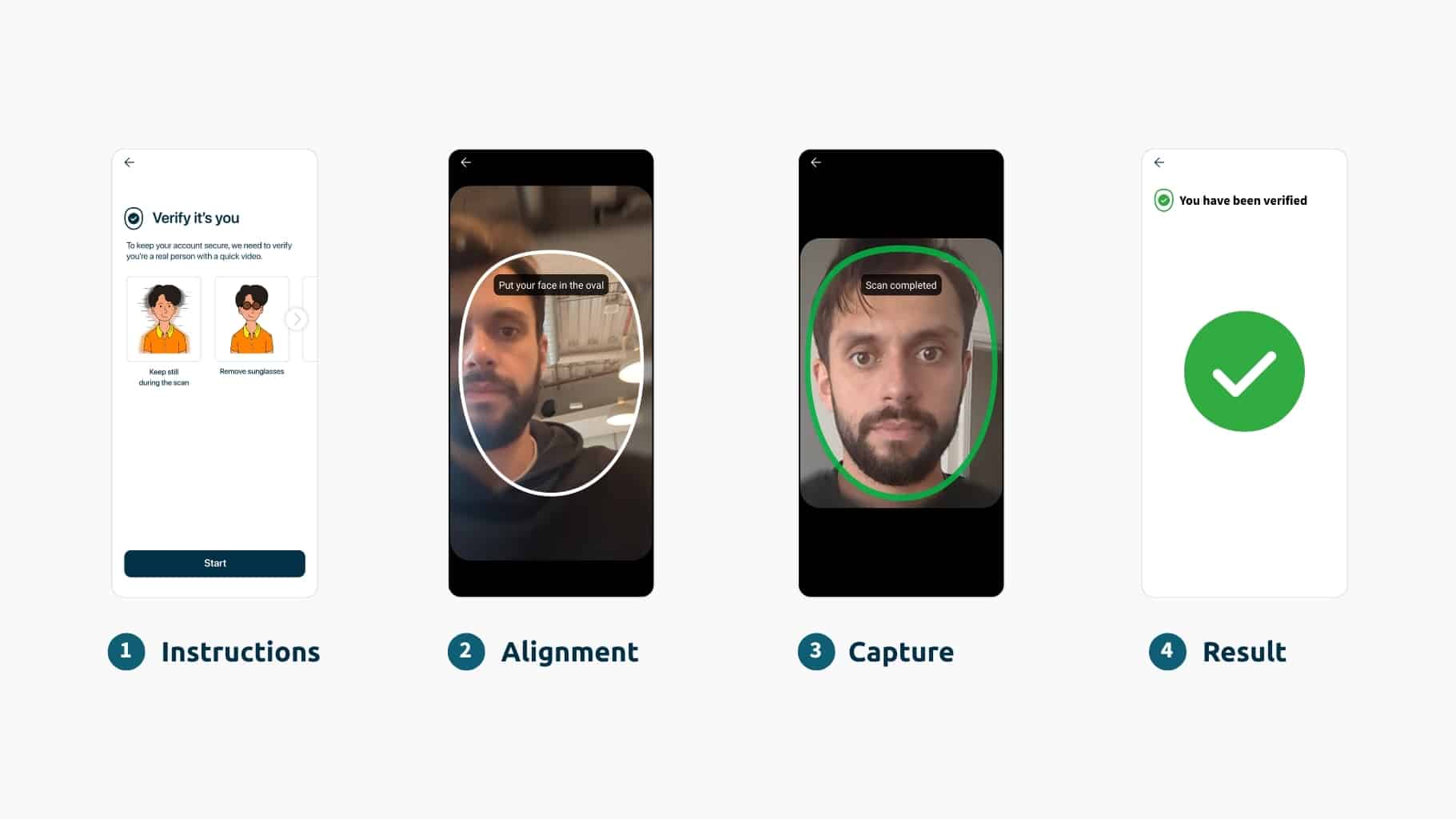

Soluções biométricas faciais: A linha da frente da defesa

Em resposta, as organizações estão a recorrer a medidas de segurança avançadas. Uns retumbantes 75% dos líderes tecnológicos inquiridos indicaram que estão a recorrer a soluções biométricas faciais como a sua principal defesa contra as falsificações profundas.

A preferência pela biometria facial não é apenas uma tendência - é o reconhecimento de que as medidas de segurança tradicionais já não são suficientes para impedir ataques sofisticados com recurso à IA, uma vez que não são indicadores verificáveis ou fiáveis de identidade. Os maus actores podem facilmente roubar uma palavra-passe ou intercetar uma OTPaté mesmo a sua voz é agora suscetível de ser falsificada e a variações ao longo do tempo (além disso, é difícil obter uma "fonte" autêntica para comparar com uma voz).

A biometria facial associa o rosto de um indivíduo a uma identificação de confiança do governo, proporcionando um elevado nível de garantia de que o utilizador é a pessoa certa, em tempo real. A biometria facial é considerada o tipo mais eficaz de solução biométrica devido à sua facilidade de utilização, segurança e inclusão.

O nosso inquérito revela que as organizações estão a implementar várias soluções para lidar com a ameaça das deepfakes:

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 6 Ferramentas de soluções estatísticas utilizadas para combater a ameaça das falsificações profundas (deepfakes)](https://www.iproov.com/wp-content/uploads/2024/11/Statistics-solutions-tools-used-to-address-threat-of-deepfakes.png)

Estas estatísticas demonstram que as organizações estão a adotar uma abordagem recomendada de segurança em várias camadas, com a biometria a desempenhar um papel central. Em geral, as soluções biométricas faciais com vivacidade oferecem um nível de segurança que é difícil de minar, tornando-as numa ferramenta crucial na luta contra os deepfakes e outras ameaças geradas por IA.

O cenário em evolução da cibersegurança

As organizações estão a adaptar as suas estratégias para responder a estes novos desafios:

- 68% reviram os seus programas de cibersegurança para incluir considerações de risco introduzidas pela IA generativa

- 88% implementaram políticas sobre a utilização de novas ferramentas de IA

- 83% aumentaram o seu investimento ou orçamento para programas de cibersegurança

Estas mudanças reflectem uma consciência crescente da necessidade de medidas de segurança adaptáveis e evolutivas face às ameaças impulsionadas pela IA.

Na verdade, pode ser difícil acompanhar todos os desenvolvimentos mais recentes no mundo das ameaças baseadas em IA. É por isso que é importante escolher uma solução de verificação de identidade que possa monitorizar e lidar com essas ameaças para a sua organização em tempo real.

O iProov utiliza a IA para o bem: os modelos de aprendizagem profunda, incluindo as Redes Neuronais Convolucionais (CNN), podem ajudar a detetar e fazer corresponder imagens. Ao mesmo tempo, a visão computacional garante que as imagens pertencem a uma pessoa real e não a um deepfake, máscara ou outro meio sintético.

De forma crítica, quase todos os inquiridos (94%) concordam que um parceiro de segurança biométrica deve ser mais do que um simples produto de software; deve fornecer um serviço em constante evolução.

Assista a este vídeo para saber mais sobre como o iProov oferece segurança biométrica como um serviço evolutivo e adaptável, em oposição a uma solução estática que é incapaz de responder a vulnerabilidades de dia zero e ficar um passo à frente dos ataques de IA de género:

Principais conclusões

- A IA apresenta tanto ameaças significativas como defesas poderosas na cibersegurança

- Os deepfakes são agora uma das principais preocupações das organizações

- As soluções biométricas, em particular a biometria facial com vivacidade, são a defesa preferida contra os ataques alimentados por IA

- As organizações devem e estão a adaptar ativamente as suas estratégias para enfrentar os riscos relacionados com a IA

Olhando para o futuro

À medida que avançamos, as organizações devem manter-se informadas sobre os mais recentes desenvolvimentos em IA e cibersegurança. O panorama está a evoluir rapidamente, com novas ameaças e defesas a surgirem constantemente.

No entanto, nem todas as soluções biométricas são criadas da mesma forma. O iProov é o único fornecedor de verificação biométrica facial que analisa a inteligência do mundo real das ameaças. Não ajudamos apenas as organizações a ajustar as suas defesas - nós somos a defesa, mantendo-nos ativamente um passo à frente das ameaças em evolução. Ao aproveitar a inteligência de ameaças em tempo real e o monitoramento proativo por meio do iSOC, garantimos que os sistemas biométricos sejam resilientes, adaptáveis e capazes de combater até mesmo os ataques mais sofisticados.

Na parte 2 desta série, vamos explorar a forma como as organizações podem aproveitar eficazmente a IA para o bem - para melhorar a segurança - com um enfoque alinhado com as recomendações prescritivas da Gartner para combater as ameaças deepfake, simplificando o processo de aquisição biométrica/liveness para si.

Leia a Parte 2: Como o iProov atende às recomendações de defesa contra deepfake da Gartner