26 novembre 2024

L'intelligence artificielle (IA) est à la fois notre plus grand allié et notre plus dangereux adversaire. Les enjeux n'ont jamais été aussi importants, car les organisations du monde entier sont aux prises avec des menaces induites par l'IA, telles que les "deepfakes" et les contenus créés par l'IA générative, tout en s'appuyant sur l'IA pour détecter et atténuer ces dangers potentiels.

Dans cette série en deux parties, nous démêlons ces sujets en examinant le paysage des menaces, en discutant de l'impact de l'IA à travers le prisme des décideurs technologiques et en examinant les recommandations de Gartner pour trouver les meilleures solutions et recommandations.

Les résultats de l'enquête montrent que l'IA est une "épée à double tranchant".

La dernière enquête mondiale d'iProov - The Good, The Bad, and The Ugly - a recueilli les opinions de 500 décideurs technologiques du Royaume-Uni, des États-Unis, du Brésil, de l'Australie, de la Nouvelle-Zélande et de Singapour sur la menace de l'IA générative et des "deepfakes".

Cette enquête a révélé un paradoxe frappant : alors que 68 % des personnes interrogées pensent que l'IA générative crée des menaces pour la cybersécurité, une proportion encore plus importante 84% estiment qu'elle a un impact sur la protection contre ces mêmes menaces.

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 4 Bon Mauvais Mauvais Extrait Impact de l'apprentissage automatique Gen AI](https://www.iproov.com/wp-content/uploads/2024/11/Good-Bad-Ugly-Extract-Impact-Of-Gen-AI-Machine-Learning.png)

D'une part, les technologies basées sur l'IA, telles que les "deepfakes", ont permis aux attaquants de disposer d'outils sophistiqués pour se faire passer pour des personnes et créer de fausses identités en ligne. d'usurper l'identité d'une personne et de créer de fausses identités convaincantes en ligne.

D'autre part, l'IA constitue une ligne de défense cruciale. En voici un exemple, la détection biométrique de la vivacité utilise des algorithmes d'IA pour identifier et contrecarrer les tentatives de tromperie numérique en détectant les images et les vidéos manipulées (avec une meilleure fiabilité que l'œil humain). meilleure fiabilité que l'œil humain).

L'arène des algorithmes : IA contre IA

Les attaques alimentées par l'IA deviennent de plus en plus sophistiquées, tout comme les défenses basées sur l'IA. Cette course à l'armement technologique est en train de remodeler la cybersécurité.

Les cybercriminels s'appuient sur l'IA pour créer des courriels d'hameçonnage plus convaincants, développer des logiciels malveillants complexes et orchestrer des attaques à grande échelle. Simultanément, les équipes de cybersécurité exploitent la puissance de l'IA pour détecter les anomalies, prédire les menaces potentielles et répondre aux incidents avec une rapidité et une précision sans précédent.

Sans surprise, les "deepfakes" arrivent en troisième position des préoccupations les plus courantes des répondants à l'enquête, dans l'ordre suivant :

- Violation des mots de passe (64%)

- Ransomware (63%)

- Attaques par hameçonnage/ingénierie sociale (61%)

- Deepfakes (61%)

L'inclusion des "deepfakes" parmi ces trois principales préoccupations indique une prise de conscience croissante de cette menace émergente.

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 5 Statistiques Latam sur les opinions Deepfake](https://www.iproov.com/wp-content/uploads/2024/11/Latam-Deepfake-opinions-statistics.png)

Les organisations doivent adopter des techniques avancées qui s'adaptent à l'accélération rapide des cybermenaces, en utilisant l'IA pour le bien de la cybersécurité.

La crise Deepfake dans la sécurité des entreprises

Il n'est pas étonnant que l'essor des "deepfakes" soit devenu l'un des développements les plus alarmants de l'IA.

Les "deepfakes" sont des médias synthétiques très réalistes qui peuvent usurper l'identité d'une personne avec une précision surprenante, ce qui présente des risques importants pour les systèmes de vérification et d'authentification de l'identité.

Notre enquête a révélé que 47 % des organisations ont déjà été confrontées à une attaque de type "deepfake" - un chiffre appelé à augmenter à mesure que les outils deviennent plus sophistiqués et plus accessibles. Cette augmentation peut être due à l'amélioration des technologies de détection, qui permettent de découvrir des attaques jusque-là passées inaperçues, ou à l'évolution rapide des techniques adverses, qui rendent les deepfakes plus répandus.

L'impact potentiel des deepfakes sur les organisations est considérable :

- 70% pensent que les attaques de type "deepfake" auront un impact important sur leur organisation

- 64% s'inquiètent de la perte de données sensibles

- 61% s'inquiètent de l'atteinte à la réputation

- 60% craignent des pénalités ou des pertes financières

Malgré le danger clair et présent, 62 % des responsables de la cybersécurité craignent que leur organisation ne prenne pas suffisamment au sérieux les menaces liées aux "deepfakes".. Ce décalage entre la réalité et l'état de préparation de l'organisation est très préoccupant.

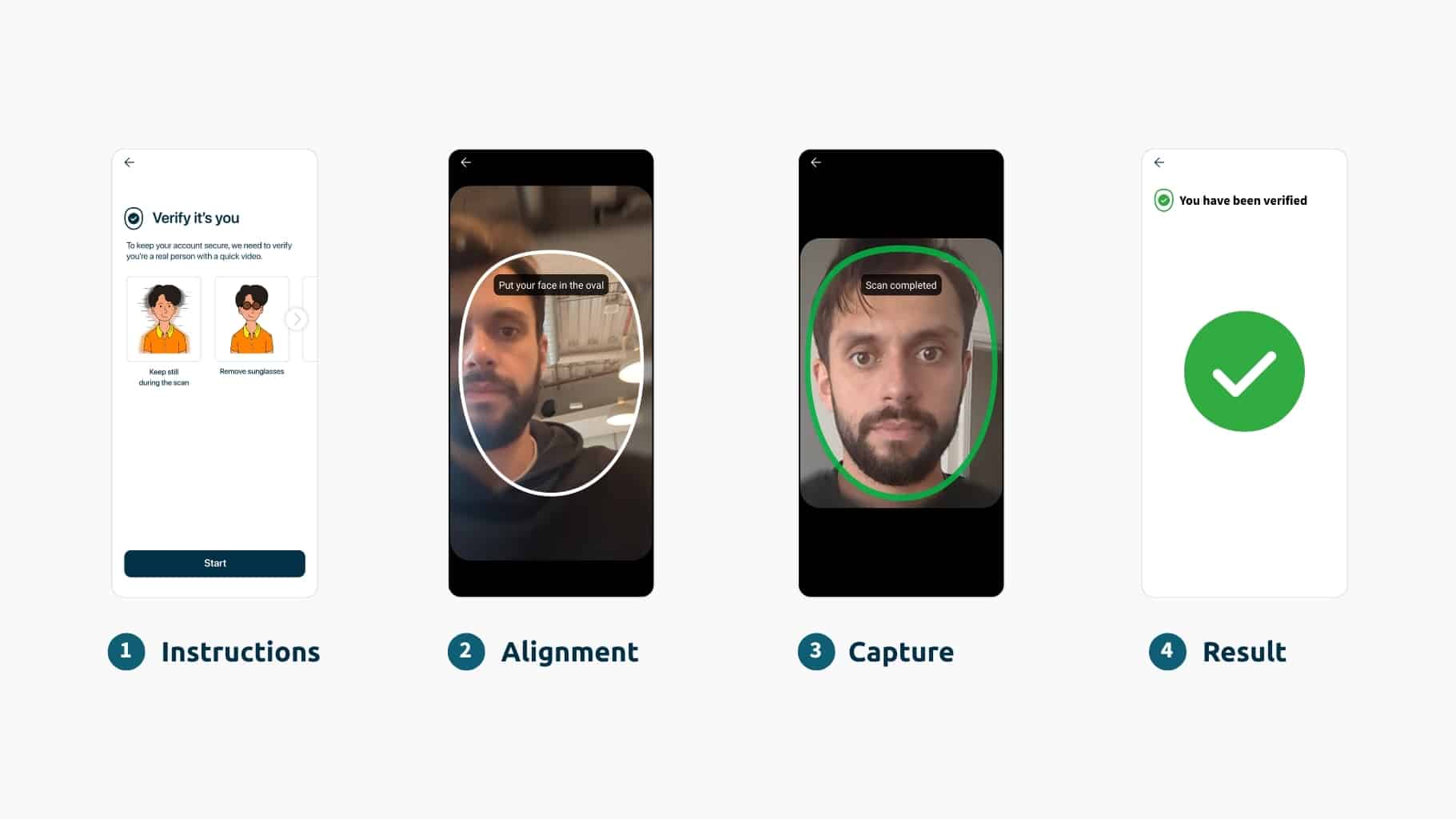

Solutions biométriques faciales : La défense en première ligne

En réponse, les organisations se tournent vers des mesures de sécurité avancées. Un nombre impressionnant de leaders technologiques (75 %) ont indiqué qu'ils se tournaient vers des solutions biométriques faciales comme principale défense contre les "deepfakes".

La préférence pour la biométrie faciale n'est pas seulement une tendance - c'est la reconnaissance du fait que les mesures de sécurité traditionnelles ne sont plus suffisantes pour contrecarrer les attaques sophistiquées alimentées par l'IA, car elles ne sont pas des indicateurs vérifiables ou fiables de l'identité. De mauvais acteurs peuvent facilement voler un mot de passe ou intercepter un OTP; même votre voix est désormais sujette à l'usurpation et à la variance dans le temps (de plus, il est difficile d'obtenir une "source" authentique). d'obtenir une "source" authentique pour comparer une voix).

La biométrie faciale associe le visage d'un individu à une pièce d'identité approuvée par le gouvernement, ce qui permet de s'assurer que l'utilisateur est bien la bonne personne, en temps réel. La biométrie faciale est considérée comme le type de solution biométrique le plus efficace en raison de sa facilité d'utilisation, de sa sécurité et de son caractère inclusif.

Notre enquête révèle que les organisations mettent en œuvre diverses solutions pour faire face à la menace des "deepfakes" :

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 6 Les outils de solutions statistiques utilisés pour répondre à la menace des deepfakes](https://www.iproov.com/wp-content/uploads/2024/11/Statistics-solutions-tools-used-to-address-threat-of-deepfakes.png)

Ces statistiques démontrent que les organisations adoptent une approche multicouche recommandée en matière de sécurité, la biométrie jouant un rôle central. Dans l'ensemble, les solutions de biométrie faciale avec liveness offrent un niveau de sécurité difficile à ébranler, ce qui en fait un outil crucial dans la lutte contre les deepfakes et autres menaces générées par l'IA.

L'évolution du paysage de la cybersécurité

Les organisations adaptent leurs stratégies pour relever ces nouveaux défis :

- 68% ont révisé leurs programmes de cybersécurité pour inclure les considérations de risque introduites par l'IA générative.

- 88% ont mis en place des politiques sur l'utilisation des nouveaux outils d'IA

- 83% ont augmenté leur investissement ou leur budget pour les programmes de cybersécurité

Ces changements reflètent une prise de conscience croissante de la nécessité de mesures de sécurité adaptatives et évolutives face aux menaces induites par l'IA.

En réalité, il peut être difficile de suivre tous les derniers développements dans le monde des menaces basées sur l'IA. C'est pourquoi il est important de choisir une solution de vérification d'identité capable de surveiller et de gérer ces menaces pour votre organisation en temps réel.

iProov utilise l'IA à bon escient : les modèles d'apprentissage profond, y compris les réseaux neuronaux convolutifs (CNN), peuvent aider à détecter et à faire correspondre les images. En même temps, la vision par ordinateur garantit que l'image appartient à une personne réelle et non à un deepfake, à un masque ou à un autre média synthétique.

Un point essentiel, la quasi-totalité des personnes interrogées (94 %) reconnaissent qu'un partenaire de sécurité biométrique doit être plus qu'un simple produit logiciel ; il doit fournir un service évolutif.

Regardez cette vidéo pour en savoir plus sur la façon dont iProov fournit la sécurité biométrique comme un service évolutif et adaptatif par opposition à une solution statique qui est incapable de répondre aux vulnérabilités du jour zéro et de garder une longueur d'avance sur les attaques génétiques de l'IA:

Principaux enseignements

- L'IA présente à la fois des menaces importantes et des défenses puissantes en matière de cybersécurité

- Les "deepfakes" sont désormais une préoccupation majeure pour les organisations

- Les solutions biométriques, en particulier la biométrie faciale avec liveness, constituent la défense privilégiée contre les attaques alimentées par l'IA.

- Les organisations doivent adapter leurs stratégies pour faire face aux risques liés à l'IA, et elles le font activement.

Perspectives d'avenir

À mesure que nous avançons, les organisations doivent rester informées des derniers développements en matière d'IA et de cybersécurité. Le paysage évolue rapidement et de nouvelles menaces et défenses apparaissent constamment.

iProov est le seul fournisseur de solutions biométriques de vérification du visage à analyser les renseignements sur les menaces dans le monde réel. Nous ne nous contentons pas d'aider les organisations à affiner leurs défenses - nous sommes la défense, en gardant activement une longueur d'avance sur l'évolution des menaces. En tirant parti de la veille sur les menaces en temps réel et de la surveillance proactive par le biais de l'iSOC, nous veillons à ce que les systèmes biométriques soient résilients, adaptables et capables de contrer les attaques les plus sophistiquées.

Dans la deuxième partie de cette série, nous examinerons comment les organisations peuvent efficacement tirer parti de l'IA pour améliorer la sécurité, en mettant l'accent sur les recommandations normatives de Gartner pour lutter contre les menaces de type deepfake, en simplifiant le processus d'approvisionnement biométrique/physique pour vous.