26 พฤศจิกายน 2567

ปัญญาประดิษฐ์ (AI) เป็นทั้งพันธมิตรที่ยิ่งใหญ่ที่สุดและศัตรูที่อันตรายที่สุดของเรา ความเสี่ยงไม่เคยสูงเท่านี้มาก่อน เนื่องจากองค์กรต่างๆ ทั่วโลกต้องต่อสู้กับภัยคุกคามที่เกิดจาก AI เช่น ดีปเฟก และ เนื้อหาที่สร้างขึ้นโดย AI ขณะเดียวกันก็ต้องพึ่งพา AI เพื่อตรวจจับและลดอันตรายที่อาจเกิดขึ้นเหล่านี้

ในซีรีส์ 2 ภาคนี้ เราจะคลี่คลายหัวข้อเหล่านี้โดยการตรวจสอบภูมิทัศน์ของภัยคุกคาม พูดคุยถึงผลกระทบของ AI ผ่านเลนส์ของผู้ตัดสินใจด้านเทคโนโลยี และพิจารณาคำแนะนำของ Gartner เพื่อค้นหาวิธีแก้ปัญหาและคำแนะนำที่ดีที่สุด

ผลสำรวจชี้ AI เป็น “ดาบสองคม”

การสำรวจระดับโลกครั้งล่าสุดของ iProov – ดี ไม่ดี และน่าเกลียด – รวบรวมความคิดเห็นของผู้มีอำนาจตัดสินใจด้านเทคโนโลยี 500 รายจากสหราชอาณาจักร สหรัฐอเมริกา บราซิล ออสเตรเลีย นิวซีแลนด์ และสิงคโปร์ เกี่ยวกับภัยคุกคามของ AI เชิงสร้างสรรค์และดีปเฟก

การสำรวจนี้เผยให้เห็นถึงความขัดแย้งที่น่าทึ่ง: ในขณะที่ ผู้ตอบแบบสอบถาม 68% เชื่อว่า AI เชิงสร้างสรรค์สร้างภัยคุกคามต่อความปลอดภัยทางไซเบอร์ มีผู้ตอบแบบสอบถามมากกว่าถึง 84% ที่พบว่า AI เชิงสร้างสรรค์สามารถปกป้องคุณจากภัยคุกคามเหล่านี้ได้

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 4 ดี ไม่ดี น่าเกลียด สกัดผลกระทบของการเรียนรู้ของเครื่อง Gen AI](https://www.iproov.com/wp-content/uploads/2024/11/Good-Bad-Ugly-Extract-Impact-Of-Gen-AI-Machine-Learning.png)

ในขณะเดียวกัน เทคโนโลยีที่ขับเคลื่อนด้วย AI เช่น Deepfake ได้เพิ่มขีดความสามารถให้กับผู้โจมตีด้วยเครื่องมืออันซับซ้อนเพื่อ ปลอมตัวเป็นบุคคลและสร้างตัวตนปลอมที่น่าเชื่อถือทางออนไลน์

ในทางกลับกัน AI ทำหน้าที่เป็นแนวป้องกันที่สำคัญ ตัวอย่างเช่น การตรวจจับความมีชีวิตของข้อมูลชีวภาพ ใช้ขั้นตอนวิธีของ AI เพื่อระบุและขัดขวางความพยายามในการหลอกลวงทางดิจิทัลโดยการตรวจจับภาพและวิดีโอที่ถูกดัดแปลง (ซึ่งมี ความน่าเชื่อถือมากกว่าสายตาของมนุษย์ )

เวทีอัลกอริธึม: AI vs. AI

ในขณะที่การโจมตีด้วย AI มีความซับซ้อนมากขึ้น การป้องกันที่ขับเคลื่อนด้วย AI ก็เพิ่มขึ้นเช่นกัน การแข่งขันทางเทคโนโลยีนี้กำลังเปลี่ยนโฉมหน้าของความมั่นคงปลอดภัยทางไซเบอร์

อาชญากรไซเบอร์ใช้ประโยชน์จาก AI เพื่อสร้างอีเมลฟิชชิ่งที่มีความน่าเชื่อถือมากขึ้น พัฒนาซอฟต์แวร์ที่เป็นอันตรายที่ซับซ้อน และวางแผนการโจมตีขนาดใหญ่ ในเวลาเดียวกัน ทีมงานด้านความปลอดภัยทางไซเบอร์ใช้ประโยชน์จากพลังของ AI เพื่อตรวจจับความผิดปกติ คาดการณ์ภัยคุกคามที่อาจเกิดขึ้น และตอบสนองต่อเหตุการณ์ต่างๆ ด้วยความเร็วและความแม่นยำที่ไม่เคยมีมาก่อน

ไม่น่าแปลกใจที่ตอนนี้ Deepfakes อยู่ในอันดับที่สามร่วมกันในกลุ่มข้อกังวลที่พบบ่อยที่สุดในการสำรวจ โดยเรียงตามลำดับดังต่อไปนี้:

- การละเมิดรหัสผ่าน (64%)

- แรนซัมแวร์ (63%)

- การโจมตีแบบฟิชชิ่ง/วิศวกรรมสังคม (61%)

- ดีพเฟก (61%)

การรวม Deepfakes ไว้ในข้อกังวลสามอันดับแรกนี้ แสดงถึงการตระหนักรู้ที่เพิ่มขึ้นเกี่ยวกับภัยคุกคามที่เพิ่งเกิดขึ้นนี้

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 5 สถิติความคิดเห็นเกี่ยวกับ Deepfake ของละตินอเมริกา](https://www.iproov.com/wp-content/uploads/2024/11/Latam-Deepfake-opinions-statistics.png)

องค์กรต่างๆ ต้องใช้เทคนิคขั้นสูงที่ปรับตัวให้เข้ากับภัยคุกคามทางไซเบอร์ที่เพิ่มมากขึ้นอย่างรวดเร็ว โดยใช้ AI เพื่อประโยชน์ด้านความปลอดภัยทางไซเบอร์

วิกฤต Deepfake ในระบบรักษาความปลอดภัยขององค์กร

ไม่น่าแปลกใจเลยที่ การเพิ่มขึ้นของ Deepfake กลายมาเป็นหนึ่งในพัฒนาการที่น่าตกใจที่สุดที่เกิดจาก AI

Deepfakes เป็นสื่อสังเคราะห์ที่มีความสมจริงอย่างมากซึ่งสามารถปลอมตัวเป็นบุคคลได้ด้วยความแม่นยำที่น่าตกใจ ซึ่งก่อให้เกิดความเสี่ยงอย่างมากต่อระบบการยืนยันตัวตนและการตรวจสอบความถูกต้อง

ผลการสำรวจของเราพบว่าองค์กร 47% เคยเผชิญกับการโจมตีแบบ Deepfake มาแล้ว โดยตัวเลขดังกล่าวมีแนวโน้มว่าจะเพิ่มขึ้นเรื่อยๆ เนื่องจากเครื่องมือต่างๆ มีความซับซ้อนและเข้าถึงได้มากขึ้น การเพิ่มขึ้นนี้อาจเกิดจากเทคโนโลยีการตรวจจับที่ดีขึ้นซึ่งช่วยเปิดเผยการโจมตีที่ไม่เคยถูกสังเกตมาก่อน หรือเทคนิคการโจมตีที่พัฒนาอย่างรวดเร็ว ทำให้ Deepfake แพร่หลายมากขึ้น องค์กรต่างๆ อาจไม่รู้ด้วยซ้ำว่าตนเองมีปัญหากับ Deepfake จนกระทั่งบัดนี้

ผลกระทบที่อาจเกิดขึ้นจาก Deepfakes ต่อองค์กรนั้นมีมากมาย:

- 70% เชื่อว่าการโจมตีแบบ Deepfake จะส่งผลกระทบอย่างมากต่อองค์กรของพวกเขา

- 64% กังวลเกี่ยวกับการสูญเสียข้อมูลที่ละเอียดอ่อน

- 61% กังวลเกี่ยวกับความเสียหายต่อชื่อเสียง

- 60% กลัวค่าปรับหรือการสูญเสียทางการเงิน

แม้ว่าจะมีอันตรายที่ชัดเจนและเกิดขึ้นจริง แต่ ผู้นำด้านความปลอดภัยทางไซเบอร์ 62% กังวลว่าองค์กรของตนไม่ได้ให้ความสำคัญกับภัยคุกคามจาก Deepfake มากพอ ความ ไม่สอดคล้องระหว่างความเป็นจริงและความพร้อมขององค์กรถือเป็นปัญหาสำคัญ

โซลูชันไบโอเมตริกซ์ใบหน้า: การป้องกันแนวหน้า

องค์กรต่าง ๆ หันมาใช้มาตรการรักษาความปลอดภัยขั้นสูงเพื่อรับมือกับเหตุการณ์ดังกล่าว โดยผู้นำด้านเทคโนโลยีที่เข้าร่วมการสำรวจร้อยละ 75 ระบุว่าตนหันมาใช้ โซลูชันไบโอเมตริกซ์ใบหน้า เป็นแนวทางป้องกันหลักในการป้องกันการปลอมแปลงข้อมูล

การให้ความสำคัญกับข้อมูลชีวมาตรของใบหน้าไม่ได้เป็นเพียงกระแสเท่านั้น แต่ยังเป็นการตระหนักดีว่ามาตรการรักษาความปลอดภัยแบบเดิมไม่เพียงพออีกต่อไปที่จะขัดขวางการโจมตีที่ขับเคลื่อนด้วย AI ที่ซับซ้อน เนื่องจากมาตรการเหล่านี้ไม่สามารถตรวจสอบหรือบ่งชี้ตัวตนได้อย่างน่าเชื่อถือ ผู้กระทำความผิดสามารถ ขโมยรหัสผ่าน หรือ ดักฟังรหัส OTP ได้อย่างง่ายดาย แม้แต่ เสียงของคุณก็มีแนวโน้มที่จะปลอมแปลง และเปลี่ยนแปลงไปตามเวลา (นอกจากนี้ ยังยากที่จะ หา "แหล่งที่มา" ที่แท้จริง เพื่อจับคู่เสียงกับข้อมูลนั้น)

ไบโอเมตริกซ์ใบหน้าจะเชื่อมโยงใบหน้าของบุคคลเข้ากับบัตรประจำตัวที่รัฐบาลเชื่อถือ ทำให้มั่นใจได้ในระดับสูงว่าผู้ใช้คือบุคคลที่ถูกต้องแบบเรียลไทม์ ไบโอเมตริกซ์ใบหน้าถือเป็นโซลูชันไบโอเมตริกซ์ที่มีประสิทธิภาพสูงสุดเนื่องจากใช้งานง่าย ปลอดภัย และครอบคลุม

การสำรวจของเราเผยให้เห็นว่าองค์กรต่างๆ กำลังนำโซลูชันต่างๆ มาใช้เพื่อรับมือกับภัยคุกคามจาก Deepfakes:

![The Artificial Intelligence Paradox in Cybersecurity [Part 1] 6 เครื่องมือโซลูชันสถิติที่ใช้ในการจัดการกับภัยคุกคามจาก Deepfakes](https://www.iproov.com/wp-content/uploads/2024/11/Statistics-solutions-tools-used-to-address-threat-of-deepfakes.png)

สถิติเหล่านี้แสดงให้เห็นว่าองค์กรต่างๆ กำลังนำแนวทางหลายชั้นที่แนะนำมาใช้กับความปลอดภัย โดยข้อมูลไบโอเมตริกส์มีบทบาทสำคัญ โดยรวมแล้ว โซลูชันข้อมูลไบโอเมตริกส์ใบหน้าพร้อมการแสดงตัวตนนั้นให้ระดับความปลอดภัยที่ยากจะทำลายได้ ทำให้โซลูชันเหล่านี้เป็นเครื่องมือสำคัญในการต่อสู้กับดีปเฟกและภัยคุกคามอื่นๆ ที่เกิดจาก AI

ภูมิทัศน์ที่เปลี่ยนแปลงไปของความปลอดภัยทางไซเบอร์

องค์กรต่างๆ กำลังปรับกลยุทธ์เพื่อรับมือกับความท้าทายใหม่ๆ เหล่านี้:

- 68% ได้ปรับปรุงโปรแกรมความปลอดภัยทางไซเบอร์เพื่อรวมการพิจารณาความเสี่ยงที่เกิดจาก AI เชิงสร้างสรรค์

- 88% ได้นำนโยบายเกี่ยวกับการใช้เครื่องมือ AI ใหม่ ๆ มาใช้

- 83% เพิ่มการลงทุนหรือจัดงบประมาณสำหรับโปรแกรมความปลอดภัยทางไซเบอร์

การเปลี่ยนแปลงเหล่านี้สะท้อนให้เห็นถึงการตระหนักรู้ที่เพิ่มขึ้นถึงความจำเป็นในการใช้ มาตรการรักษาความปลอดภัยที่ปรับเปลี่ยนได้และพัฒนาขึ้น เพื่อรับมือกับภัยคุกคามที่ขับเคลื่อนโดย AI

ในความเป็นจริง การจะตามทันการพัฒนาล่าสุดในโลกของภัยคุกคามจาก AI อาจเป็นเรื่องยาก ดังนั้น การเลือกโซลูชันการตรวจสอบตัวตนที่สามารถตรวจสอบและจัดการภัยคุกคามเหล่านั้นสำหรับองค์กรของคุณแบบเรียลไทม์จึงมีความสำคัญ

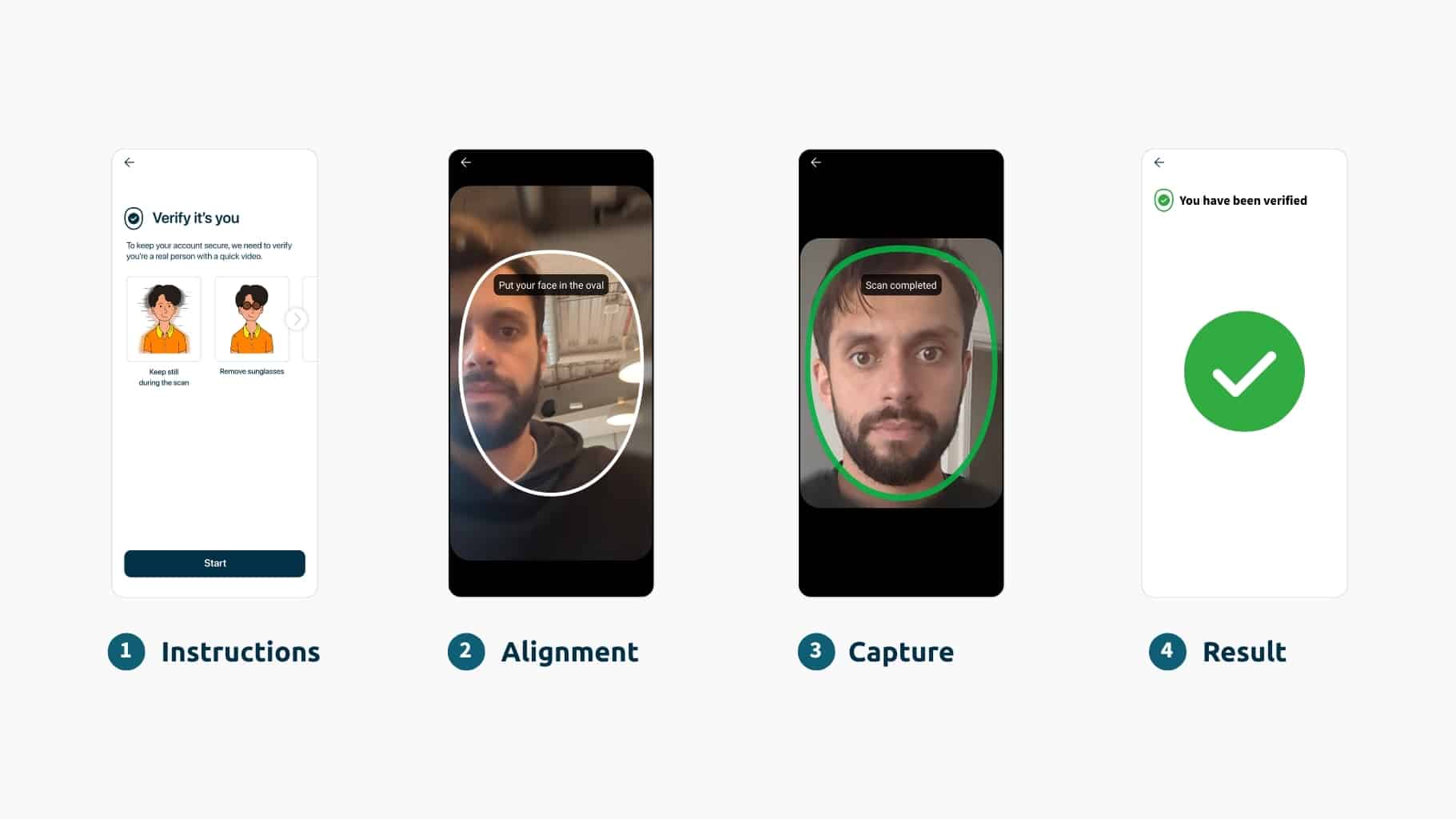

iProov ใช้ AI เพื่อประโยชน์: โมเดลการเรียนรู้เชิงลึก รวมถึง Convolutional Neural Networks (CNNs) สามารถช่วยตรวจจับและจับคู่ภาพได้ ในขณะเดียวกัน วิสัยทัศน์คอมพิวเตอร์จะรับรองว่าภาพนั้นเป็นของบุคคลจริง ไม่ใช่ภาพปลอม หน้ากาก หรือสื่อสังเคราะห์อื่นๆ

สิ่งสำคัญคือ ผู้ตอบแบบสอบถามเกือบทั้งหมด (94%) เห็นด้วยว่าพันธมิตรด้านความปลอดภัยแบบไบโอเมตริกซ์ควรเป็นมากกว่าผลิตภัณฑ์ซอฟต์แวร์ แต่ จะต้อง มอบบริการที่พัฒนาอย่างต่อ เนื่อง

ชมวิดีโอนี้เพื่อเรียนรู้เพิ่มเติมเกี่ยวกับวิธีที่ iProov นำเสนอความปลอดภัยทางชีวมาตรในฐานะบริการที่พัฒนาและปรับเปลี่ยนได้ ซึ่งตรงข้ามกับโซลูชันคงที่ที่ไม่สามารถตอบสนองต่อช่องโหว่แบบ zero-day และอยู่เหนือ การโจมตี AI ทั่วไป ได้หนึ่งก้าว :

สิ่งสำคัญที่ต้องจดจำ

- AI นำเสนอทั้งภัยคุกคามที่สำคัญและการป้องกันอันทรงพลังในด้านความปลอดภัยทางไซเบอร์

- Deepfakes กลายเป็นข้อกังวลอันดับต้นๆ ขององค์กรต่างๆ ในปัจจุบัน

- โซลูชันไบโอเมตริกซ์ โดยเฉพาะไบโอเมตริกซ์ใบหน้าพร้อมข้อมูลชีวิต ถือเป็นแนวป้องกันที่ต้องการใช้ต่อต้านการโจมตีที่ขับเคลื่อนด้วย AI

- องค์กรต่างๆ ต้องและกำลังปรับกลยุทธ์ของตนอย่างจริงจังเพื่อจัดการกับความเสี่ยงที่เกี่ยวข้องกับ AI

มองไปข้างหน้า

เมื่อเราเดินหน้าต่อไป องค์กรต่างๆ จะต้องคอยติดตามข้อมูลเกี่ยวกับพัฒนาการล่าสุดในด้าน AI และความปลอดภัยทางไซเบอร์ สภาพแวดล้อมกำลังเปลี่ยนแปลงอย่างรวดเร็ว โดยมีภัยคุกคามและการป้องกันใหม่ๆ เกิดขึ้นอย่างต่อเนื่อง

อย่างไรก็ตาม โซลูชันไบโอเมตริกซ์ทั้งหมดไม่ได้ถูกสร้างขึ้นมาเท่าเทียมกัน iProov เป็นผู้ให้บริการการตรวจสอบใบหน้าด้วยไบโอเมตริกซ์รายเดียวที่วิเคราะห์ข้อมูลภัยคุกคามในโลกแห่งความเป็นจริง เราไม่ได้แค่ช่วยให้องค์กรปรับแต่งการป้องกันเท่านั้น แต่เรายังเป็นฝ่ายป้องกันที่คอยก้าวล้ำหน้าภัยคุกคามที่เปลี่ยนแปลงอยู่เสมอ ด้วยการใช้ประโยชน์จาก ข้อมูลภัยคุกคามแบบเรียลไทม์ และ การตรวจสอบเชิงรุกผ่าน iSOC เราจึงมั่นใจได้ว่าระบบไบโอเมตริกซ์มีความยืดหยุ่น ปรับตัวได้ และสามารถรับมือกับการโจมตีที่ซับซ้อนที่สุดได้

ในส่วนที่ 2 ของซีรีส์นี้ เราจะสำรวจว่าองค์กรต่างๆ สามารถใช้ประโยชน์จาก AI ได้อย่างมีประสิทธิภาพเพื่อเสริมสร้างความปลอดภัยได้อย่างไร โดยมุ่งเน้นไปที่คำแนะนำเชิงปฏิบัติของ Gartner สำหรับการต่อสู้กับภัยคุกคามจาก Deepfake ซึ่งจะช่วยลดความซับซ้อนของกระบวนการจัดซื้อข้อมูลไบโอเมตริก/ความมีชีวิตสำหรับคุณ

อ่านส่วนที่ 2: iProov ตอบสนองคำแนะนำด้านการป้องกัน Deepfake ของ Gartner ได้อย่างไร