9 de mayo de 2025

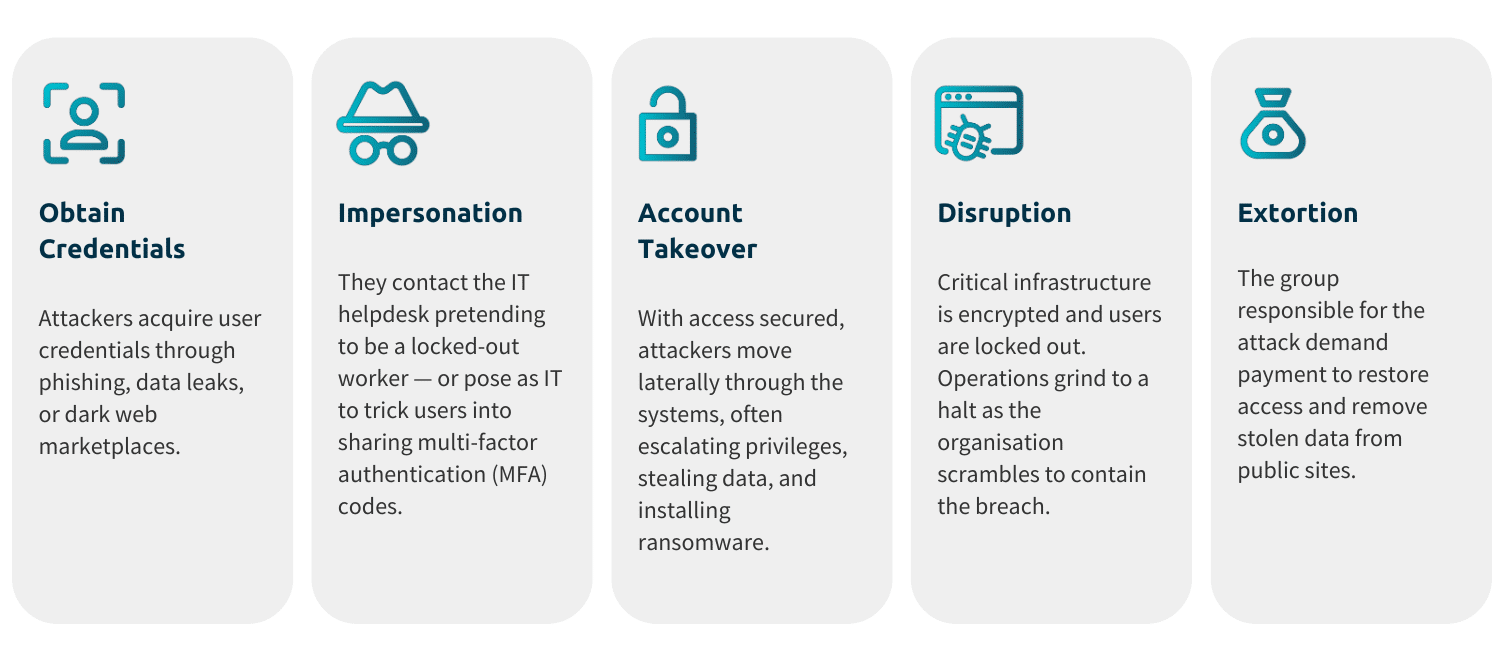

Los recientes ataques de ransomware a M&S, Co-op y Harrods revelan un patrón familiar: los atacantes ya no confían en piratear las redes de las empresas, sino que a menudo acceden a través del servicio de asistencia. Según Gartner, la recuperación de cuentas por olvido de contraseñas o pérdida de credenciales es la parte más arriesgada del ciclo de vida de la gestión de identidades. Al igual que la MGM Resorts en 2023que provocó pérdidas de 100 millones de dólares, estos incidentes muestran lo vulnerables que son los procesos de recuperación de cuentas a los ataques de ingeniería social.

Anatomía de un ataque de ingeniería social

Cómo la IA facilita los ataques de ingeniería social

La IA está convirtiendo la ciberdelincuencia en una operación a gran escala que requiere pocas habilidades: automatiza el phishing, desarrolla deepfakes y permite que el malware se adapte más rápido de lo que pueden responder las defensas. Estas tecnologías no solo reducen el esfuerzo requerido por los atacantes, sino que también aumentan significativamente su velocidad, precisión y alcance.

- Identificación de objetivos: Las herramientas basadas en IA raspan y analizan grandes volúmenes de datos públicos -desde perfiles de LinkedIn hasta bases de datos infectadas- para crear perfiles detallados de los objetivos. El procesamiento del lenguaje natural ayuda a identificar funciones, relaciones y patrones de comunicación para crear señuelos de phishing o intentos de suplantación de identidad muy creíbles.

- Relleno de credenciales: La IA acelera los intentos de inicio de sesión por fuerza bruta priorizando las contraseñas más reutilizadas y ajustando las estrategias en tiempo real. En 2024, Microsoft informó de 7.000 ataques a contraseñas por segundo. Las investigaciones han demostrado que la IA puede descifrar más del 50% de las contraseñas débiles en menos de un minuto.

- Suplantación de identidad: Se utilizan modelos de aprendizaje profundo para crear audio y vídeo deepfake realistas, imitando voces y movimientos faciales con gran precisión. Esto permite a los atacantes hacerse pasar por trabajadores de forma convincente en llamadas de asistencia en directo, reuniones de vídeo o incluso mensajes de voz.

- Ataques de fatiga del AMF: Las secuencias de comandos de IA gestionan los intentos repetidos de notificaciones push, programándolos para los momentos de distracción más probables (por ejemplo, las pausas para comer o el final del día). Algunos atacantes incluso combinan esto con falsificaciones de voz que se hacen pasar por soporte de TI, instando a los usuarios a aceptar la solicitud.

Estos métodos mejorados por la IA están demostrando su eficacia. En 2024, el 42% de las organizaciones informaron de ataques exitosos de phishing, vishing, deepfake u otros ataques de ingeniería social (Perspectivas mundiales de ciberseguridad 2025Foro Económico Mundial).

El problema central: los secretos compartidos siempre serán compartidos

A medida que la IA acelera las capacidades de los actores de amenazas, la autenticación organizativa sigue basándose en métodos débiles basados en el conocimiento y la posesión, contraseñas, códigos SMS y aplicaciones de autenticación. Estas credenciales compartibles se obtienen fácilmente de las víctimas y se comparten por teléfono.

El problema de fondo es confiar en lo que alguien sabe o diceen lugar de verificar quién es. La fuerza de trabajo ha cambiado más rápido que la mayoría de las arquitecturas de seguridad. El acceso remoto, el BYOD y los entornos cloud-first han dejado obsoleta la autenticación tradicional basada en el perímetro.

El Centro Nacional de Ciberseguridad del Reino Unido (NCSC) ha instado a las organizaciones a reevaluar la forma en que los servicios de asistencia informática autentican a los usuarios, sobre todo cuando manejan cuentas privilegiadas. Aunque los expertos en ciberseguridad abogan por más capas de seguridad para evitar futuros ataques, como palabras clave compartidas con el servicio de asistencia, si estas capas consisten en secretos compartibles, son vulnerables.

La biometría facial es resistente al phishing

La biometría facial con detección de vitalidad ofrece un cambio fundamental en la verificación y autenticación de la mano de obra.

- No es un secreto - tu cara no se puede compartir ni suplantar.

- Confirma la identidad - no sólo si conoces un código o puedes acceder a un dispositivo, sino quién eres.

- Verifica la presencia real - una capacidad crítica en el mundo remoto de hoy.

Incluso si un atacante convence a alguien para que se autentique, solo conseguirá un selfie. Una sólida detección de vitalidad basada en la nube garantiza que las imágenes y los vídeos -incluso las falsificaciones de alta calidad- no puedan utilizarse para eludir los flujos de trabajo de autenticación, y está en constante evolución para mitigar los nuevos ataques basados en IA.

La biometría facial es la única forma de conectar las actividades del usuario con el ser humano real. A medida que las organizaciones se esfuerzan por prescindir de contraseñas e implantar arquitecturas de confianza cero, esta es una capacidad crítica para reducir el riesgo y mantener la seguridad de la plantilla.

Asegure el proceso de recuperación de su cuenta

A medida que la IA acelera la escala y la sofisticación de la ingeniería social, la necesidad de una autenticación de alta garantía y resistente al phishing nunca ha sido tan clara. La biometría facial con detección de actividad ofrece una forma segura de verificar la identidad, no solo las credenciales, en el punto de mayor riesgo.

Si su organización está reevaluando cómo se verifica a los usuarios durante las llamadas de asistencia, especialmente en el caso de los accesos privilegiados, éste es el momento de actuar.

No deje que su servicio de asistencia se convierta en su eslabón más débil. Hable con nosotros hoy mismo sobre la implantación de una autenticación biométrica que resista ataques de ingeniería social, bombardeos de AMF y sofisticadas falsificaciones profundas.