9 maggio 2025

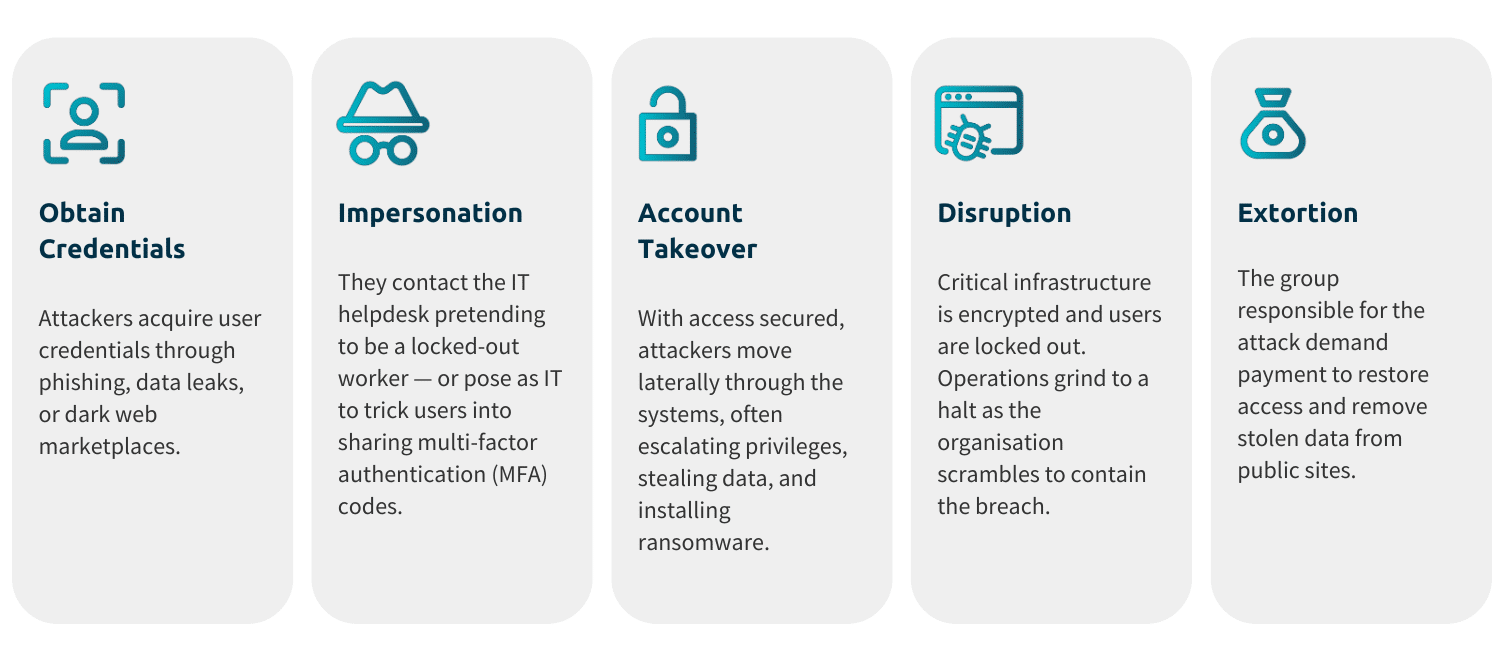

I recenti attacchi ransomware a M&S, Co-op e Harrods rivelano uno schema familiare: gli aggressori non si affidano più all'hacking delle reti aziendali, ma spesso si collegano all'helpdesk. Come identificato da Gartner, il recupero degli account a causa di password dimenticate o credenziali smarrite è la parte più rischiosa del ciclo di vita della gestione delle identità.. Proprio come la violazione di MGM Resorts nel 2023che ha portato a perdite per 100 milioni di dollari, questi incidenti dimostrano quanto i processi di recupero degli account siano vulnerabili agli attacchi di social engineering.

L'anatomia di un attacco di ingegneria sociale

Come l'intelligenza artificiale rende più facili gli attacchi di ingegneria sociale

L'intelligenza artificiale sta trasformando la criminalità informatica in un'operazione a bassa competenza e su larga scala, automatizzando il phishing, sviluppando deepfakes e consentendo alle minacce informatiche di adattarsi più rapidamente di quanto le difese possano rispondere. Queste tecnologie non solo riducono lo sforzo richiesto dagli aggressori, ma ne aumentano significativamente la velocità, la precisione e la portata.

- Identificazione dell'obiettivo: Gli strumenti basati sull'intelligenza artificiale scansionano e analizzano grandi volumi di dati pubblici, dai profili LinkedIn ai database violati, per costruire profili dettagliati degli obiettivi. L'elaborazione del linguaggio naturale aiuta a identificare i ruoli lavorativi, le relazioni e i modelli di comunicazione per creare esche di phishing o tentativi di impersonificazione altamente credibili.

- Imbottire di credenziali: L'intelligenza artificiale accelera i tentativi di accesso brute-force dando priorità alle password comunemente riutilizzate e adattando le strategie in tempo reale. Nel 2024, Microsoft ha riportato 7.000 attacchi di password al secondo. Le ricerche hanno dimostrato che l'intelligenza artificiale è in grado di decifrare oltre il 50% delle password deboli in meno di un minuto.

- Impersonificazione: I modelli di apprendimento profondo vengono utilizzati per creare audio e video deepfake realistici, imitando voci e movimenti facciali con elevata precisione. Ciò consente agli aggressori di impersonare in modo convincente i lavoratori durante le chiamate di assistenza dal vivo, le riunioni video o persino i messaggi vocali.

- Attacchi di stanchezza MFA: Gli script di intelligenza artificiale gestiscono ripetuti tentativi di notifica push, programmandoli in momenti di probabile distrazione (ad esempio, la pausa pranzo o la fine della giornata). Alcuni aggressori combinano questo approccio con dei deep fake vocali che si spacciano per assistenza IT e invitano gli utenti ad accettare la richiesta.

Questi metodi potenziati dall'intelligenza artificiale si stanno dimostrando efficaci. Nel 2024, il 42% delle organizzazioni ha segnalato il successo di attacchi di phishing, vishing, deepfake o altri attacchi di social engineering (Prospettive globali di cybersicurezza 2025World Economic Forum).

Il problema principale: i segreti condivisi saranno sempre condivisi

Mentre l'intelligenza artificiale accelera le capacità degli attori delle minacce, l'autenticazione organizzativa è ancora basata su metodi deboli basati sulla conoscenza e sul possesso, come le password, codici SMS e app di autenticazione. Queste credenziali condivisibili vengono facilmente estorte alle vittime e condivise al telefono.

Il problema principale è la fiducia di ciò che qualcuno sa o diceinvece di verificare chi sia chi sono. La forza lavoro è cambiata più velocemente della maggior parte delle architetture di sicurezza. Accesso remoto, BYOD e ambienti cloud-first hanno reso obsoleta l'autenticazione tradizionale basata sul perimetro.

Il National Cyber Security Centre (NCSC) del Regno Unito ha esortato le organizzazioni a rivalutare le modalità di autenticazione degli utenti da parte degli helpdesk IT, in particolare quando si gestiscono account privilegiati. Gli esperti di cybersicurezza sostengono la necessità di aumentare i livelli di sicurezza per prevenire attacchi futuri, come ad esempio parole in codice condivise con l'help desk, ma se questi livelli consistono in segreti condivisibili, sono vulnerabili.

La biometria facciale è resistente al phishing

La biometria facciale con rilevamento della vivacità offre un cambiamento fondamentale nella verifica e nell'autenticazione della forza lavoro.

- Non è un segreto - il tuo volto non può essere condiviso o trafugato.

- Conferma l'identità - non solo se si conosce un codice o si può accedere a un dispositivo, ma chi si è.

- Verifica la presenza reale - una capacità critica nell'attuale mondo remoto.

Anche se un aggressore convince qualcuno ad autenticarsi, otterrà solo un selfie. Il forte rilevamento della vivacità basato sul cloud garantisce che le immagini e i video, anche quelli falsi di alta qualità, non possano essere utilizzati per aggirare i flussi di lavoro di autenticazione ed è in continua evoluzione per mitigare i nuovi attacchi basati sull'intelligenza artificiale.

La biometria facciale è l'unico modo per collegare le attività degli utenti a un essere umano in carne e ossa. Mentre le organizzazioni si sforzano di diventare prive di password e di implementare architetture Zero Trust, questa è una capacità fondamentale per ridurre i rischi e mantenere la sicurezza della forza lavoro.

Processo di recupero dell'account sicuro

Poiché l'intelligenza artificiale accelera la portata e la sofisticazione dell'ingegneria sociale, la necessità di un'autenticazione ad alta garanzia e resistente al phishing non è mai stata così chiara. La biometria facciale con rilevamento della vivacità offre un modo sicuro per verificare l'identità, non solo le credenziali, nel punto di maggior rischio.

Se la vostra organizzazione sta rivalutando le modalità di verifica degli utenti durante le chiamate di assistenza, in particolare per gli accessi privilegiati, questo è il momento di agire.

Non lasciate che il vostro helpdesk diventi il vostro anello debole. Parlate con noi oggi stesso per implementare un'autenticazione biometrica che resista agli attacchi di social engineering, ai bombardamenti MFA e a sofisticati deepfake.