9 de maio de 2025

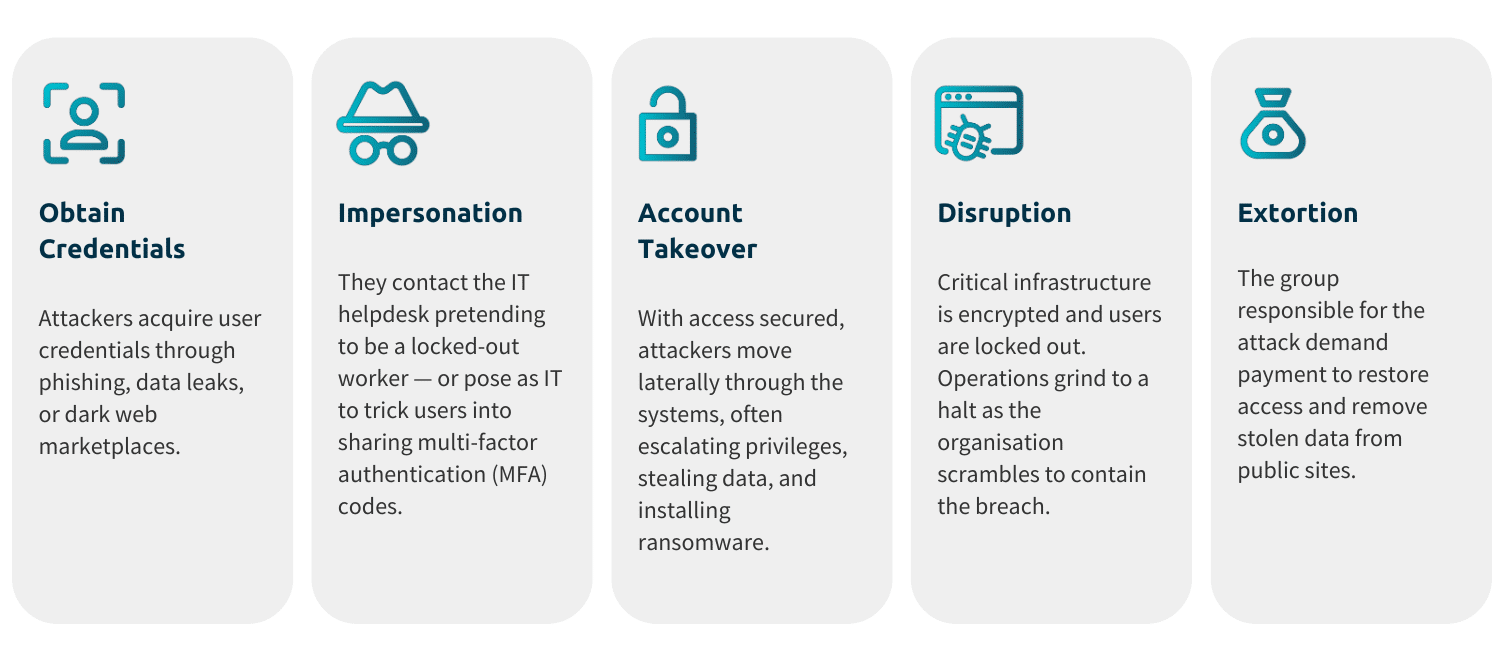

Os recentes ataques de ransomware contra a M&S, a Co-op e a Harrods revelam um padrão já conhecido: os invasores não dependem mais de invadir as redes das empresas — muitas vezes, eles acessam o sistema através do suporte técnico. Conforme identificado pela Gartner, a recuperação de contas devido a senhas esquecidas ou credenciais perdidas é a parte mais arriscada do ciclo de vida do gerenciamento de identidades. Assim como a violação da MGM Resorts em 2023, que resultou em perdas de US$ 100 milhões, esses incidentes mostram o quanto os processos de recuperação de contas são vulneráveis a ataques de engenharia social.

A anatomia de um ataque de engenharia social

Como a IA facilita os ataques de engenharia social

A IA está transformando o crime cibernético em uma operação de baixa qualificação e grande escala — automatizando o phishing, desenvolvendo deepfakes e possibilitando o uso de malware que se adapta mais rapidamente do que as defesas conseguem responder. Essas tecnologias não apenas reduzem o esforço exigido dos invasores, mas também aumentam significativamente sua velocidade, precisão e alcance.

- Identificação de alvos: Ferramentas baseadas em IA coletam e analisam grandes volumes de dados públicos — desde perfis do LinkedIn até bancos de dados violados — para criar perfis detalhados dos alvos. O processamento de linguagem natural ajuda a identificar funções profissionais, relações e padrões de comunicação para criar iscas de phishing ou tentativas de suplantar identidade altamente convincentes.

- Credential Stuffing: A IA acelera as tentativas de login por força bruta, priorizando senhas comumente reutilizadas e ajustando estratégias em tempo real. Em 2024, a Microsoft relatou 7.000 ataques a senhas por segundo. Pesquisas demonstraram que a IA pode quebrar mais de 50% das senhas fracas em menos de um minuto.

- Falsificação de identidade: Modelos de aprendizado profundo são usados para criar áudio e vídeo deepfake realistas, imitando vozes e movimentos faciais com alta precisão. Isso permite que invasores se façam passar de forma convincente por funcionários em chamadas de suporte ao vivo, videoconferências ou até mesmo mensagens de correio de voz.

- Ataques de exaustão de MFA: Scripts de IA gerenciam tentativas repetidas de notificações push, programando-as para momentos em que é provável que haja distração (por exemplo, intervalos para almoço ou final do dia). Alguns invasores chegam a combinar isso com deepfakes de voz que se passam por suporte de TI, instando os usuários a aceitarem a solicitação.

Esses métodos aprimorados por IA estão se mostrando eficazes. Em 2024, 42% das organizações relataram ataques bem-sucedidos de phishing, vishing, deepfake ou outros ataques de engenharia social (Perspectivas Globais de Cibersegurança 2025, Fórum Econômico Mundial).

O problema central: segredos compartilhados sempre serão compartilhados

Embora a IA amplie as capacidades dos agentes maliciosos, a autenticação nas organizações ainda se baseia em métodos frágeis, como o conhecimento e a posse de senhas, códigos SMS e aplicativos de autenticação. Essas credenciais compartilháveis são facilmente obtidas das vítimas e compartilhadas por telefone.

A questão fundamental é confiar no que alguém sabe ou diz, em vez de verificar quem essa pessoa é. A força de trabalho mudou mais rapidamente do que a maioria das arquiteturas de segurança. O acesso remoto, o BYOD e os ambientes que priorizam a nuvem tornaram obsoleta a autenticação tradicional baseada no perímetro.

O Centro Nacional de Segurança Cibernética (NCSC) do Reino Unido instou as organizações a reavaliarem a forma como os serviços de suporte de TI autenticam os usuários — especialmente ao lidar com contas privilegiadas. Embora os especialistas em segurança cibernética defendam a adoção de mais camadas de segurança para prevenir ataques futuros, como senhas compartilhadas com o serviço de suporte, se essas camadas consistirem em segredos que podem ser compartilhados, elas ficam vulneráveis.

A biometria facial é resistente ao phishing

A biometria facial com detecção de vida oferece uma mudança fundamental na verificação e autenticação de funcionários.

- Não é segredo — seu rosto não pode ser compartilhado nem roubado.

- Isso confirma a identidade — não apenas se você sabe um código ou pode acessar um dispositivo, mas quem você é.

- Isso verifica a presença real — uma capacidade essencial no mundo remoto de hoje.

Mesmo que um invasor consiga convencer alguém a se autenticar, ele só conseguirá uma selfie. Uma detecção de vida baseada na nuvem garante que imagens e vídeos — mesmo falsificações de alta qualidade — não possam ser usados para contornar os fluxos de trabalho de autenticação, e está em constante evolução para mitigar novos ataques baseados em IA.

A biometria facial é a única forma de associar as atividades do usuário a uma pessoa real e viva. À medida que as organizações se esforçam para abandonar o uso de senhas e implementar arquiteturas Zero Trust, essa é uma capacidade essencial para reduzir riscos e garantir a segurança da força de trabalho.

Proteja o processo de recuperação da sua conta

À medida que a IA amplia a escala e o grau de sofisticação da engenharia social, a necessidade de uma autenticação de alta segurança e resistente ao phishing nunca foi tão evidente. A biometria facial com detecção de vida oferece uma maneira segura de verificar a identidade — e não apenas as credenciais — no ponto de maior risco.

Se a sua organização está reavaliando a forma como os usuários são verificados durante as chamadas de suporte, especialmente no que diz respeito ao acesso privilegiado, este é o momento de agir.

Não deixe que seu serviço de suporte se torne seu ponto fraco. Entre em contato conosco hoje mesmo para saber mais sobre a implantação de autenticação biométrica capaz de resistir a ataques de engenharia social, bombardeio de MFA e deepfakes sofisticados.