26 août 2023

Vous avez probablement vu une vidéo "deepfake", même si vous ne vous en êtes pas rendu compte. Ces dernières années, des Tom Cruises générés par ordinateur ont fait leur apparition un peu partout sur le web. Mark Zuckerberg est une autre cible fréquente, avec des vidéos circulant de lui disant des choses qu'il n'a pas réellement dites. Puis il y a eu le tristement célèbre deepfake de la Reine par Channel 4, délivrant un message de Noël alternatif au Royaume-Uni.

Les "deepfakes" ne sont pas un problème nouveau, mais les outils nécessaires à leur création sont de plus en plus faciles à obtenir et de plus en plus perfectionnés. En fin de compte, les deepfakes sont dangereux parce qu'ils nous empêchent de faire confiance à ce que nous voyons et entendons en ligne. Le potentiel d'abus et la menace pour les consommateurs, les gouvernements et les entreprises ne peuvent être surestimés.

Malgré la menace croissante que représentent les deepfakes pour la société, de nombreuses personnes ne savent toujours pas ce qu'est un deepfake. Pour mieux comprendre le paysage des deepfakes, iProov a interrogé 2 000 consommateurs britanniques et américains en 2025, en les exposant à une série de contenus réels et de deepfakes. Nous avons également interrogé 16 000 personnes dans huit pays en 2022 (États-Unis, Canada, Mexique, Allemagne, Italie, Espagne, Royaume-Uni et Australie), en leur posant plusieurs questions sur les deepfakes.

Dans cet article, nous partagerons nos nouvelles données, nous les comparerons à nos résultats de chaque étude et nous discuterons des solutions à apporter à cette menace croissante.

2025 Résultats de l'étude Deepfake : La plupart des consommateurs ne peuvent pas identifier les faux générés par l'IA

- Seuls 0,1 % des participants ont pu identifier correctement tous les contenus (images et vidéos), qu'il s'agisse de deepfakes ou de contenus réels, même lorsqu'on leur demandait expressément de rechercher les faux.

- 22 % n'avaient jamais entendu parler des deepfakes avant de participer à l'étude.

- Les participants étaient 36 % moins enclins à repérer les fausses vidéos que les fausses images.

- Plus de 60 % des personnes étaient confiantes dans leurs capacités de détection des "deepfakes", qu'elles aient raison ou tort (ce qui témoigne d'un dangereux excès de confiance).

- Moins de 29 % prennent des mesures lorsqu'ils sont confrontés à des "deepfakes" présumés.

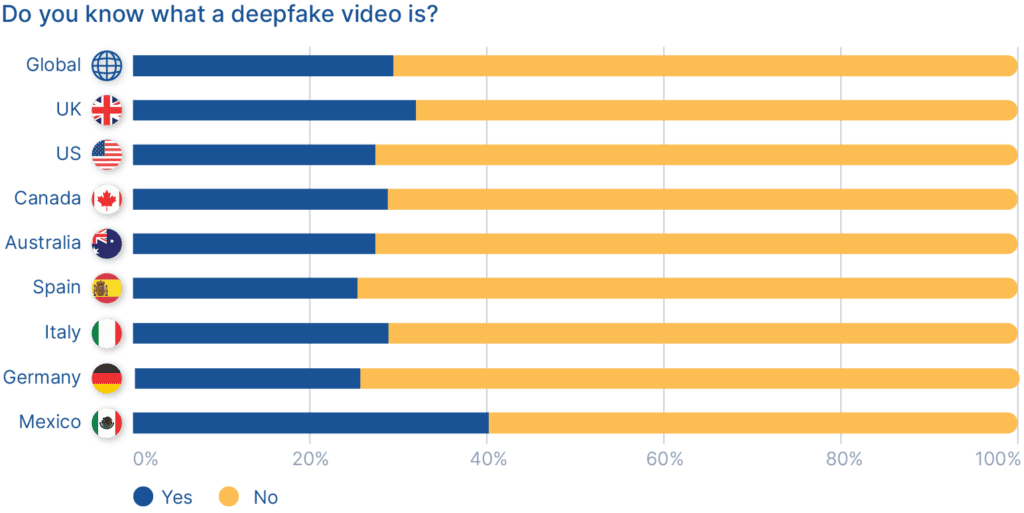

- Au niveau mondial, 71 % des personnes interrogées déclarent ne pas savoir ce qu'est un "deepfake". Un peu moins d'un tiers des consommateurs mondiaux déclarent être au courant de l'existence des deepfakes.

- 74% s'inquiètent de l'impact sociétal des deepfakes

- Seuls 11% analysent de manière critique la source et le contexte pour déterminer s'il s'agit d'un "deepfake".

Lisez l'étude complète ici et répondez au questionnaire sur le deepfake ici pour mettre vos compétences à l'épreuve.

Combien de personnes savent ce qu'est un Deepfake ?

Nous avons posé la question : "Savez-vous ce qu'est une vidéo "deepfake" ?"

- Au niveau mondial, 71 % des personnes interrogées déclarent ne pas savoir ce qu'est un "deepfake". Un peu moins d'un tiers des consommateurs mondiaux déclarent être au courant de l'existence des deepfakes.

- Le Mexique et le Royaume-Uni sont les plus familiers avec les deepfakes : 40 % des répondants mexicains et 32 % des répondants britanniques déclarent savoir ce qu'est un deepfake.

- L'Espagne et l'Allemagne sont les pays les moins bien informés sur les "deepfakes" : 75 % des personnes interrogées en Espagne et en Allemagne ont répondu "non".

Résumé :

Le pourcentage de personnes qui savent ce qu'est un deepfake a plus que doublé depuis notre dernière enquête - en 2019, seulement 13 % disaient savoir ce qu'était un deepfake, contre 29 % en 2022. D'une part, il est positif que la sensibilisation à la menace des deepfakes progresse. D'autre part, il est inquiétant de constater que seulement 29 % des personnes seront conscientes de l'existence des deepfakes en 2022. Les deepfakes présentent un potentiel important d'abus et de fraude - et si les gens ne savent pas de quoi il s'agit, ils sont moins susceptibles d'être préparés à identifier les cas d'usurpation d'identité.

Que sont les deepfakes ? Les deepfakes sont des vidéos ou des images créées à l'aide d'un logiciel d'apprentissage profond alimenté par l'IA pour montrer des personnes en train de dire ou de faire des choses qu'elles n'ont ni dites ni faites. Les deepfakes sont de plus en plus utilisés pour commettre des actes de cybercriminalité, que ce soit à des fins financières, de perturbation sociale, de fraude électorale ou à d'autres fins malveillantes. Les "deepfakes" sont utilisés pour commettre des fraudes et accéder à des services en se faisant passer pour quelqu'un d'autre, ou pour accéder à des services auxquels ils ne pourraient pas accéder avec leur véritable identité. Ils peuvent être utilisés pour la fraude à l'identité synthétique, la fraude au nouveau compte, la fraude à la prise de contrôle de compte, etc. Il existe de nombreux types d'imitations profondes - échanges de visages, reconstitutions ou réseaux adverbiaux génératifs (GAN) - et elles peuvent être déployées dans plusieurs types de menaces, telles que les attaques par présentation ou par injection numérique.

En fin de compte, la sensibilisation aux "deepfakes" et la compréhension des solutions disponibles doivent être développées et discutées plus largement.

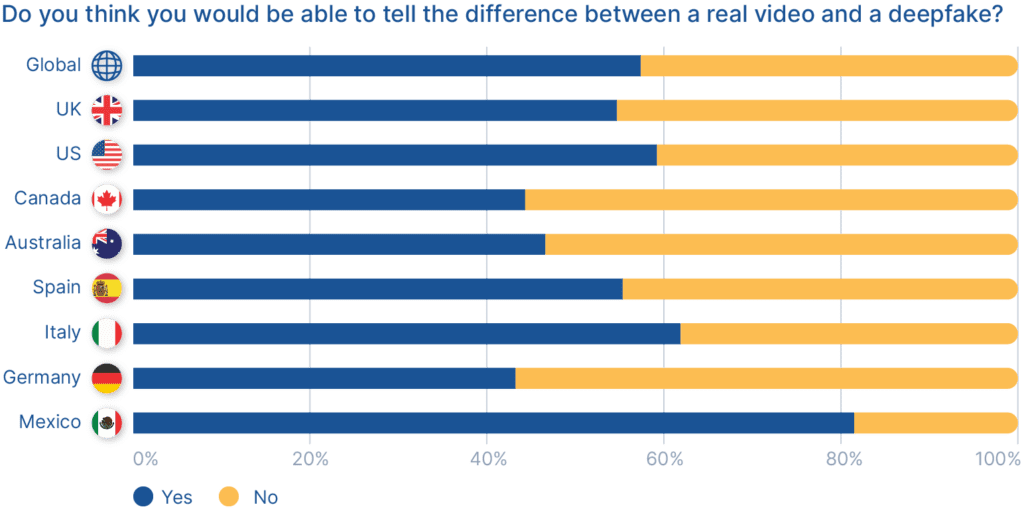

Combien de personnes pensent pouvoir repérer un Deepfake ?

Nous avons posé la question suivante : "Pensez-vous que vous seriez capable de faire la différence entre une vraie vidéo et une deepfake ?"

- 57 % des personnes interrogées dans le monde déclarent qu'elles pensent pouvoir repérer un "deepfake". 43 % admettent qu'ils ne seraient pas en mesure de faire la différence entre une vraie vidéo et une deepfake.

- Les personnes interrogées au Mexique sont les plus confiantes : 82 % d'entre elles pensent pouvoir faire la différence entre une deepfake et une vraie vidéo.

- En revanche, les personnes interrogées en Allemagne sont les moins confiantes : 57 % déclarent qu'ils ne seraient pas en mesure de faire la différence.

Résumé :

57 % des personnes interrogées dans le monde pensent pouvoir faire la différence entre une vraie vidéo et un deepfake, contre 37 % en 2019. C'est inquiétant, car la vérité est que les deepfakes sophistiqués peuvent être impossibles à distinguer à l'œil humain. Pour vérifier un deepfake, les technologies d'apprentissage profond et de vision par ordinateur sont nécessaires pour analyser certaines propriétés, telles que la façon dont la lumière se reflète sur la peau réelle par rapport à l'imagerie ou à la peau synthétique.

Le vrai problème actuellement, ce sont les deepfakes haut de gamme, comme le tristement célèbre Tom Cruise par exemple, dont la création nécessite des outils sophistiqués, des connaissances et du temps.

Si nous sommes trop confiants dans notre capacité à repérer les "deepfakes", nous risquons davantage d'être dupés par l'un d'entre eux.

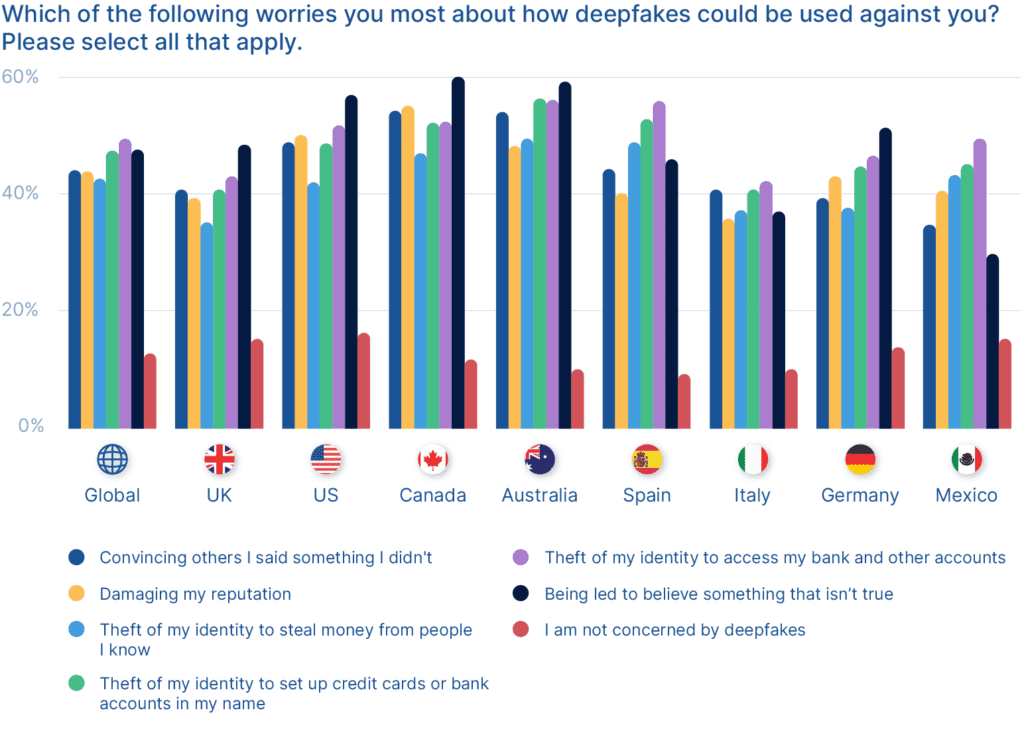

Qu'est-ce qui effraie les gens à propos des "deepfakes" ?

Nous avons demandé aux personnes interrogées : "Lequel des éléments suivants vous inquiète le plus quant à la manière dont les "deepfakes" pourraient être utilisés contre vous ? Veuillez sélectionner toutes les réponses qui s'appliquent."

- Globalement, la crainte la plus répandue concernant les "deepfakes" est qu'ils puissent être utilisés pour "voler mon identité afin d'accéder à mes comptes bancaires et autres". 50 % des personnes interrogées ont choisi cette option.

- La deuxième place est occupée par "être amené à croire quelque chose qui n'est pas vrai" et "le vol de mon identité pour ouvrir des cartes de crédit ou des comptes bancaires à mon nom", avec 48 % des personnes interrogées qui ont choisi ces options.

- Seulement 13 % des personnes interrogées au niveau mondial ne sont pas préoccupées par les "deepfakes".

Résumé :

Les craintes des gens à l'égard des "deepfakes" sont très variées. Les thèmes les plus populaires sont centrés sur le vol et la méfiance. Et ces craintes ne sont pas déplacées : les deepfakes ont été utilisés dans la vie réelle pour diffuser de la désinformation politique, harceler des activistes, escroquer un PDG de 243 000 dollars et créer de faux comptes sur les médias sociaux pour escroquer les utilisateurs authentiques.

En tant que consommateurs, nous effectuons de plus en plus d'activités numériques, ce qui signifie que nous devons être en mesure de confirmer notre identité en ligne. Or, la technologie permettant de créer des deepfakes ne cesse de s'améliorer, d'être moins chère et d'être plus facilement accessible. C'est pourquoi la protection contre les "deepfakes" deviendra de plus en plus cruciale à mesure que la menace des "deepfakes" augmentera et que de plus en plus de personnes prendront conscience des dangers.

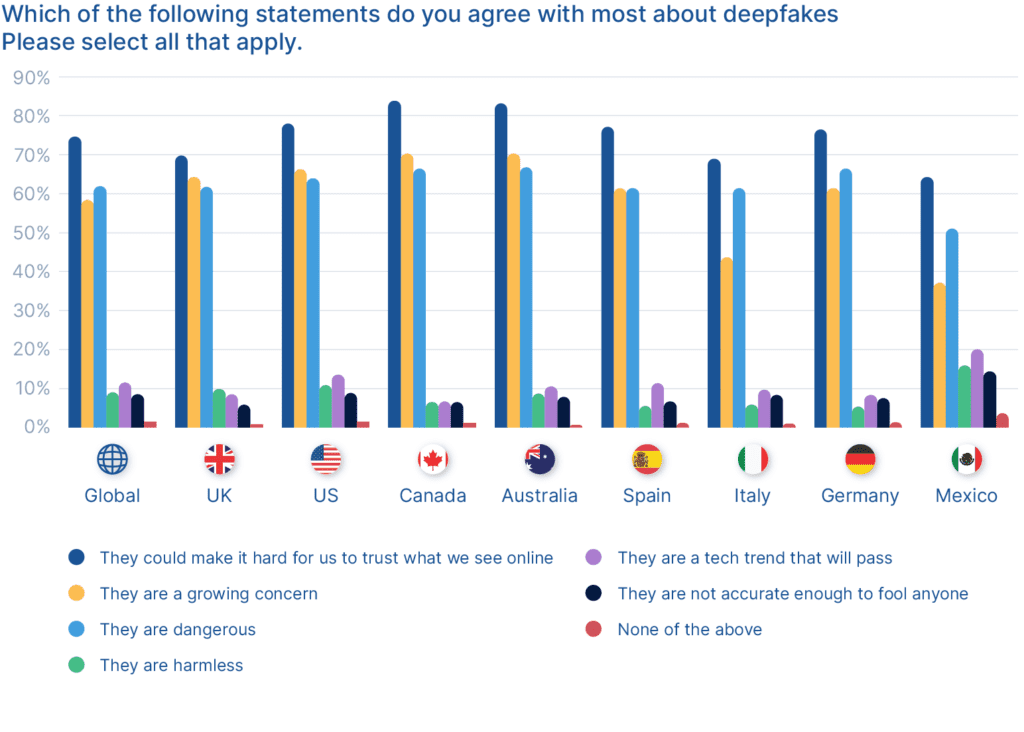

Que pensent les gens des Deepfakes ?

Nous avons ensuite demandé aux personnes interrogées : "Parmi les affirmations suivantes, laquelle vous semble la plus juste au sujet des deepfakes ? Veuillez sélectionner toutes les réponses qui s'appliquent."

- Les gens s'inquiètent surtout du fait que les deepfakes "pourraient nous empêcher de faire confiance à ce que nous voyons en ligne".

- En deuxième position, les "deepfakes" sont dangereux - 62 % des personnes interrogées dans le monde sont d'accord avec cette affirmation.

- 58 % sont également d'accord pour dire que les "deepfakes" sont une "préoccupation croissante".

- Seulement 9 % des personnes interrogées dans le monde pensent que les deepfakes "ne sont pas assez précis pour tromper qui que ce soit".

- Seuls 2 % des personnes interrogées au niveau mondial ne sont préoccupées par aucun aspect des "deepfakes".

Résumé :

Dans l'ensemble, ces données sont largement similaires à celles que nous avons recueillies en 2019. En 2019, 58 % des personnes interrogées estimaient que les deepfakes constituaient une préoccupation croissante, soit exactement la même proportion qu'en 2022. Cela montre que les consommateurs s'inquiètent à juste titre de l'érosion de la confiance en ligne. C'est ce problème difficile qu'iProov s'efforce de résoudre - notre technologie d'authentification biométrique brevetée peut garantir la présence authentique d'une personne réelle et vérifiable, confirmant qu'elle est bien celle qu'elle prétend être et qu'elle n'est pas un deepfake ou une autre attaque par présentation/injection numérique.

Pensez à la chose que vous êtes le moins susceptible de dire ou de faire. Imaginez maintenant que vos amis, votre famille ou votre employeur reçoivent une vidéo convaincante de vous en train de la dire ou de la faire. Il est facile de voir le potentiel d'utilisation malveillante. Bien entendu, les deepfakes ne sont pas tous malveillants ou dangereux. Nombre d'entre eux ont été utilisés à des fins de partage social et de divertissement. Mais ils ont également été utilisés pour des canulars, du revenge porn et, de plus en plus, pour la fraude et l'usurpation d'identité.

Recorded Future a rapporté qu'un criminel est prêt à payer environ 16 000 USD pour la création d'un deepfake haut de gamme. Les deepfakes peuvent ensuite faciliter des attaques d'ingénierie sociale avancées pour un profit important. Le problème continuera de s'aggraver à mesure que les capacités de création de deepfakes deviendront plus accessibles.

Les gens sont-ils plus enclins à utiliser des services de défense contre les "deepfakes" ?

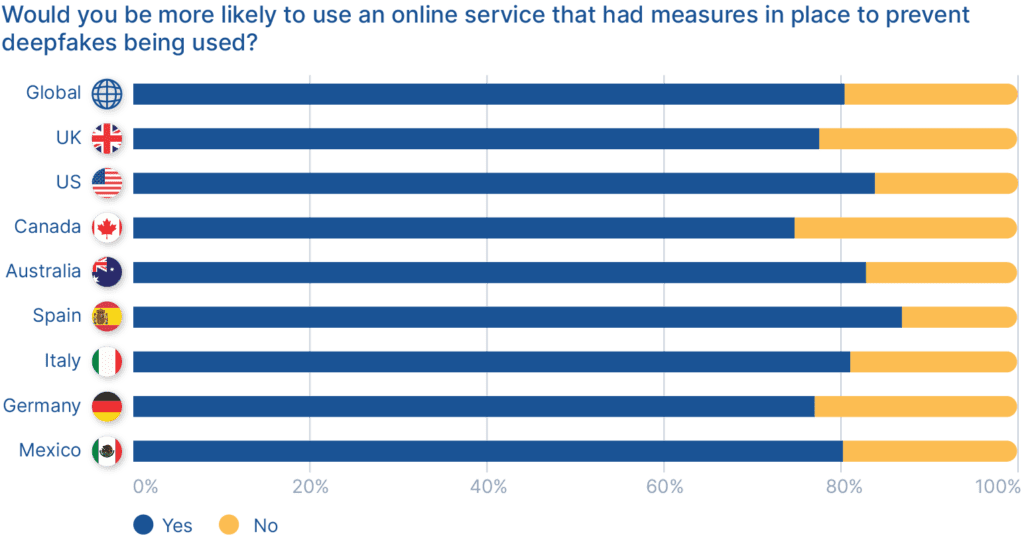

Nous avons demandé aux personnes interrogées dans le cadre de l'enquête : "Seriez-vous plus enclin à utiliser un service en ligne qui aurait mis en place des mesures pour empêcher l'utilisation de deepfakes ?"

- Une majorité écrasante a déclaré qu'elle est plus susceptible d'utiliser des services en ligne qui se défendent contre les "deepfakes" - 80 % des personnes interrogées au niveau mondial sont de cet avis.

- Les personnes interrogées en Espagne sont celles qui accordent le plus d'importance à la protection contre les "deepfakes" : 87 % d'entre elles ont répondu "oui". À l'inverse, le Canada est le moins convaincu par les mesures de prévention des deepfakes, mais même dans ce cas, 75 % des personnes interrogées ont répondu "oui".

Résumé :

Les gens accordent un peu plus d'importance à la protection contre les deepfakes en 2022 qu'en 2019 ; dans l'ensemble, 75 % ont déclaré qu'ils utiliseraient un service en ligne capable de prévenir les deepfakes, contre 80 % des personnes interrogées au niveau mondial en 2022.

Cela montre que les consommateurs veulent être assurés d'être protégés contre les attaques de type "deepfake". En mettant en œuvre la technologie Dynamic Liveness d'iProov, les gouvernements et les entreprises peuvent proposer une vérification et une authentification en ligne qui les protègent contre les médias synthétiques tels que les "deepfakes".

Comment l'authentification biométrique et la détection du caractère vivant peuvent-elles se défendre contre les "deepfakes" ?

L'authentification biométrique est utilisée pour prouver qu'une personne est bien celle qu'elle prétend être lors d'une interaction en ligne, par exemple pour ouvrir un compte bancaire ou s'inscrire à un nouveau service en ligne tel qu'un programme gouvernemental.

Les cybercriminels sont avisés et essaient un nombre croissant de méthodes différentes pour contourner la sécurité de l'authentification biométrique. Ils peuvent utiliser des photos ou des vidéos préenregistrées et les présenter à la caméra d'un appareil sous la forme d'une attaque de présentation, ou même des images synthétiques injectées numériquement dans le flux de données.

Les chercheurs s'attendent à ce que les criminels utilisent de plus en plus les "deepfakes" dans les années à venir. Il est donc essentiel de comprendre la menace des deepfakes et de s'y préparer - Europol.

C'est pourquoi la détection de l'authenticité est cruciale. Essentiellement, la détection de l'authenticité permet de s'assurer qu'un utilisateur en ligne est une personne réelle. Elle fait appel à diverses technologies pour différencier les personnes authentiques des artefacts falsifiés. Sans la détection de la présence, un criminel serait en mesure d'usurper un système en présentant de fausses photographies, vidéos ou masques.

Cependant, toutes les technologies de détection de présence ne sont pas égales. La plupart des technologies de détection de la présence peuvent détecter une attaque par présentation - l'utilisation d'artefacts physiques tels que des masques ou des sessions enregistrées diffusées sur la caméra de l'appareil pour tenter d'usurper le système, et peuvent également inclure une vidéo deepfake tenue devant une caméra.

Cependant, les autres fournisseurs de services de détection de la vivacité ne peuvent pas détecter une attaque par injection numérique, qui contourne la caméra de l'appareil (mobile ou de bureau) pour injecter des images synthétiques dans le flux de données. La technologie de détection de la vivacité d'iProov, essentielle à la mission de l'entreprise, offre le plus haut niveau d'assurance - en détectant à la fois les deepfakes présentés et les deepfakes utilisés dans les attaques par injection numérique.

La technologie brevetée Flashmark™ d'iProov utilise une illumination contrôlée pour créer une biométrie unique qui ne peut pas être recréée ou réutilisée, offrant une meilleure protection contre l'usurpation d'identité à travers une gamme d'attaques ; non seulement des attaques de présentation standard, mais aussi des attaques d'injection hautement évolutives utilisant des imitations profondes et des rediffusions sophistiquées, offrant un niveau d'assurance inégalé dans l'industrie que la personne est réelle et qu'elle s'authentifie à l'instant même.

Pour en savoir plus sur Dynamic Liveness, cliquez ici et sur la technologie innovante Flashmark qui l'alimente, cliquez ici .

Vous voulez en savoir plus sur les "Deepfakes" ?

- Rapport : Travailler à partir d'un clone : comment les criminels utilisent des "deepfakes" pour postuler à des emplois à distance

- Rapport : iProov Threat Intelligence 2024 : L'impact de l'IA générative sur la vérification d'identité à distance

- Rapport : Crise d'identité à l'ère numérique : utiliser la biométrie fondée sur la science pour lutter contre l'IA générative malveillante

- Article : Comment les Deepfakes menacent les systèmes de vérification d'identité à distance

Statistiques Deepfake : Résumé

- Les données de l'enquête d'iProov auprès des consommateurs montrent que les deepfakes sont de plus en plus connus : en 2019, seuls 13 % des consommateurs ont déclaré savoir ce qu'est un deepfake, contre 29 % en 2022. En 2025, seuls 22 % d'entre eux n'avaient jamais entendu parler des deepfakes avant de participer à notre étude. Cependant, comme les deepfakes représentent une menace pour le paysage de la confiance en ligne et potentiellement pour la sécurité nationale, la sensibilisation doit être plus importante.

- Les statistiques d'iProov sur les deepfakes montrent également que 57 % des personnes pensent pouvoir repérer un deepfake. Mais à moins que le deepfake ne soit mal construit, il est probable que cela ne soit pas vrai. Pour vérifier un deepfake, les technologies d'apprentissage en profondeur et de vision par ordinateur sont nécessaires pour analyser certaines propriétés, comme la façon dont la lumière se reflète sur la peau réelle par rapport à la peau synthétique ou à l'imagerie.

- Les données d'iProov montrent également que les gens sont plus enclins à utiliser des services qui prennent des mesures contre les "deepfakes" - 80 % des personnes interrogées dans le monde sont de cet avis. Il s'agit là d'un signal d'alarme clair pour les fournisseurs de services en ligne : pour conserver ou gagner la confiance des utilisateurs, vous devez mettre en œuvre une technologie capable de se défendre contre les "deepfakes".

- Les deepfakes constituent une menace unique et difficile qui nécessite une solution unique. C'est pourquoi la technologie biométrique brevetée d'iProov, Dynamic Liveness, est conçue pour offrir une protection avancée contre les deepfakes et autres attaques avancées.

- Seule iProov Dynamic Liveness est en mesure de fournir le niveau d'assurance requis pour la défense contre les "deepfakes".

Découvrez comment iProov protège contre les deepfakes - réservez votre démonstration iProov ou contactez-nous.