26 agosto 2023

Probabilmente avete visto un video deepfake, anche se non ve ne siete resi conto. Negli ultimi anni i Tom Cruise generati dal computer sono spuntati dappertutto sul web. Mark Zuckerberg è un altro bersaglio comune, con video che lo ritraggono mentre dice cose che in realtà non ha detto. Poi c'è stato il famigerato deepfake della Regina di Channel 4, che consegnava un messaggio natalizio alternativo nel Regno Unito.

I deepfakes non sono un problema nuovo, ma gli strumenti necessari per crearli stanno diventando sempre più disponibili e avanzati. In definitiva, i deepfake sono pericolosi perché ci rendono difficile fidarci di ciò che vediamo e sentiamo online. Il potenziale di abuso e la minaccia per i consumatori, i governi e le imprese non possono essere sopravvalutati.

Nonostante la crescente minaccia dei deepfake per la società, molte persone non sanno ancora cosa sia un deepfake. Per comprendere meglio il panorama dei deepfake, iProov ha intervistato 2.000 consumatori del Regno Unito e degli Stati Uniti nel 2025, esponendoli a una serie di contenuti reali e deepfake. Nel 2022, inoltre, abbiamo intervistato 16.000 persone in otto Paesi (Stati Uniti, Canada, Messico, Germania, Italia, Spagna, Regno Unito e Australia), ponendo loro diverse domande sui deepfake.

In questo articolo condivideremo i nostri nuovi dati, li confronteremo con i risultati di ogni studio e discuteremo le soluzioni alla crescente minaccia.

2025 Risultati dello studio Deepfake: La maggior parte dei consumatori non è in grado di identificare i falsi generati dall'AI

- Solo lo 0,1% dei partecipanti è riuscito a identificare correttamente tutti i deepfake e i contenuti reali (immagini e video), anche quando gli è stato detto specificamente di cercare i falsi.

- Il 22% non aveva mai sentito parlare di deepfakes prima di partecipare allo studio.

- I partecipanti avevano il 36% in meno di probabilità di individuare video falsi rispetto a immagini false.

- Oltre il 60% delle persone era fiducioso nelle proprie capacità di rilevamento dei deepfake, indipendentemente dal fatto che avessero ragione o torto (mostrando una pericolosa overconfidence)

- Meno del 29% prende provvedimenti quando si imbatte in sospetti deepfakes

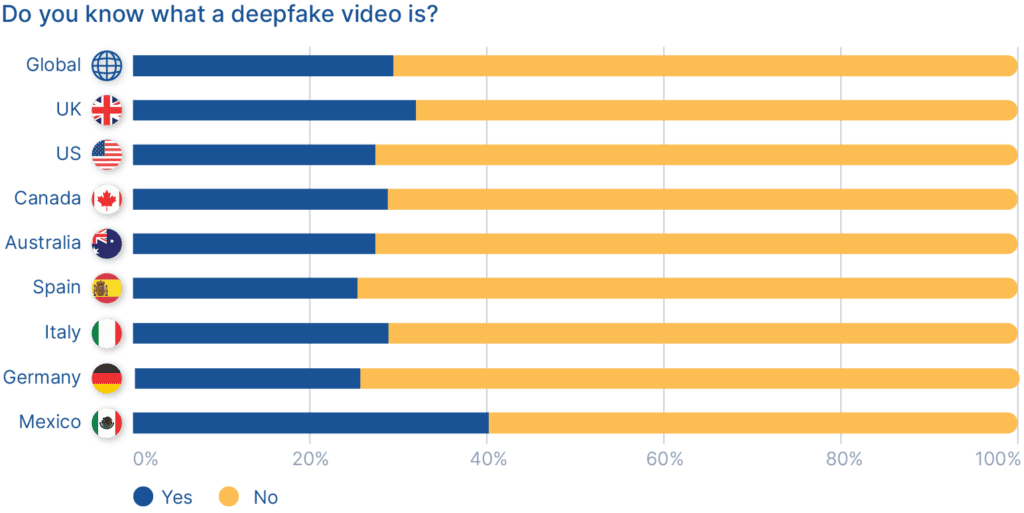

- A livello globale, il 71% degli intervistati dichiara di non sapere cosa sia un deepfake. Poco meno di un terzo dei consumatori globali dichiara di essere a conoscenza dei deepfake.

- Il 74% si preoccupa dell'impatto sociale dei deepfake

- Solo l'11% analizza criticamente la fonte e il contesto per determinare se qualcosa è un deepfake.

Leggete lo studio completo qui e fate il quiz di deepfake qui per mettere alla prova le vostre capacità.

Quanti sanno cos'è un Deepfake?

Abbiamo chiesto: "Sai cos'è un video deepfake?".

- A livello globale, il 71% degli intervistati dichiara di non sapere cosa sia un deepfake. Poco meno di un terzo dei consumatori globali dichiara di essere a conoscenza dei deepfake.

- Messico e Regno Unito hanno maggiore familiarità con i deepfake: Il 40% degli intervistati messicani e il 32% di quelli britannici dicono di sapere cosa sia un deepfake.

- Spagna e Germania si sentono le meno istruite sui deepfakes: Il 75% degli intervistati sia in Spagna che in Germania ha risposto "No".

Sintesi:

La percentuale di persone che sanno cosa sia un deepfake è più che raddoppiata dal nostro ultimo sondaggio: nel 2019, solo il 13% dichiarava di sapere cosa fosse un deepfake, rispetto al 29% nel 2022. Da un lato, è positivo che la consapevolezza della minaccia deepfake stia crescendo. D'altro canto, è preoccupante che solo il 29% delle persone sia a conoscenza dei deepfake nel 2022. I deepfake hanno un notevole potenziale di abuso e frode e, se le persone non sanno cosa sono, è meno probabile che siano preparate a identificare quando vengono falsificati.

Cosa sono i deepfakes? I deepfakes sono video o immagini creati utilizzando un software di deep learning alimentato dall'intelligenza artificiale per mostrare persone che dicono e fanno cose che non hanno detto o fatto. I deepfakes vengono sempre più spesso utilizzati per commettere crimini informatici, a scopo di lucro, di disturbo sociale, di frode elettorale o per altri scopi nefasti. I deepfake vengono utilizzati per commettere frodi e accedere a servizi fingendo di essere qualcun altro, o per ottenere l'accesso a servizi a cui non sarebbe possibile accedere utilizzando la propria vera identità. Possono essere utilizzati per frodi di identità sintetica, frodi di nuovi account, frodi di acquisizione di account e altro ancora. Esistono molti tipi di deepfake - face swap, re-enactment o Generative Adversarial Networks (GAN) - e possono essere impiegati in diversi tipi di minacce, come gli attacchi di presentazione o di iniezione digitale.

In definitiva, la consapevolezza dei deepfakes e la comprensione delle soluzioni disponibili devono essere ampliate e discusse più ampiamente.

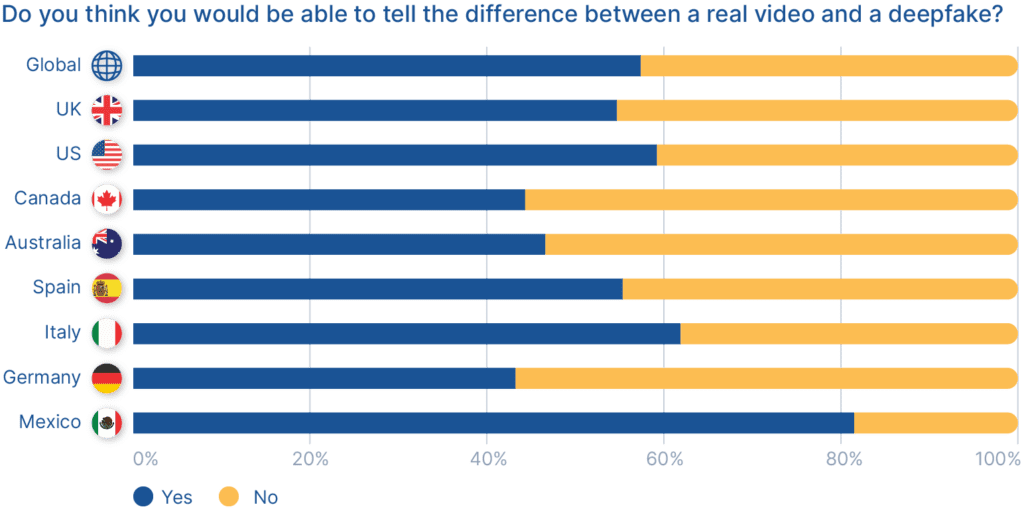

Quante persone pensano di poter individuare un Deepfake?

Abbiamo chiesto: "Pensi che saresti in grado di distinguere tra un video reale e un deepfake?".

- Il 57% degli intervistati globali afferma di essere in grado di riconoscere un deepfake. Il 43% ammette che non sarebbe in grado di distinguere tra un video reale e un deepfake.

- Gli intervistati messicani sono i più fiduciosi: l'82% ritiene di poter distinguere un deepfake da un video reale.

- Nel frattempo, gli intervistati tedeschi sono meno fiduciosi: Il 57% afferma che non sarebbe in grado di capire la differenza.

Sintesi:

Il 57% degli intervistati a livello globale ritiene di poter distinguere un video reale da un deepfake, con un aumento rispetto al 37% del 2019. Questo dato è preoccupante perché la verità è che i deepfake sofisticati possono essere indistinguibili all'occhio umano. Per verificare un deepfake, le tecnologie di deep learning e di computer vision sono necessarie per analizzare alcune proprietà, come il modo in cui la luce si riflette sulla pelle reale rispetto alle immagini o alla pelle sintetica.

Il vero problema è rappresentato dai deepfake di alto livello, come quello famigerato di Tom Cruise, che richiedono strumenti sofisticati, conoscenze e tempo per essere creati.

Se siamo troppo fiduciosi nella nostra capacità di individuare i deepfakes, allora siamo più a rischio di essere ingannati da uno di essi.

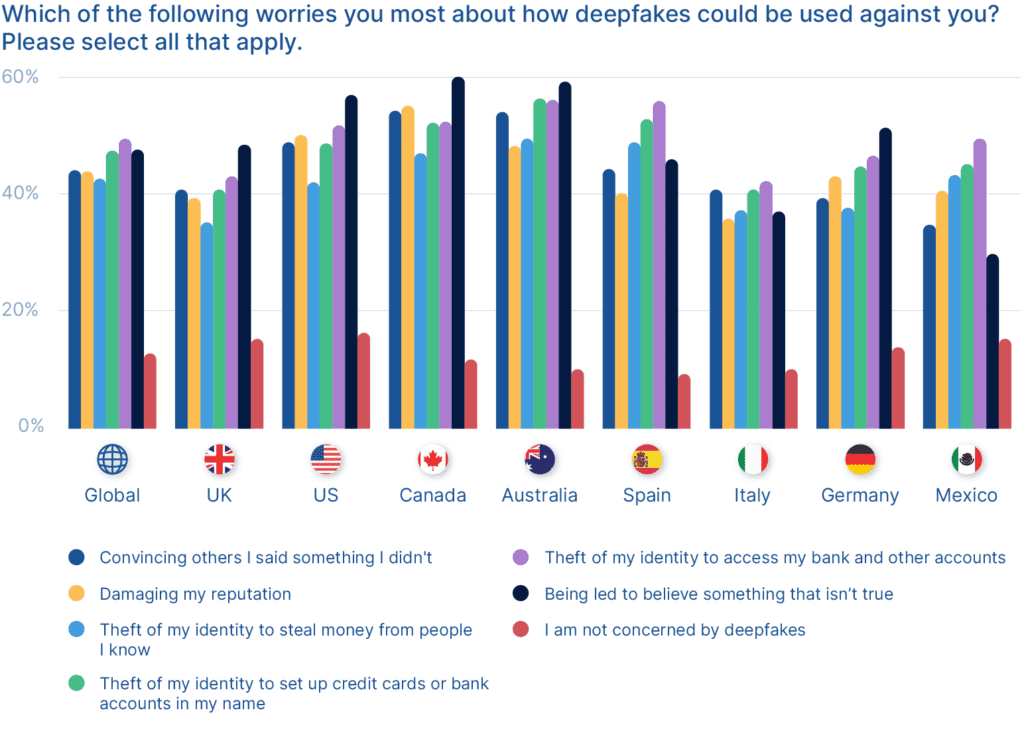

Cosa spaventa la gente dei deepfake?

Abbiamo chiesto agli intervistati: "Quale delle seguenti cose la preoccupa di più del modo in cui i deepfakes potrebbero essere usati contro di lei? Per favore, seleziona tutte quelle che si applicano".

- A livello globale, il timore più diffuso riguardo ai deepfake è che possano essere utilizzati per "rubare la mia identità per accedere alla mia banca e ad altri conti". Il 50% degli intervistati ha scelto questa opzione.

- Il 48% ha scelto le opzioni "essere indotti a credere qualcosa di non vero" e "furto della mia identità per creare carte di credito o conti bancari a mio nome".

- Solo il 13% degli intervistati a livello globale non è preoccupato dai deepfakes.

Sintesi:

Le paure che circondano i deepfakes sono molto varie. I temi più diffusi riguardano il furto e la sfiducia. E questi timori non sono fuori luogo: i deepfake sono stati usati nella vita reale per spingere la disinformazione politica, molestare gli attivisti, truffare un amministratore delegato per 243.000 dollari e creare falsi account sui social media per frodare gli utenti autentici.

Come consumatori, continuiamo a svolgere sempre più attività in digitale, il che significa che dobbiamo essere in grado di confermare la nostra identità online. Tuttavia, la tecnologia per creare deepfake è sempre migliore, più economica e più facilmente disponibile. Ecco perché la protezione dai deepfake diventerà sempre più cruciale man mano che la minaccia dei deepfake crescerà e sempre più persone saranno consapevoli dei pericoli.

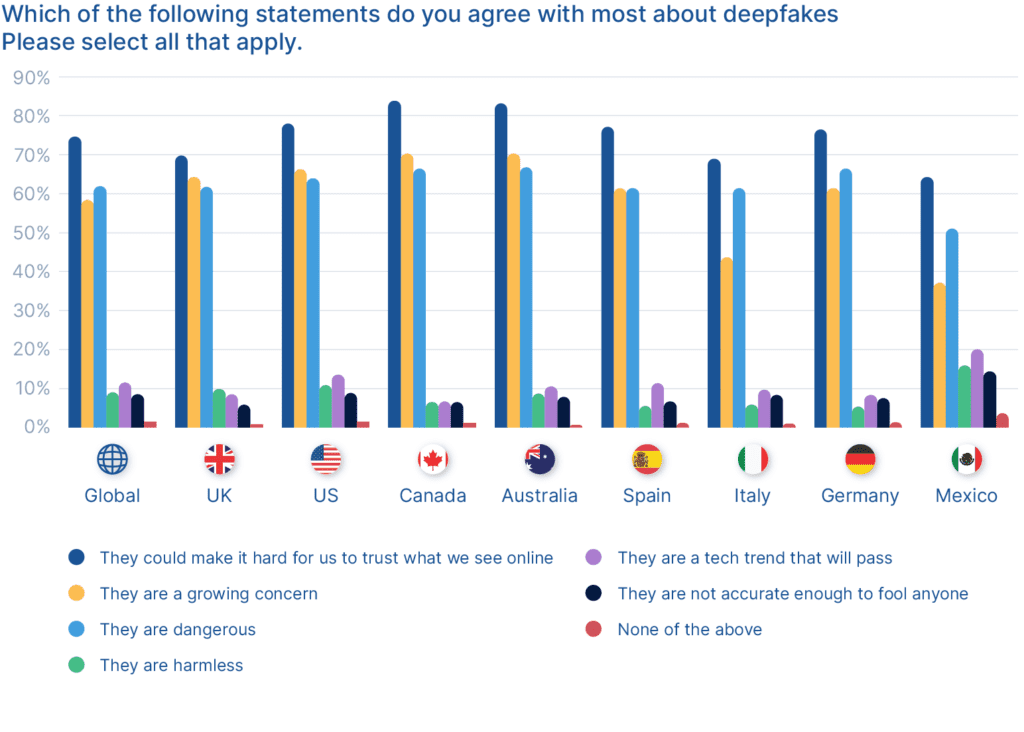

Cosa pensa la gente dei deepfakes?

Abbiamo poi chiesto agli intervistati: "Con quale delle seguenti affermazioni è più d'accordo riguardo ai deepfake? Selezioni tutte quelle che si applicano".

- La preoccupazione maggiore è che i deepfakes "possano rendere difficile la fiducia in ciò che vediamo online".

- Il 62% degli intervistati a livello globale concorda sul fatto che "i deepfakes sono pericolosi".

- Il 58% concorda anche sul fatto che i deepfakes sono una "preoccupazione crescente".

- Solo il 9% degli intervistati a livello globale ritiene che i deepfake "non siano abbastanza precisi da ingannare qualcuno".

- Solo il 2% degli intervistati a livello globale non si preoccupa di alcun aspetto dei deepfakes.

Sintesi:

Nel complesso, si tratta di dati in gran parte simili a quelli raccolti nel 2019. Nel 2019, il 58% era d'accordo sul fatto che i deepfakes fossero una preoccupazione crescente, esattamente come nel 2022. Ciò dimostra che i consumatori sono giustamente preoccupati per l'erosione della fiducia online. Questo è il difficile problema che iProov si sforza di risolvere: la nostra tecnologia di autenticazione biometrica brevettata può assicurare la presenza genuina di un individuo reale e verificabile, confermando che è chi dice di essere e che non è un deepfake o un altro attacco di presentazione/iniezione digitale.

Pensate alla cosa che è meno probabile che diciate o facciate. Ora immaginate che ai vostri amici, familiari o datori di lavoro venga mostrato un video convincente in cui la dite o la fate. È facile intuire il potenziale per un uso improprio. Naturalmente, non tutti i deepfake sono dannosi o pericolosi. Molti sono stati utilizzati per la condivisione sociale e l'intrattenimento. Ma sono stati utilizzati anche per bufale, revenge porn e, sempre più spesso, per frodi e impersonificazioni.

Recorded Future ha riferito che un criminale è disposto a pagare circa ~16.000 USD per la creazione di un deepfake di alto livello. I deepfake possono quindi facilitare attacchi avanzati di ingegneria sociale con un profitto significativo. Il problema continuerà a peggiorare man mano che le capacità di deepfake diventeranno più accessibili.

Le persone sono più propense a utilizzare servizi che difendono dai deepfake?

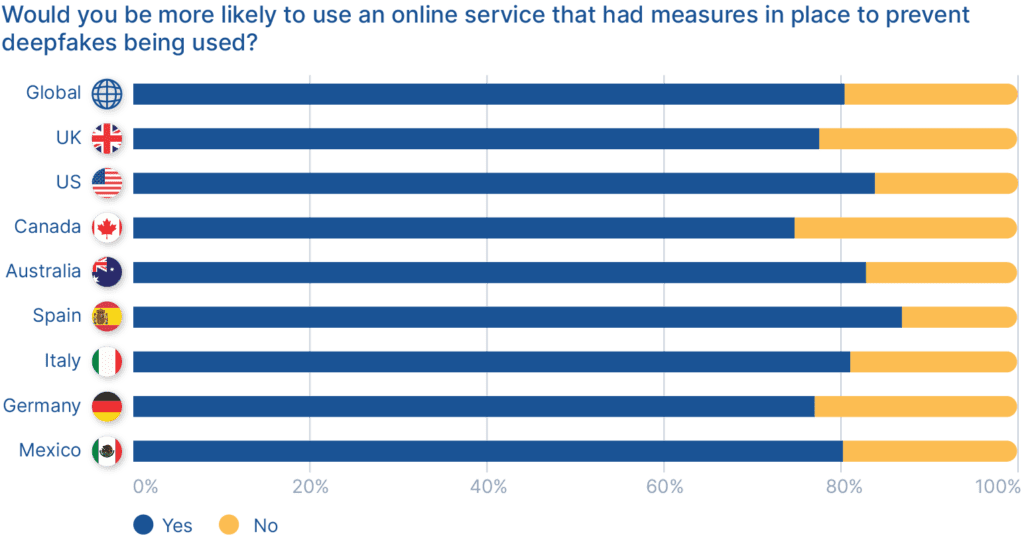

Abbiamo chiesto agli intervistati: "Saresti più propenso ad utilizzare un servizio online che avesse misure in atto per prevenire l'uso di deepfakes?".

- La stragrande maggioranza ha dichiarato di essere più propensa a utilizzare servizi online che difendono dai deepfakes - l'80% degli intervistati a livello globale è d'accordo.

- Gli intervistati spagnoli sono quelli che apprezzano di più la protezione dai deepfake: l'87% ha risposto "Sì". Al contrario, il Canada è il meno convinto delle misure di prevenzione dei deepfake, ma anche in questo caso un clamoroso 75% ha risposto "Sì".

Sintesi:

Nel 2022 le persone apprezzano la protezione dai deepfake un po' di più rispetto al 2019; complessivamente, il 75% ha dichiarato che utilizzerebbe un servizio online in grado di prevenire i deepfake, contro l'80% degli intervistati globali nel 2022.

Ciò dimostra che i consumatori vogliono essere rassicurati sulla protezione dagli attacchi deepfake. Implementando la tecnologia Dynamic Liveness di iProov, i governi e le imprese possono fornire una verifica e un'autenticazione online che protegga da supporti sintetici come i deepfake.

Come possono l'autenticazione biometrica e il Liveness Detection difendersi dai deepfake?

L'autenticazione biometrica viene utilizzata per dimostrare che una persona è chi dice di essere in un'interazione online, come l'accesso a un conto bancario o l'iscrizione a un nuovo servizio online come un programma governativo.

I criminali informatici sono esperti e provano un numero sempre maggiore di metodi diversi per aggirare la sicurezza dell'autenticazione biometrica. Potrebbero utilizzare foto o video preregistrati e poi metterli davanti alla fotocamera di un dispositivo sotto forma di attacco di presentazione, o anche immagini sintetiche che vengono iniettate digitalmente nel flusso di dati.

I ricercatori prevedono che nei prossimi anni i criminali aumenteranno l'uso dei deepfake. Questo dimostra che è fondamentale comprendere la minaccia dei deepfake e prepararsi -. Europol.

Ecco perché il rilevamento della vivacità è fondamentale. In sostanza, il liveness detection garantisce che un utente online sia una persona reale. Utilizza varie tecnologie per distinguere tra esseri umani autentici e artefatti fasulli. Senza il rilevamento dell'identità, un criminale sarebbe in grado di falsificare con successo un sistema presentando fotografie, video o maschere false.

Tuttavia, non tutti i sistemi di rilevamento della presenza sono uguali. La maggior parte delle tecnologie di liveness detection è in grado di rilevare un attacco di presentazione, ovvero l'uso di artefatti fisici come maschere o sessioni registrate riprodotte alla telecamera del dispositivo per tentare di falsificare il sistema, e potrebbe anche includere un video deepfake tenuto davanti a una telecamera.

Tuttavia, altri fornitori di liveness non sono in grado di rilevare un attacco di tipo digital injection, che bypassa la fotocamera del dispositivo (mobile o desktop) per iniettare immagini sintetiche nel flusso di dati. La tecnologia di liveness detection mission-critical di iProov offre il massimo livello di garanzia, rilevando sia i deepfake presentati che quelli utilizzati negli attacchi di tipo digital injection.

La tecnologia brevettata Flashmark™ di iProov utilizza un'illuminazione controllata per creare un dato biometrico unico che non può essere ricreato o riutilizzato, fornendo una maggiore protezione contro gli attacchi, non solo quelli standard di presentazione, ma anche quelli a iniezione altamente scalabili che utilizzano deepfake e replay sofisticati, offrendo un livello di garanzia leader nel settore che la persona è reale e si sta autenticando in questo momento.

Per saperne di più su Dynamic Liveness e sull'innovativa tecnologia Flashmark che la alimenta, cliccate qui.

Volete saperne di più sui deepfakes?

- Rapporto: Lavoro da clone: come i criminali usano i deepfake per candidarsi a lavori a distanza

- Rapporto: iProov Threat Intelligence 2024: L'impatto dell'IA generativa sulla verifica dell'identità a distanza

- Relazione: Crisi dell'identità nell'era digitale: l'uso della biometria basata sulla scienza per combattere l'IA generativa dannosa

- Articolo: Come i deepfakes minacciano i sistemi di verifica dell'identità a distanza

Statistiche Deepfake: Riepilogo

- I dati dell'indagine sui consumatori di iProov mostrano che la consapevolezza dei deepfake sta crescendo: nel 2019, solo il 13% dei consumatori ha dichiarato di sapere cosa sia un deepfake, rispetto al 29% nel 2022. Entro il 2025, solo il 22% non aveva mai sentito parlare di deepfake prima di partecipare al nostro studio. Tuttavia, poiché i deepfake rappresentano una minaccia per il panorama della fiducia online e potenzialmente per la sicurezza nazionale, la consapevolezza deve essere maggiore.

- Le statistiche sui deepfake di iProov mostrano anche che il 57% delle persone ritiene di poter individuare un deepfake. Ma a meno che il deepfake non sia mal costruito, è probabile che questo non sia vero. Per verificare un deepfake, sono necessarie tecnologie di deep learning e di computer vision per analizzare alcune proprietà, come il modo in cui la luce si riflette sulla pelle reale rispetto a quella sintetica o alle immagini.

- I dati di iProov mostrano anche che le persone sono più propense a utilizzare servizi che adottano misure contro i deepfakes - l'80% degli intervistati a livello globale è d'accordo. Questo è un chiaro campanello d'allarme per i fornitori di servizi online: per mantenere o guadagnare la fiducia degli utenti, è necessario implementare una tecnologia in grado di difendersi dai deepfakes.

- I deepfakes sono una minaccia unica e impegnativa che richiede una soluzione unica. Ecco perché la tecnologia biometrica brevettata da iProov, Dynamic Liveness, è stata progettata per offrire una protezione avanzata contro i deepfakes e altri attacchi avanzati.

- Solo iProov Dynamic Liveness è in grado di fornire il livello di garanzia richiesto per la difesa dai deepfakes.

Scoprite come iProov protegge dai deepfakes - prenotate la vostra demo iProov o contattateci.