26. August 2023

Wahrscheinlich haben Sie schon einmal ein Deepfake-Video gesehen - auch wenn Sie es nicht bemerkt haben. Computergenerierte Tom Cruises sind in den letzten Jahren überall im Internet aufgetaucht. Auch Mark Zuckerberg ist ein häufiges Ziel: Es kursieren Videos von ihm, in denen er Dinge sagt, die er in Wirklichkeit nicht gesagt hat. Und dann war da noch das berüchtigte Deepfake der Königin durch Channel 4, die im Vereinigten Königreich eine alternative Weihnachtsbotschaft überbrachte.

Deepfakes sind kein neues Problem, aber die Werkzeuge, die für ihre Herstellung benötigt werden, werden immer leichter verfügbar und fortschrittlicher. Letztlich sind Deepfakes gefährlich, weil sie es uns schwer machen, dem zu vertrauen, was wir online sehen und hören. Das Missbrauchspotenzial und die Bedrohung für Verbraucher, Regierungen und Unternehmen können gar nicht hoch genug eingeschätzt werden.

Trotz der wachsenden Bedrohung der Gesellschaft durch Deepfakes wissen viele Menschen immer noch nicht, was ein Deepfake ist. Um die Deepfake-Landschaft besser zu verstehen, befragte iProov im Jahr 2025 2.000 Verbraucher in Großbritannien und den USA und setzte sie einer Reihe von echten und gefälschten Inhalten aus. Zuvor hatten wir im Jahr 2022 16.000 Menschen in acht Ländern (USA, Kanada, Mexiko, Deutschland, Italien, Spanien, Großbritannien und Australien) befragt und ihnen verschiedene Fragen zu Deepfakes gestellt.

In diesem Artikel stellen wir unsere neuen Daten vor, vergleichen sie mit unseren Ergebnissen aus den einzelnen Studien und diskutieren Lösungen für die wachsende Bedrohung.

2025 Ergebnisse der Deepfake-Studie: Die meisten Verbraucher können KI-generierte Fälschungen nicht erkennen

- Nur 0,1 % der Teilnehmer konnten alle Deepfake- und echten Inhalte (Bilder und Videos) korrekt identifizieren - selbst wenn sie ausdrücklich aufgefordert wurden, nach Fälschungen zu suchen.

- 22 % hatten vor der Teilnahme an der Studie noch nie etwas von Deepfakes gehört.

- Die Wahrscheinlichkeit, gefälschte Videos zu erkennen, war um 36 % geringer als bei gefälschten Bildern.

- Über 60 % der Befragten waren von ihren Fähigkeiten zur Erkennung von Fälschungen überzeugt, unabhängig davon, ob sie richtig oder falsch lagen (eine gefährliche Selbstüberschätzung).

- Weniger als 29 % ergreifen Maßnahmen, wenn sie auf mutmaßliche Deepfakes stoßen

- Weltweit geben 71 % der Befragten an, sie wüssten nicht, was ein Deepfake ist. Knapp ein Drittel der Verbraucher weltweit gibt an, dass sie über Deepfakes Bescheid wissen.

- 74 % machen sich Sorgen über die gesellschaftlichen Auswirkungen von Deepfakes

- Nur 11 % analysieren kritisch die Quelle und den Kontext, um festzustellen, ob etwas ein Deepfake ist

Lesen Sie die vollständige Studie hier und machen Sie das Deepfake-Quiz hier, um Ihr Wissen zu testen.

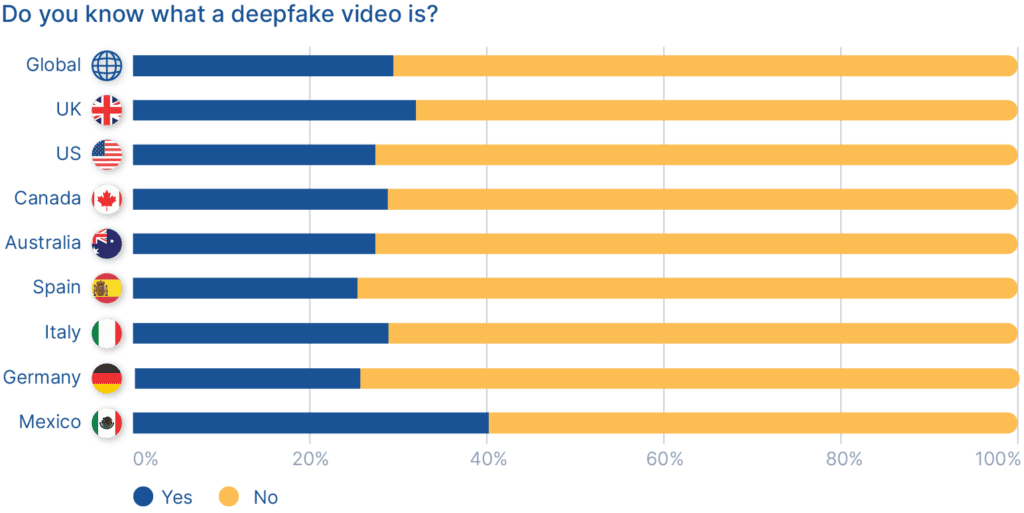

Wie viele Menschen wissen, was ein Deepfake ist?

Wir haben gefragt: "Wisstihr, was ein Deepfake-Video ist?"

- Weltweit geben 71 % der Befragten an, sie wüssten nicht, was ein Deepfake ist. Knapp ein Drittel der Verbraucher weltweit gibt an, dass sie über Deepfakes Bescheid wissen.

- Mexiko und das Vereinigte Königreich sind am besten mit Deepfakes vertraut: 40 % der mexikanischen Befragten und 32 % der britischen Befragten gaben an, dass sie wissen, was ein Deepfake ist.

- Spanien und Deutschland fühlen sich am wenigsten über Deepfakes aufgeklärt: Sowohl in Spanien als auch in Deutschland antworteten 75 % der Befragten mit "Nein".

Zusammenfassung:

Der Prozentsatz der Menschen, die wissen, was ein Deepfake ist, hat sich seit unserer letzten Umfrage mehr als verdoppelt - 2019 sagten nur 13 %, sie wüssten, was ein Deepfake ist, verglichen mit 29 % im Jahr 2022. Einerseits ist es positiv, dass das Bewusstsein für die Deepfake-Bedrohung wächst. Andererseits ist es besorgniserregend, dass im Jahr 2022 nur 29 % der Menschen über Deepfakes Bescheid wissen. Deepfakes bergen ein erhebliches Potenzial für Missbrauch und Betrug - und wenn die Menschen nicht wissen, was sie sind, sind sie wahrscheinlich auch nicht darauf vorbereitet, zu erkennen, wenn sie gefälscht werden.

Was sind Deepfakes? Deepfakes sind Videos oder Bilder, die mithilfe von KI-gestützter Deep-Learning-Software erstellt wurden, um Personen zu zeigen, die Dinge sagen oder tun, die sie nicht gesagt oder getan haben. Deepfakes werden zunehmend zur Begehung von Cyberkriminalität eingesetzt - sei es zur Erzielung finanzieller Gewinne, zur Störung der Gesellschaft, zum Wahlbetrug oder für andere ruchlose Zwecke. Deepfakes werden verwendet, um Betrug zu begehen und sich Zugang zu Diensten zu verschaffen, indem sie vorgeben, jemand anderes zu sein, oder um Zugang zu Diensten zu erhalten, auf die sie mit ihrer echten Identität nicht zugreifen könnten. Sie können u. a. bei Betrug mit synthetischer Identität, bei Betrug mit neuen Konten und bei Betrug mit Kontoübernahmen eingesetzt werden. Es gibt viele Arten von Deepfakes - Face Swaps, Reenactments oder Generative Adversarial Networks (GANs) - und sie können bei verschiedenen Bedrohungsarten wie Präsentations- oder Digital-Injection-Angriffen eingesetzt werden.

Letztlich muss das Bewusstsein für Deepfakes und das Verständnis für die verfügbaren Lösungen erweitert und breiter diskutiert werden.

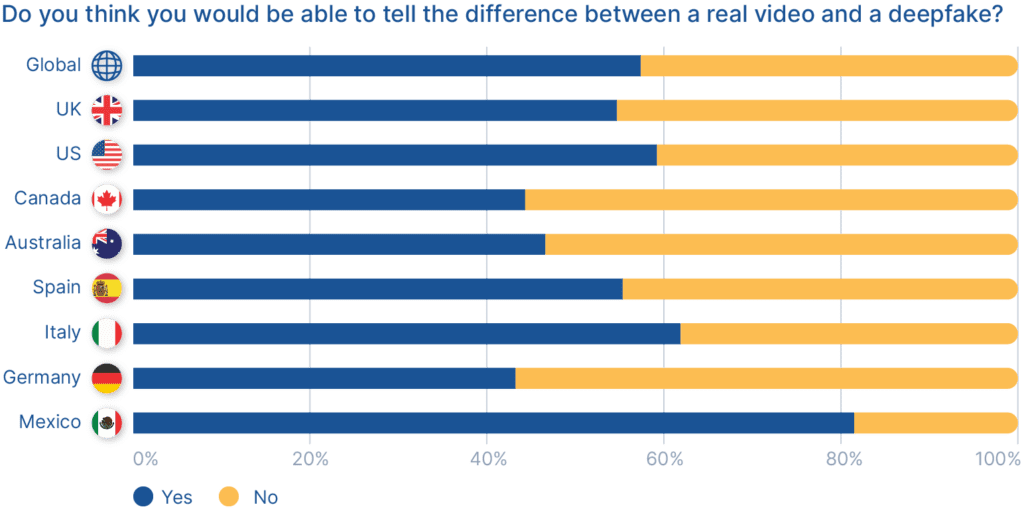

Wie viele Menschen glauben, dass sie einen Deepfake erkennen können?

Wir haben gefragt: "Glauben Sie, dass Sie in der Lage wären, zwischen einem echten Video und einem Deepfake zu unterscheiden?"

- 57 % der weltweit Befragten geben an, dass sie glauben, einen Deepfake erkennen zu können. 43 % geben zu, dass sie nicht in der Lage wären, zwischen einem echten Video und einem Deepfake zu unterscheiden.

- Die Befragten aus Mexiko sind am zuversichtlichsten - 82 % glauben, dass sie einen Deepfake von einem echten Video unterscheiden können.

- Die Befragten aus Deutschland sind dagegen am wenigsten zuversichtlich: 57 % geben an, dass sie den Unterschied nicht erkennen könnten.

Zusammenfassung:

57 % der weltweit Befragten glauben, dass sie ein echtes Video von einem Deepfake unterscheiden können. 2019 waren es noch 37 %. Dies ist besorgniserregend, denn in Wahrheit können raffinierte Deepfakes für das menschliche Auge nicht zu unterscheiden sein. Um ein Deepfake zu verifizieren, sind Deep-Learning- und Computer-Vision-Technologien erforderlich, um bestimmte Eigenschaften zu analysieren, z. B. wie das Licht auf echter Haut im Vergleich zu Bildern oder synthetischer Haut reflektiert wird.

Das eigentliche Problem sind die hochwertigen Deepfakes, wie z. B. das berüchtigte Tom Cruise-Fake, für deren Erstellung ausgefeilte Tools, Kenntnisse und Zeit erforderlich sind.

Wenn wir uns zu sehr auf unsere Fähigkeit verlassen, Täuschungsmanöver zu erkennen, besteht die Gefahr, dass wir auf ein solches hereinfallen.

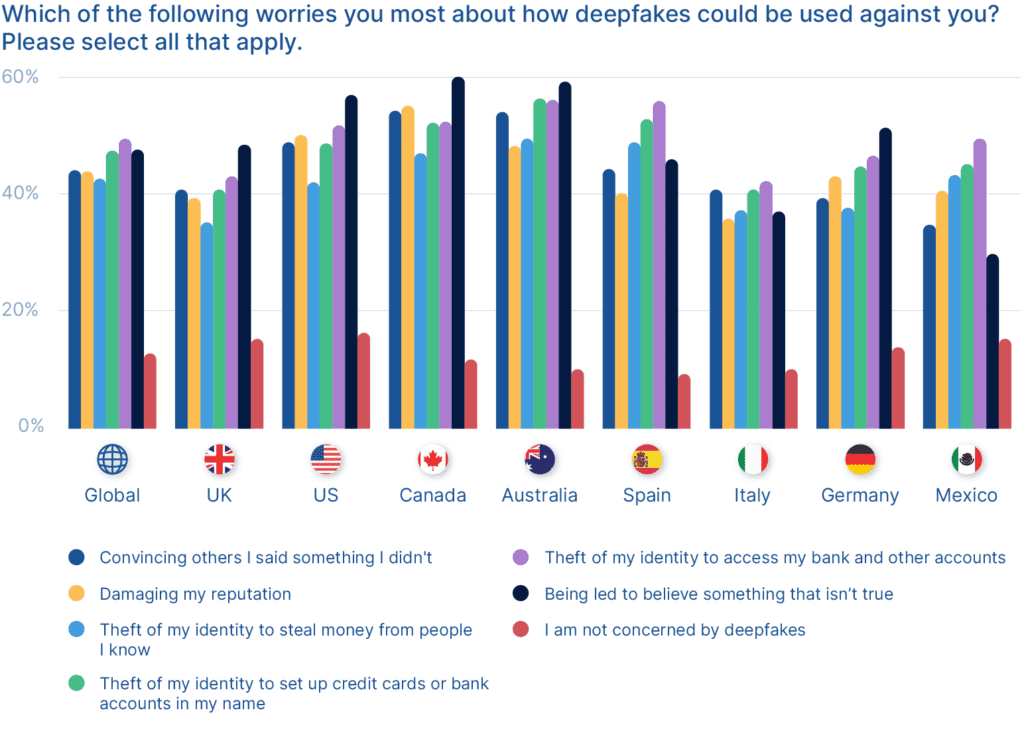

Was macht den Menschen Angst vor Deepfakes?

Wir haben die Befragten gefragt: "Was macht Ihnen am meisten Sorgen, wie Deepfakes gegen Sie verwendet werden könnten? Bitte wählen Sie alles aus, was zutrifft."

- Die weltweit am häufigsten genannte Befürchtung im Zusammenhang mit Deepfakes ist, dass sie zum "Diebstahl meiner Identität verwendet werden könnten, um Zugang zu meinen Bank- und anderen Konten zu erhalten". 50 % der Befragten wählten diese Option.

- Auf den Plätzen zwei und drei folgten mit 48 % der Nennungen "mir wurde etwas vorgegaukelt, was nicht der Wahrheit entspricht" und "Diebstahl meiner Identität, um Kreditkarten oder Bankkonten auf meinen Namen einzurichten".

- Nur 13 % der weltweit Befragten sind nicht von Deepfakes betroffen.

Zusammenfassung:

Die Ängste der Menschen im Zusammenhang mit Deepfakes sind sehr vielfältig. Die beliebtesten Themen drehen sich um Diebstahl und Misstrauen. Und diese Ängste sind nicht unberechtigt: Deepfakes wurden im wirklichen Leben verwendet, um politische Desinformationen zu verbreiten, Aktivisten zu belästigen, einen CEO um 243.000 Dollar zu betrügen und gefälschte Konten in sozialen Medien zu erstellen, um echte Nutzer zu betrügen.

Als Verbraucher führen wir immer mehr Aktivitäten digital aus, was bedeutet, dass wir in der Lage sein müssen, unsere Identität online zu bestätigen. Doch die Technologie zur Erstellung von Fälschungen wird immer besser, billiger und leichter verfügbar. Deshalb wird der Schutz vor Fälschungen immer wichtiger, je mehr die Bedrohung durch Fälschungen wächst und je mehr Menschen sich der Gefahren bewusst werden.

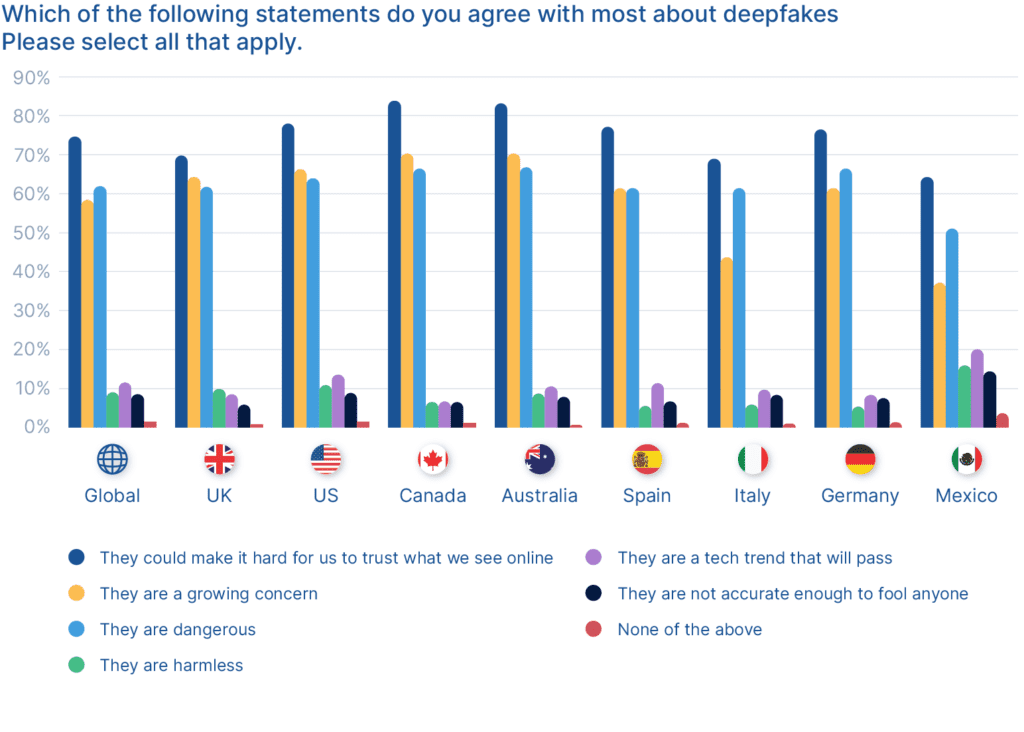

Was denken die Menschen über Deepfakes?

Dann haben wir die Befragten gefragt: "Welcher der folgenden Aussagen über Deepfakes stimmen Sie am meisten zu? Bitte wählen Sie alles aus, was zutrifft."

- Die größte Sorge der Menschen ist, dass Deepfakes "es uns schwer machen könnten, dem zu vertrauen, was wir online sehen".

- An zweiter Stelle steht die Aussage "Deepfakes sind gefährlich" - 62 % der Befragten weltweit stimmen dem zu.

- 58 % stimmen auch zu, dass Deepfakes ein "wachsendes Problem" darstellen.

- Nur 9 % der Befragten weltweit glauben, dass Deepfakes "nicht genau genug sind, um jemanden zu täuschen".

- Nur 2 % der weltweit Befragten sind über keinen Aspekt von Deepfakes besorgt.

Zusammenfassung:

Insgesamt ähnelt dies weitgehend den Daten, die wir 2019 erhoben haben. Im Jahr 2019 stimmten 58 % der Befragten zu, dass Deepfakes ein wachsendes Problem darstellen - genau so viele wie im Jahr 2022. Dies zeigt, dass die Verbraucher zu Recht über die Erosion des Vertrauens im Internet besorgt sind. Dies ist das schwierige Problem, das iProov zu lösen versucht - unsere patentierte biometrische Authentifizierungstechnologie kann die tatsächliche Anwesenheit einer echten, überprüfbaren Person sicherstellen und bestätigen, dass sie diejenige ist, die sie vorgibt zu sein, und dass sie kein Deepfake oder ein anderer Präsentations-/Digital-Injection-Angriff ist.

Überlegen Sie sich, was Sie wahrscheinlich niemals sagen oder tun würden. Stellen Sie sich nun vor, dass Ihren Freunden, Ihrer Familie oder Ihrem Arbeitgeber ein überzeugendes Video gezeigt wird, in dem Sie das sagen oder tun. Das Potenzial für böswilligen Missbrauch ist leicht zu erkennen. Natürlich sind nicht alle Deepfakes bösartig oder gefährlich. Viele werden für den sozialen Austausch und zur Unterhaltung verwendet. Aber sie werden auch für Hoaxes, Rache-Pornos und zunehmend für Betrug und Nachahmung eingesetzt.

Recorded Future berichtet, dass ein Krimineller bereit ist, rund 16.000 USD für die Erstellung eines hochwertigen Deepfakes zu zahlen. Die Deepfakes können dann fortgeschrittene Social-Engineering-Angriffe für einen erheblichen Gewinn ermöglichen. Das Problem wird sich weiter verschärfen, da Deepfake-Funktionen immer leichter zugänglich werden.

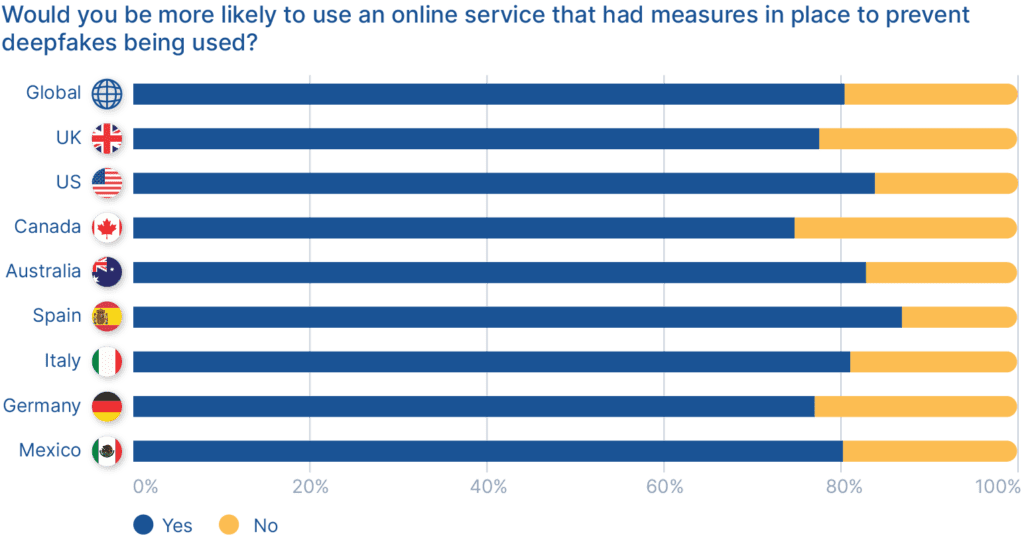

Nutzen Menschen eher Dienste, die sich gegen Deepfakes wehren?

Wir haben die Umfrageteilnehmer gefragt: "Würden Sie eher einen Online-Dienst nutzen, der Maßnahmen zur Verhinderung der Verwendung von Deepfakes vorsieht?"

- Eine überwältigende Mehrheit gab an, dass sie mit größerer Wahrscheinlichkeit Online-Dienste nutzen werden, die vor Fälschungen schützen - 80 % der weltweit Befragten stimmen dem zu.

- Die Befragten aus Spanien schätzen den Deepfake-Schutz am meisten: 87 % antworteten mit "Ja". Im Gegensatz dazu ist Kanada am wenigsten von Deepfake-Präventionsmaßnahmen überzeugt, aber auch dort antworteten 75 % mit "Ja".

Zusammenfassung:

Die Menschen legen 2022 etwas mehr Wert auf den Schutz vor Deepfakes als 2019; insgesamt gaben 75 % der Befragten an, dass sie einen Online-Dienst nutzen würden, der Deepfakes verhindern kann, gegenüber 80 % der Befragten weltweit im Jahr 2022.

Dies zeigt, dass die Verbraucher die Gewissheit haben wollen, dass sie vor Deepfake-Angriffen geschützt sind. Durch die Implementierung der Dynamic Liveness-Technologie von iProov können Regierungen und Unternehmen eine Online-Verifizierung und -Authentifizierung anbieten, die vor synthetischen Medien wie Deepfakes schützt.

Wie können biometrische Authentifizierung und Liveness Detection vor Deepfakes schützen?

Die biometrische Authentifizierung wird verwendet, um nachzuweisen, dass eine Person bei einer Online-Interaktion diejenige ist, die sie vorgibt zu sein - z. B. bei der Anmeldung zu einem Bankkonto oder bei der Registrierung für einen neuen Online-Dienst wie ein staatliches Programm.

Cyberkriminelle sind versiert und versuchen mit immer mehr verschiedenen Methoden, die Sicherheit der biometrischen Authentifizierung zu umgehen. Sie können Fotos oder vorab aufgezeichnete Videos verwenden und diese dann in Form eines Präsentationsangriffs vor die Kamera eines Geräts halten, oder sogar synthetische Bilder, die digital in den Datenstrom eingespeist werden.

Forscher gehen davon aus, dass Kriminelle in den kommenden Jahren verstärkt auf Deepfakes zurückgreifen werden. Dies zeigt, wie wichtig es ist, die Bedrohung durch Deepfakes zu verstehen und sich darauf vorzubereiten. Europol.

Deshalb ist die Aktivitätserkennung so wichtig. Im Wesentlichen stellt die Liveness Detection sicher, dass ein Online-Nutzer eine echte Person ist. Sie nutzt verschiedene Technologien, um zwischen echten Menschen und gefälschten Artefakten zu unterscheiden. Ohne Liveness Detection wäre ein Krimineller in der Lage, ein System erfolgreich mit gefälschten Fotos, Videos oder Masken zu täuschen.

Allerdings ist nicht alle Liveness Detection gleich. Die meisten Liveness Detection-Technologien können einen Präsentationsangriff erkennen - die Verwendung physischer Artefakte wie Masken oder aufgezeichnete Sitzungen, die mit der Kamera des Geräts abgespielt werden, um das System zu täuschen, und könnten auch ein vor eine Kamera gehaltenes Deepfake-Video umfassen.

Andere Liveness-Anbieter können jedoch keine Digital-Injection-Angriffe erkennen, bei denen die Kamera des Geräts (Handy oder Desktop) umgangen wird, um synthetische Bilder in den Datenstrom einzuschleusen. Die geschäftskritische Liveness-Erkennungstechnologie von iProov bietet ein Höchstmaß an Sicherheit - sie erkennt sowohl präsentierte Deepfakes als auch Deepfakes, die bei Digital-Injection-Angriffen verwendet werden.

Die patentierte Flashmark™-Technologie von iProov verwendet eine kontrollierte Beleuchtung, um ein einmaliges biometrisches Merkmal zu erzeugen, das nicht nachgebildet oder wiederverwendet werden kann. Dies bietet einen besseren Schutz gegen Spoofing bei einer Reihe von Angriffen, nicht nur bei Standard-Präsentationsangriffen, sondern auch bei hochskalierbaren Injektionsangriffen mit Deepfakes und ausgefeilten Replays, und bietet ein branchenweit führendes Maß an Sicherheit, dass die Person echt ist und sich gerade authentifiziert.

Mehr über Dynamic Liveness erfahren Sie hier und über die innovative Flashmark-Technologie, die dahinter steckt, hier.

Möchten Sie mehr über Deepfakes erfahren?

- Bericht: Work From Clone: Wie Kriminelle Deepfakes nutzen, um sich für Remote-Jobs zu bewerben

- Bericht: iProov Threat Intelligence 2024: Der Einfluss von generativer KI auf die Remote-Identitätsüberprüfung

- Bericht: Identitätskrise im digitalen Zeitalter: Einsatz wissenschaftlich fundierter biometrischer Daten zur Bekämpfung bösartiger generativer KI

- Artikel: Wie Deepfakes Remote-Identitätsprüfungssysteme bedrohen

Deepfake-Statistik: Zusammenfassung

- Die Daten der iProov-Verbraucherumfrage zeigen, dass das Bewusstsein für Deepfakes wächst: 2019 gaben nur 13 % der Verbraucher an, sie wüssten, was ein Deepfake ist, verglichen mit 29 % im Jahr 2022. Im Jahr 2025 haben nur noch 22 % der Verbraucher vor der Teilnahme an unserer Studie noch nie von Deepfakes gehört. Da Deepfakes jedoch eine Bedrohung für das Online-Vertrauen und möglicherweise auch für die nationale Sicherheit darstellen, muss das Bewusstsein für sie geschärft werden.

- Die Deepfake-Statistiken von iProov zeigen auch, dass 57 % der Menschen glauben, einen Deepfake erkennen zu können. Aber wenn der Deepfake nicht schlecht konstruiert ist, ist dies wahrscheinlich nicht der Fall. Um ein Deepfake zu verifizieren, sind Deep Learning- und Computer-Vision-Technologien erforderlich, um bestimmte Eigenschaften zu analysieren, z. B. wie das Licht auf echter Haut im Vergleich zu synthetischer Haut oder Bildern reflektiert wird.

- Die iProov-Daten zeigen auch, dass die Menschen eher bereit sind, Dienste zu nutzen, die Maßnahmen gegen Deepfakes ergreifen - 80 % der weltweit Befragten stimmen dem zu. Dies ist ein klarer Weckruf für Anbieter von Online-Diensten: Um das Vertrauen der Nutzer zu erhalten oder zu gewinnen, müssen Sie eine Technologie implementieren, die gegen Deepfakes schützen kann.

- Deepfakes sind eine einzigartige und schwierige Bedrohung, die eine einzigartige Lösung erfordert. Aus diesem Grund wurde die patentierte biometrische Technologie Dynamic Liveness von iProov entwickelt, um einen fortschrittlichen Schutz gegen Deepfakes und andere fortschrittliche Angriffe zu bieten.

- Nur iProov Dynamic Liveness kann das für die Abwehr von Deepfakes erforderliche Maß an Sicherheit bieten.

Finden Sie heraus, wie iProov vor Deepfakes schützt - buchen Sie Ihre iProov-Demo oder kontaktieren Sie uns.