26 de agosto de 2023

Provavelmente já viu um vídeo deepfake - mesmo que não se tenha apercebido. Os Tom Cruises gerados por computador têm aparecido por toda a web nos últimos anos. Mark Zuckerberg é outro alvo comum, com vídeos que circulam em que ele diz coisas que não disse na realidade. Depois, houve o infame deepfake do Channel 4 da Rainha, a entregar uma mensagem de Natal alternativa no Reino Unido.

As deepfakes não são um problema novo, mas as ferramentas necessárias para as criar estão cada vez mais disponíveis e mais avançadas. Em última análise, as falsificações profundas são perigosas porque nos dificultam a confiança no que vemos e ouvimos em linha. O potencial de utilização indevida e a ameaça para os consumidores, governos e empresas não podem ser exagerados.

Apesar da crescente ameaça dos deepfakes para a sociedade, muitas pessoas ainda não sabem o que é um deepfake. Para entender melhor o cenário de deepfake, o iProov entrevistou 2.000 consumidores do Reino Unido e dos EUA em 2025, expondo-os a uma série de conteúdo real e deepfake. Também inquirimos anteriormente 16 000 pessoas em oito países em 2022 (EUA, Canadá, México, Alemanha, Itália, Espanha, Reino Unido e Austrália), fazendo-lhes várias perguntas sobre deepfakes.

Neste artigo, partilharemos os nossos novos dados, compará-los-emos com os resultados de cada estudo e discutiremos soluções para a crescente ameaça.

2025 Resultados do estudo Deepfake: A maioria dos consumidores não consegue identificar as falsificações geradas por IA

- Apenas 0,1% dos participantes conseguiram identificar corretamente todos os conteúdos deepfake e reais (imagens e vídeos), mesmo quando lhes foi especificamente dito para procurarem falsificações.

- 22% nunca tinham ouvido falar de deepfakes antes de participarem no estudo.

- Os participantes tinham 36% menos probabilidades de detetar vídeos falsos do que imagens falsas

- Mais de 60% das pessoas estavam confiantes nas suas capacidades de deteção de deepfake, independentemente de estarem certas ou erradas (demonstrando um perigoso excesso de confiança)

- Menos de 29% tomam qualquer medida quando se deparam com suspeitas de deepfakes

- A nível mundial, 71% dos inquiridos afirmam não saber o que é um deepfake. Pouco menos de um terço dos consumidores globais afirmam ter conhecimento das deepfakes.

- 74% preocupam-se com o impacto social dos deepfakes

- Apenas 11% analisam criticamente a fonte e o contexto para determinar se algo é um deepfake

Leia o estudo completo aqui e faça o teste de deepfake aqui para pôr à prova as suas capacidades.

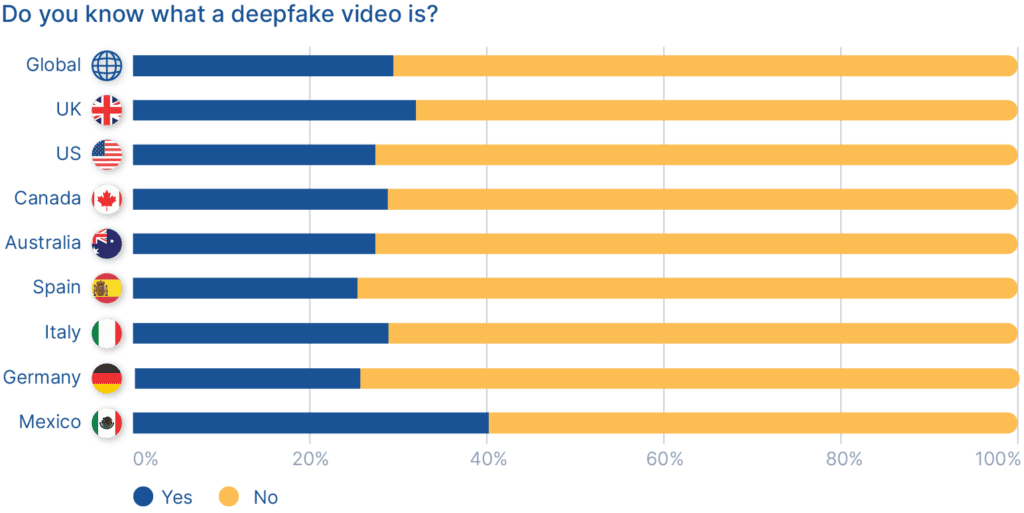

Quantas pessoas sabem o que é um Deepfake?

Perguntámos: "Sabes o que é um vídeo deepfake?"

- A nível mundial, 71% dos inquiridos afirmam não saber o que é um deepfake. Pouco menos de um terço dos consumidores globais afirmam ter conhecimento das deepfakes.

- O México e o Reino Unido são os países mais familiarizados com os deepfakes: 40% dos inquiridos mexicanos e 32% dos inquiridos britânicos dizem saber o que é um deepfake.

- A Espanha e a Alemanha são os países menos informados sobre deepfakes: 75% dos inquiridos em Espanha e na Alemanha responderam "Não".

Resumo:

A porcentagem de pessoas que sabem o que é um deepfake mais do que dobrou desde nossa última pesquisa - em 2019, apenas 13% disseram que sabiam o que era um deepfake, em comparação com 29% em 2022. Por um lado, é positivo que a conscientização sobre a ameaça do deepfake esteja crescendo. Por outro lado, é preocupante que apenas 29% das pessoas estejam cientes das deepfakes em 2022. As deepfakes têm um potencial significativo de utilização indevida e fraude - e se as pessoas não souberem o que são, é menos provável que estejam preparadas para identificar quando estão a ser falsificadas.

O que são deepfakes? Os deepfakes são vídeos ou imagens criados com recurso a software de aprendizagem profunda alimentado por IA para mostrar pessoas a dizer e a fazer coisas que não disseram ou fizeram. Os deepfakes estão a ser cada vez mais utilizados para cometer cibercrime - pode ser para ganhos financeiros, perturbação social, fraude eleitoral ou outros fins nefastos. Os deepfakes são utilizados para cometer fraudes e aceder a serviços fingindo ser outra pessoa, ou para obter acesso a serviços a que não poderiam aceder utilizando a sua verdadeira identidade. Podem ser utilizados em fraudes de identidade sintética, fraudes de novas contas e fraudes de aquisição de contas, entre outras. Existem muitos tipos de deepfakes - trocas de rosto, reencenações ou Redes Adversárias Generativas (GANs) - e podem ser utilizados em vários tipos de ameaças, como ataques de apresentação ou de injeção digital.

Em última análise, a sensibilização para os deepfakes e a compreensão das soluções disponíveis devem ser alargadas e discutidas mais amplamente.

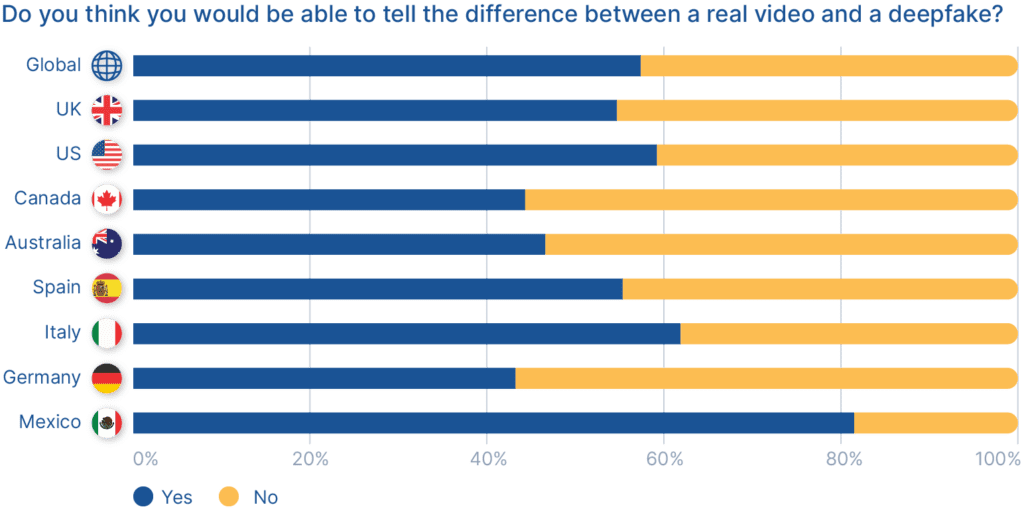

Quantas pessoas pensam que conseguem detetar um Deepfake?

Perguntámos: "Achas que serias capaz de distinguir entre um vídeo verdadeiro e um deepfake?"

- 57% dos inquiridos a nível mundial dizem que acham que conseguiriam detetar um deepfake. 43% admitem que não seriam capazes de distinguir entre um vídeo real e um deepfake.

- Os inquiridos do México são os mais confiantes - 82% acreditam que conseguiriam distinguir entre um deepfake e um vídeo real.

- Entretanto, os inquiridos da Alemanha são os menos confiantes: 57% dizem que não seriam capazes de distinguir a diferença.

Resumo:

57% dos entrevistados globais acreditam que poderiam dizer a diferença entre um vídeo real e um deepfake, o que representa um aumento de 37% em 2019. Isso é preocupante porque a verdade é que deepfakes sofisticados podem ser indistinguíveis ao olho humano. Para verificar um deepfake, as tecnologias de aprendizado profundo e visão computacional são necessárias para analisar certas propriedades, como a forma como a luz reflete na pele real versus imagens ou pele sintética.

O verdadeiro problema neste momento são os deepfakes de alta qualidade, como o infame Tom Cruise, por exemplo, que requerem ferramentas sofisticadas, conhecimentos e tempo para serem criados.

Se estivermos demasiado confiantes na nossa capacidade de detetar deepfakes, corremos um maior risco de sermos enganados por um.

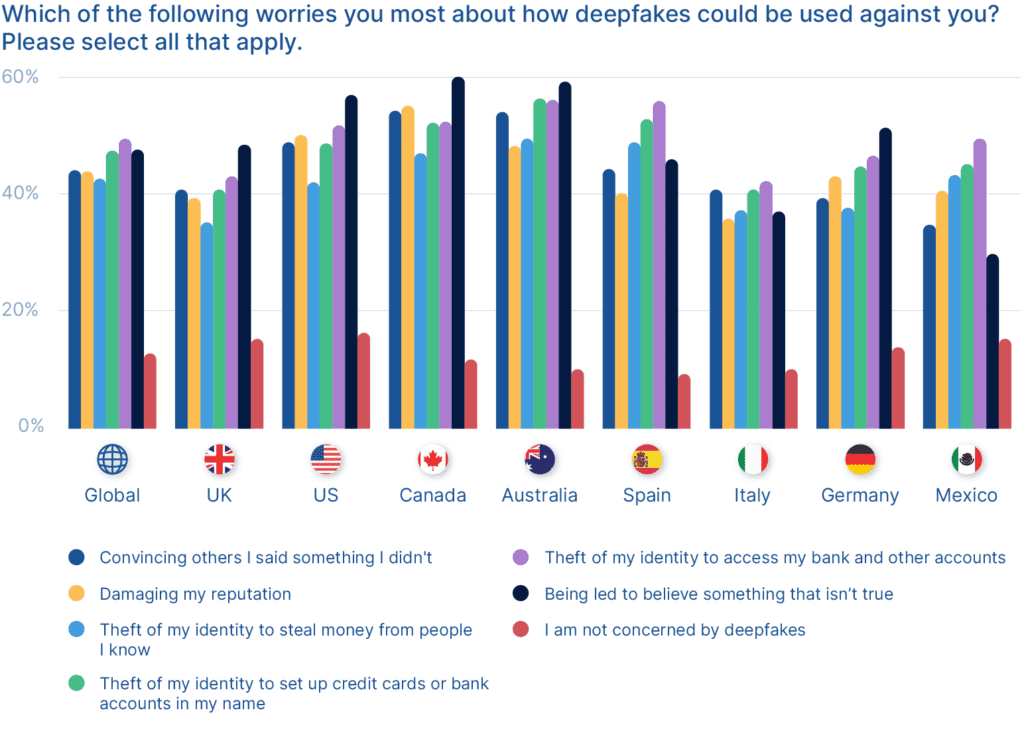

O que assusta as pessoas em relação aos Deepfakes?

Perguntámos aos inquiridos: "Qual das seguintes opções o preocupa mais com a forma como os deepfakes podem ser usados contra si? Por favor, seleccione todos os que se aplicam".

- Globalmente, o receio mais popular em relação aos deepfakes é que possam ser utilizados para "roubar a minha identidade para aceder às minhas contas bancárias e outras". 50% dos inquiridos seleccionaram esta opção.

- O segundo lugar foi ocupado por "ser levado a acreditar em algo que não é verdade" e "roubo da minha identidade para criar cartões de crédito ou contas bancárias em meu nome", com 48% a selecionar estas opções.

- Apenas 13% dos inquiridos a nível mundial não estão preocupados com os deepfakes.

Resumo:

As pessoas têm uma grande variedade de receios em relação aos deepfakes. Os temas mais populares centram-se no roubo e na desconfiança. E estes receios não são descabidos: os deepfakes têm sido utilizados na vida real para promover a desinformação política, assediar activistas, enganar um CEO em 243.000 dólares e criar contas falsas nas redes sociais para defraudar utilizadores genuínos.

Enquanto consumidores, continuamos a realizar cada vez mais actividades digitalmente, o que significa que precisamos de poder confirmar a nossa identidade em linha. No entanto, a tecnologia para criar deepfakes está continuamente a ficar melhor, mais barata e mais facilmente disponível. É por isso que a proteção contra deepfake se tornará cada vez mais crucial à medida que a ameaça de deepfake cresce e mais pessoas tomam consciência dos perigos.

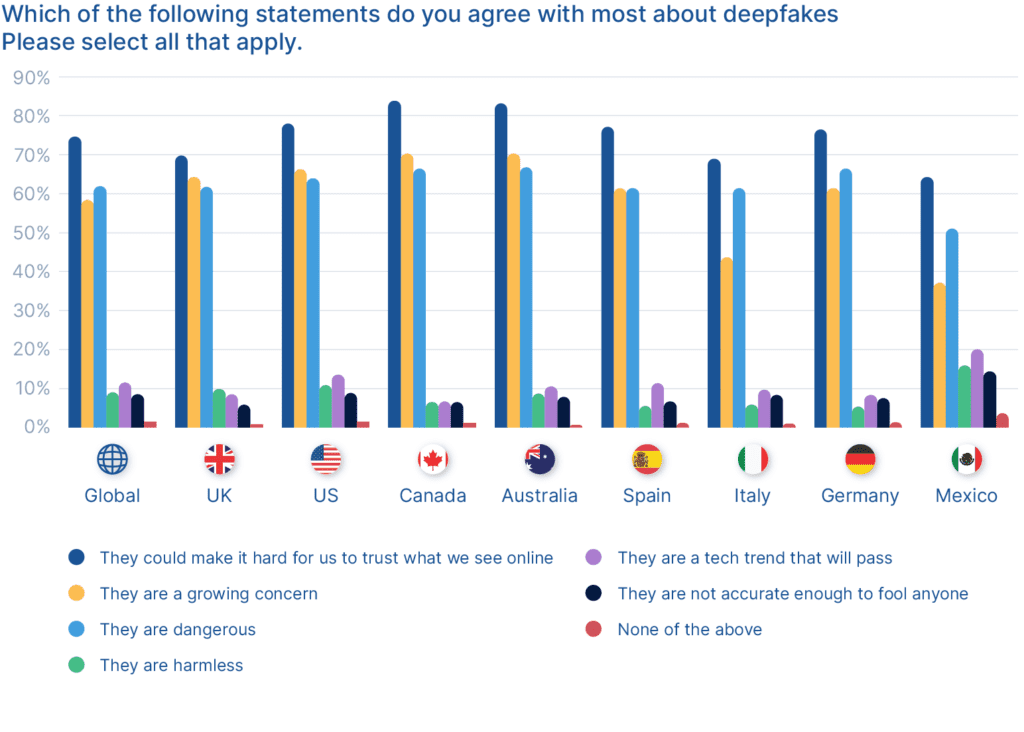

O que é que as pessoas pensam dos Deepfakes?

Em seguida, perguntámos aos inquiridos: "Com qual das seguintes afirmações concorda mais sobre os deepfakes? Por favor, seleccione todas as que se aplicam".

- As pessoas estão mais preocupadas com o facto de os deepfakes "poderem dificultar a confiança no que vemos em linha".

- O segundo lugar foi ocupado pela afirmação de que "as deepfakes são perigosas" - 62% dos inquiridos a nível mundial concordam.

- 58% também concordam que as deepfakes são uma "preocupação crescente".

- Apenas 9% dos inquiridos a nível mundial acreditam que os deepfakes "não são suficientemente precisos para enganar alguém".

- Apenas 2% dos inquiridos a nível mundial não estão preocupados com qualquer aspeto dos deepfakes.

Resumo:

No geral, isso é muito semelhante aos dados que coletamos em 2019. Em 2019, 58% concordaram que os deepfakes eram uma preocupação crescente - exatamente o mesmo que em 2022. Isso mostra que os consumidores estão preocupados, com razão, com a erosão da confiança online. Este é o problema difícil que o iProov se esforça por resolver - a nossa tecnologia patenteada de autenticação biométrica pode assegurar a presença genuína de um indivíduo real e verificável, confirmando que é quem diz ser e que não é um deepfake ou outro ataque de apresentação/injeção digital.

Pense na coisa que é menos provável que alguma vez diga ou faça. Agora imagine que é mostrado aos seus amigos, família ou empregador um vídeo convincente de si a dizer ou a fazer isso. É fácil ver o potencial de utilização indevida e maliciosa. Claro que nem todos os deepfakes são maliciosos ou perigosos. Muitas têm sido utilizadas para partilha social e entretenimento. Mas também têm sido empregues em embustes, pornografia de vingança e, cada vez mais, em fraude e falsificação de identidade.

A Recorded Future informou que um criminoso está disposto a pagar cerca de 16.000 USD pela criação de um deepfake de alta qualidade. As deepfakes podem então facilitar ataques avançados de engenharia social com um lucro significativo. O problema continuará a agravar-se à medida que as capacidades de deepfake se tornarem mais acessíveis.

É mais provável que as pessoas utilizem serviços que se defendem contra falsificações profundas?

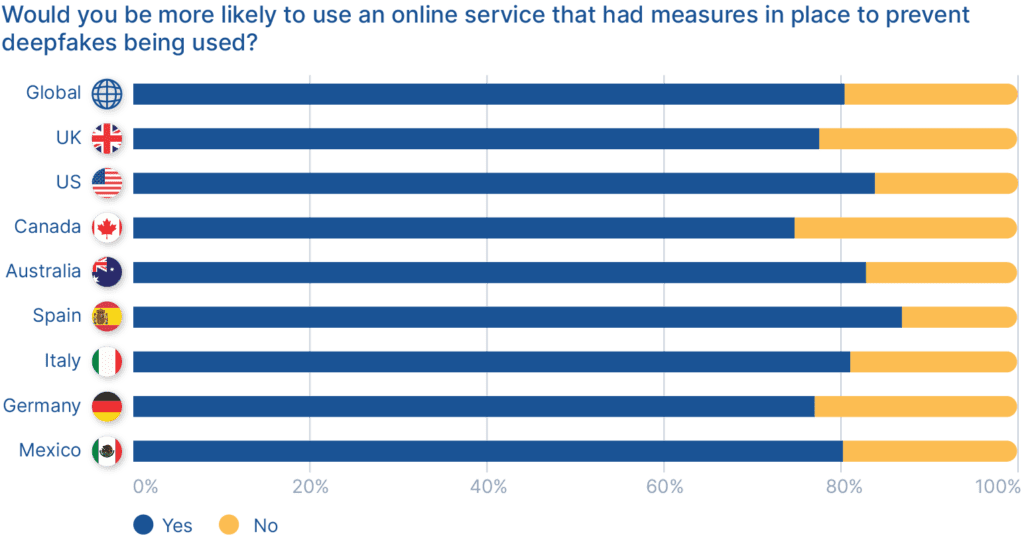

Perguntámos aos inquiridos: "Teria mais probabilidades de utilizar um serviço em linha que dispusesse de medidas para evitar a utilização de deepfakes?"

- Uma esmagadora maioria afirmou que é mais provável que utilizem serviços em linha que se defendam contra as falsificações profundas - 80% dos inquiridos a nível mundial concordam.

- Os inquiridos de Espanha são os que mais valorizam a proteção contra as falsificações profundas: 87% responderam "Sim". Por outro lado, o Canadá é o país menos convencido com as medidas de prevenção de "deepfake", mas mesmo assim 75% responderam "Sim".

Resumo:

As pessoas valorizam a proteção contra deepfake um pouco mais em 2022 do que em 2019; no geral, 75% afirmaram que usariam um serviço online que pudesse evitar deepfakes, contra 80% dos entrevistados globais em 2022.

O que isto demonstra é que os consumidores querem ter a certeza de que estão a ser protegidos contra ataques de deepfake. Ao implementar a tecnologia Dynamic Liveness do iProov, os governos e as empresas podem fornecer verificação e autenticação em linha que protegem contra meios sintéticos como os deepfakes.

Como é que a autenticação biométrica e a deteção de vivacidade se podem defender contra as falsificações profundas?

A autenticação biométrica é utilizada para provar que uma pessoa é quem diz ser numa interação em linha - como assinar uma conta bancária ou inscrever-se num novo serviço em linha, como um regime governamental.

Os cibercriminosos são experientes e tentam um número cada vez maior de métodos diferentes para contornar a segurança da autenticação biométrica. Podem utilizar fotografias ou vídeos pré-gravados e depois colocá-los à frente da câmara de um dispositivo sob a forma de um ataque de apresentação, ou mesmo imagens sintéticas que são injectadas digitalmente no fluxo de dados.

Os investigadores esperam que os criminosos aumentem a sua utilização de deepfakes nos próximos anos. Isto mostra que é vital compreender a ameaça dos deepfake e prepararmo-nos - Europol.

É por isso que a deteção de vida é crucial. Essencialmente, a deteção de vivacidade garante que um utilizador em linha é uma pessoa real. Utiliza várias tecnologias para distinguir entre humanos genuínos e artefactos falsos. Sem a deteção de vivacidade, um criminoso conseguiria falsificar um sistema com fotografias, vídeos ou máscaras falsas.

No entanto, nem toda a deteção de atividade é criada da mesma forma. A maior parte da tecnologia de deteção de vivacidade pode detetar um ataque de apresentação - a utilização de artefactos físicos como máscaras ou sessões gravadas reproduzidas na câmara do dispositivo para tentar falsificar o sistema, podendo também incluir um vídeo deepfake realizado em frente a uma câmara.

No entanto, outros fornecedores de liveness não conseguem detetar um ataque de injeção digital, que contorna a câmara do dispositivo (móvel ou de secretária) para injetar imagens sintéticas no fluxo de dados. A tecnologia de deteção de liveness de missão crítica da iProov oferece o mais elevado nível de garantia - detectando tanto os deepfakes apresentados como os deepfakes utilizados em ataques de injeção digital.

A tecnologia patenteada Flashmark™ da iProov utiliza iluminação controlada para criar uma biometria única que não pode ser recriada ou reutilizada, proporcionando um maior anti-spoofing numa série de ataques; não apenas ataques de apresentação padrão, mas também ataques de injeção altamente escaláveis utilizando deepfakes e repetições sofisticadas, proporcionando um nível de garantia líder na indústria de que a pessoa é real e está a autenticar-se neste momento.

Pode ler mais sobre o Dynamic Liveness aqui e sobre a inovadora tecnologia Flashmark que o alimenta aqui.

Quer saber mais sobre Deepfakes?

- Relatório: Work From Clone: como os criminosos usam deepfakes para se candidatarem a empregos remotos

- Relatório: iProov Threat Intelligence 2024: O impacto da IA generativa na verificação remota de identidade

- Relatório: Crise de identidade na era digital: utilização da biometria de base científica para combater a IA geradora maliciosa

- Artigo: Como os Deepfakes ameaçam os sistemas de verificação remota de identidade

Estatísticas do Deepfake: Resumo

- Os dados do inquérito ao consumidor do iProov mostram que a consciência dos deepfakes está a crescer: em 2019, apenas 13% dos consumidores disseram saber o que é um deepfake, em comparação com 29% em 2022. Em 2025, apenas 22% nunca tinham ouvido falar de deepfakes antes de participar do nosso estudo. No entanto, como os deepfakes representam uma ameaça ao cenário de confiança online e potencialmente à segurança nacional, a conscientização precisa ser maior.

- As estatísticas de deepfake do iProov também mostram que 57% das pessoas acreditam que conseguem detetar um deepfake. Mas, a menos que a deepfake seja mal construída, é provável que isto não seja verdade. Para verificar uma deepfake, são necessárias tecnologias de aprendizagem profunda e de visão por computador para analisar determinadas propriedades, como a forma como a luz se reflecte na pele real em comparação com a pele ou imagens sintéticas.

- Os dados do iProov também mostram que é mais provável que as pessoas utilizem serviços que tomem medidas contra as falsificações profundas - 80% dos inquiridos a nível mundial concordam. Esta é uma clara chamada de atenção para os fornecedores de serviços em linha: para manter ou ganhar a confiança dos utilizadores, é necessário implementar tecnologia que possa defender-se contra as falsificações profundas.

- Os deepfakes são uma ameaça única e desafiadora que exige uma solução única. É por isso que a tecnologia biométrica patenteada da iProov, Dynamic Liveness, foi concebida para oferecer proteção avançada contra deepfakes e outros ataques avançados.

- Somente o iProov Dynamic Liveness pode ser confiável para fornecer o nível de garantia necessário para a defesa contra deepfakes.

Descubra como o iProov protege contra deepfakes - reserve a sua demonstração do iProov ou contacte-nos.